|

AI 쓰레기 문제는 점점 더 논란이 되고 있다. 사진: SCMP . |

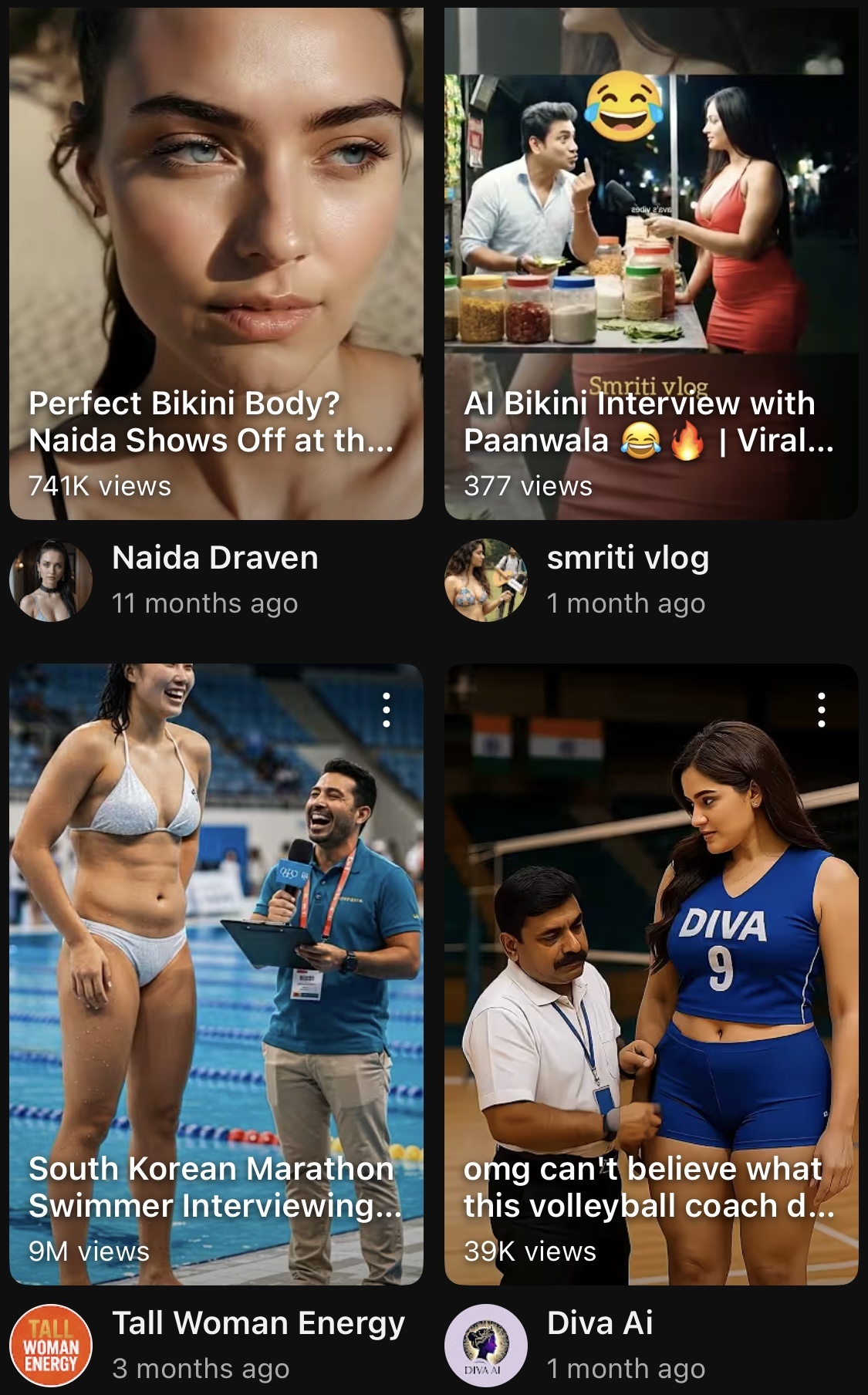

최근 비키니 차림의 여성들이 등장하는 거리 인터뷰 영상이 잇따라 유포되면서 음란한 댓글이 쏟아지고 있습니다. 해당 영상은 전적으로 AI가 생성한 것으로, 숫자로 알고리즘을 속이고 성차별적인 이미지로 시선을 끌도록 설계되었습니다.

사실적인 영상은 저렴한 AI 도구를 통해 간단한 설명 명령어만 입력하면 대량으로 제작됩니다. 이러한 영상 제작의 배후에는 AI를 활용하여 대량의 영상을 제작하고, 플랫폼에서 수익을 창출하기 위해 사용자와의 상호작용을 유도하는 소규모 산업이 있습니다.

프랑스 통신사 AFP(Agence France-Presse)의 연구원들은 인스타그램에서 수백 개의 유사한 영상을 추적했습니다. 인도와 영국 거리에서 탈의실을 이용하거나 옷을 거의 입지 않은 여성 기자들이 인터뷰하는 등 여러 상황에서 여성의 안전에 대한 우려가 제기되었습니다.

힌디어로 된 몇몇 영상에는 젊은 남성들이 무심코 성차별적인 농담을 하거나 심지어 여성을 만지는 장면이 담겨 있으며, 배경에 있는 남성들은 그들을 응시하거나 웃는다.

수많은 동영상이 수천만 조회수를 기록했으며, 그중 일부는 인기를 이용해 성인 채팅 앱을 홍보하여 수익을 창출했습니다. 한편, 시청자들은 때때로 혼란스러워하며, 시청하는 콘텐츠의 현실성에 대해 의견을 제시하고 의문을 제기하기도 했습니다. 미국 사이버 보안 회사인 GetReal Security의 분석에 따르면, 일부 동영상은 구글의 사실적인 AI 생성기인 Veo 3를 사용하여 제작되었습니다.

인도의 사이버 심리학자인 니랄리 바티아는 "이것은 AI가 매개하는 기술로 인해 발생하는 성별적 피해의 일부입니다."라고 말하며, 이러한 추세가 "성차별적 이념을 조장하고 있다"고 강조했습니다.

|

AI가 만든 여성 영상. 사진: 인터넷. |

이러한 추세는 AI가 생성한 영상과 이미지가 관심을 끌기 위해 경쟁하면서 인터넷 환경이 점점 더 오염되고 있음을 반영합니다. 여성 또한 참여의 도구가 되었습니다. 많은 바이럴 영상에는 여성이 남성을 착취하여 돈을 벌거나 범고래에게 공격받는 여성 수생 조련사를 선정적으로 묘사하는 내용이 담겨 있습니다.

작년에 코넬 공과대학의 보안, 신뢰, 안전 이니셔티브 책임자인 알렉시오스 만차를리스는 AI가 생성한 "모델"의 소유로 추정되는 인스타그램 계정 900개를 발견했습니다. 계정 소유자 대부분은 여성이었고, 노출이 심한 옷을 입는 경우가 많았습니다.

가짜 계정들은 모두 1,300만 명의 팔로워를 확보했고 20만 장 이상의 이미지를 게시했으며, 이를 운영하는 사람들은 종종 청중을 상업적 콘텐츠 공유 플랫폼으로 유도하여 돈을 벌기도 합니다.

온라인에서 AI 가짜 콘텐츠가 만연하다는 점을 고려할 때, 만차를리스는 그 숫자가 훨씬 더 많을 가능성이 높다고 말합니다. 그는 "비현실적일 뿐만 아니라 완전히 사실이 아닌 신체 기준을 악용하는 말도 안 되는 콘텐츠가 훨씬 더 많이 등장하게 될 것"이라고 예측합니다.

유튜브와 틱톡에서는 많은 크리에이터들이 AI 콘텐츠 수익 창출 방법을 가르치는 유료 강좌를 개설했습니다. 메타(Meta)를 비롯한 여러 플랫폼은 콘텐츠 관리 기능을 축소했습니다. 반면 유튜브는 더욱 적극적으로 AI 동영상 수익 창출 기능을 중단했습니다.

AI 컨설턴트 디비엔드라 자둔은 "AI가 여성혐오를 만들어낸 것이 아니라, 이미 존재했던 것을 그대로 반영하고 증폭시켰을 뿐입니다."라고 말했습니다. 그는 시청자들이 이러한 콘텐츠와 계속해서 상호작용하는 한 알고리즘과 AI의 확산은 계속될 것이라고 믿습니다.

출처: https://znews.vn/su-that-sau-nhung-video-phong-van-phu-nu-mac-bikini-phan-cam-post1581980.html

![[사진] 국회의장 쩐 탄 만, 빈퓨처 2025 시상식 참석](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F05%2F1764951162416_2628509768338816493-6995-jpg.webp&w=3840&q=75)

![[사진] 베트남 사진작가 협회 창립 60주년 기념](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F05%2F1764935864512_a1-bnd-0841-9740-jpg.webp&w=3840&q=75)

댓글 (0)