Toen ze nog eens keek, realiseerde ze zich dat dit gewoon een AI-foto was die door een Facebookpagina werd gebruikt om een sentimenteel bericht te illustreren. Het is vermeldenswaard dat dit de tweede keer was dat ze "bijna" door AI werd misleid. Daarvoor had ze de video "gepensioneerden die 'zomergasten' ontmoeten" ook al aangezien voor echte mensen en echte gebeurtenissen.

Mevrouw Linh werkt in de media en komt regelmatig in aanraking met AI-inhoud. Ze moet toegeven dat deze technologie zich zo snel en geavanceerd heeft ontwikkeld dat het moeilijk is om onderscheid te maken tussen echt en nep.

Ook experts zijn het met deze visie eens. Tools zoals Google Veo 3, Kling AI, DALL·E 3, Midjourney... hebben de mogelijkheid bereikt om ongelooflijk realistische afbeeldingen en video's te maken.

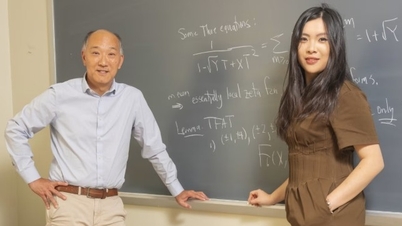

De heer Do Nhu Lam, opleidingsdirecteur van het Blockchain Technology and Artificial Intelligence Institute ABAII, gaf aan dat deze hulpmiddelen dankzij multimodale technologie en geavanceerde taalmodellen beelden, geluiden, gezichtsuitdrukkingen en natuurlijke bewegingen kunnen synchroniseren, waardoor zeer overtuigende producten ontstaan.

De heer Lam merkte op dat de vooruitgang van AI een groot potentieel biedt op gebieden zoals contentcreatie, reclame, entertainment en educatie . Deze "levensechte" mogelijkheid tot reconstructie brengt echter ook veel uitdagingen met zich mee op het gebied van ethiek, controle en informatiebeveiliging, aangezien de grens tussen realiteit en virtualiteit steeds vager wordt.

Het Facebookbericht dat mevrouw Linh zag, trok bijna 300.000 interacties en meer dan 16.000 reacties. Veel gebruikers haastten zich om te feliciteren of hun gevoelens te uiten, zonder te beseffen dat dit slechts een AI-illustratie was. Sommige "nuchtere" mensen bekritiseerden "netizens" omdat ze te naïef waren om zich door AI te laten misleiden.

In Facebookgroepen en -forums is het niet moeilijk om AI-video's te bekijken die door gebruikers zijn gemaakt en gedeeld. Met name de komst van Google Veo 3 heeft de kwaliteit van de video's aanzienlijk verbeterd, met name de stem die past bij de vorm van de mond van het personage. Als je niet oplet en goed kijkt, kunnen kijkers gemakkelijk in de war raken.

Gezond blijven in het tijdperk van AI

Foto's en video's gemaakt door AI zijn moeilijk te onderscheiden, wat grote risico's met zich meebrengt voor gebruikers, met name kwetsbare groepen die niet over de juiste technologie beschikken. Volgens de heer Vu Thanh Thang, directeur Kunstmatige Intelligentie (CAIO) van SCS Cyber Security Joint Stock Company, wordt AI door cybercriminelen gebruikt voor fraude (het omzeilen van biometrische systemen, eKYC...), waarbij ze zich voordoen als bekende personen om valse informatie te verspreiden en zo verwarring bij het publiek te veroorzaken. Er zijn veel gevallen bekend van hightechcriminelen die AI misbruiken om deepfake-foto's te maken en zich voordoen als familieleden om videogesprekken te voeren en geld afhandig te maken.

Volgens de heer Thang zijn bedrijven ook potentiële doelwitten voor AI-criminelen. Ze kunnen AI Deepfake gebruiken om zich voor te doen als werknemers, beveiligingssystemen te omzeilen om aanwezigheid te ontgrendelen en zich voor te doen als bedrijfsleiders om hun reputatie te schaden en te vernietigen.

De heer Do Nhu Lam van ABAII deelde dezelfde mening en wees op drie gevolgen voor individuele gebruikers die AI met zich meebrengt: financiële fraude, reputatieschade en misbruik van privégegevens. Bedrijven als Arup leden een verlies van 25 miljoen dollar nadat medewerkers van de vestiging in Hongkong werden misleid om deel te nemen aan een deepfake-videomeeting en geld over te maken zoals gevraagd.

Een ander, even ernstig risico is dat wanneer mensen geen onderscheid meer kunnen maken tussen echt en nepnieuws, het publieke vertrouwen in de media en officiële nieuwsbronnen wordt ondermijnd.

De heer Lam citeerde een rapport van het Reuters Institute uit 2024 waaruit bleek dat het percentage wereldwijde gebruikers dat nieuws op mediaplatformen vertrouwt, is gedaald tot het laagste niveau in tien jaar. Dit komt grotendeels door de opkomst van deepfake-content.

Volgens expert Vu Thanh Thang “leven we in een tijdperk waarin alle informatie vervalst kan worden en niet langer een ‘risico’ vormt.” Daarom is het noodzakelijk om het bewustzijn te vergroten en persoonlijke beschermingsmaatregelen toe te passen, en om meer te leren over AI om in vrede te kunnen leven.

De twee experts adviseren gebruikers om altijd informatie te verifiëren en te authenticeren voordat ze beslissingen nemen; zich te wapenen met kennis om nepcontent te identificeren; het online delen van persoonlijke informatie te beperken; en het verspreiden van nepcontent te melden. "Alleen door proactief en deskundig te zijn, kunnen gebruikers zichzelf echt beschermen en bijdragen aan een veiligere cyberspace in het digitale tijdperk", aldus Lam.

Bron: https://vietnamnet.vn/anh-ai-tran-ngap-facebook-tuong-vo-hai-nhung-cuc-nguy-hiem-2408883.html

![[Foto] Voorzitter van de Nationale Assemblee, Tran Thanh Man, woont de VinFuture 2025 Award Ceremony bij](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F05%2F1764951162416_2628509768338816493-6995-jpg.webp&w=3840&q=75)

![[Foto] 60-jarig jubileum van de oprichting van de Vietnamese Vereniging van Fotografische Kunstenaars](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F05%2F1764935864512_a1-bnd-0841-9740-jpg.webp&w=3840&q=75)

Reactie (0)