Het labelen van door AI gegenereerde producten

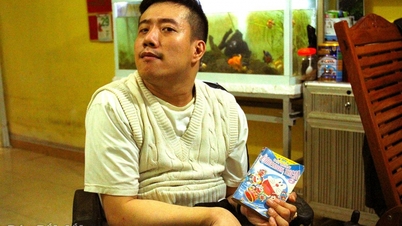

De heer Nguyen Tam Hung (HCMC) benadrukte het risicobeheersingsmechanisme voor AI in het leven van vandaag en gaf aan dat het wetsontwerp dat leveranciers verplicht om te zorgen voor machineleesbare markering van AI-content, zeer noodzakelijk is. Hij opperde echter ook om een verplichte vereiste toe te voegen om identificatiegegevens direct op de interactieve interface weer te geven wanneer de content verwarring dreigt te veroorzaken. Dit om gewone gebruikers, met name kinderen en ouderen, te beschermen tegen het risico van misinformatie en deepfakes. Deze regelgeving versterkt de maatschappelijke verantwoordelijkheid van technologieaanbieders en bouwt digitaal vertrouwen op bij mensen.

Daarnaast zei plaatsvervangend Nguyen Tam Hung dat hij door onderzoek had ontdekt dat het huidige multifunctionele AI-model niet alleen tekst of afbeeldingen creëert, maar ook broncode, aanvalstools, uitvoeringsinstructies, cyberaanvalsprocessen, methoden voor financiële fraude, enz. kan genereren. Op basis daarvan stelde de plaatsvervangend voor om de verplichting toe te voegen om het "zelfgenererende vermogen" van het model te controleren wanneer de generatie van broncode wordt toegestaan, en om een mechanisme te hebben om te waarschuwen, de uitvoer te blokkeren en te beperken, wat noodzakelijk is om de netwerkbeveiliging en de maatschappelijke orde en veiligheid te waarborgen.

Ook plaatsvervangend Pham Van Hoa ( Dong Thap ) keek naar de risico's die AI met zich meebrengt en zei dat AI-technologie weliswaar een hulpmiddel is ter ondersteuning van mensen, maar dat het ook veel grote risico's met zich meebrengt. De plaatsvervangend verzocht de opstelcommissie om een objectieve en nauwkeurige beoordeling van deze kwestie.

"De risico's kunnen van invloed zijn op het menselijk leven, eigendommen, rechten en legitieme belangen van organisaties en individuen", aldus plaatsvervangend Pham Van Hoa, eraan toevoegend dat er labels moeten komen voor door AI gecreëerde producten. Volgens hem is het labelen van AI bedoeld om mensen te laten weten welke producten door AI zijn gemaakt en welke niet.

Ondertussen zei afgevaardigde Trinh Thi Tu Anh ( Lam Dong ) dat artikel 11 van het wetsontwerp de gedachtegang achter risicobeoordeling op basis van technologische impact niet volledig weerspiegelt. Volgens haar kan AI in de huidige context schadelijke methoden creëren die nog nooit zijn geïdentificeerd. Daarom stelde afgevaardigde Trinh Thi Tu Anh voor om de volgende bepaling toe te voegen: "De regering zal de lijst van kunstmatige-intelligentiesystemen met onaanvaardbare risico's gedetailleerd specificeren en periodiek bijwerken en aanvullen op basis van risicobeoordeling, technologische trends en praktische beheersvereisten. Volgens haar zorgt dit mechanisme ervoor dat de wet niet veroudert en dat er snel kan worden gereageerd op nieuwe risico's.

Het vermijden van AI-misbruik

Adjunct Tran Khanh Thu (Hung Yen) bracht de kwestie van AI ter ondersteuning van medisch onderzoek en behandeling ter sprake. Hij stelde dat AI niet alleen helpt bij het optimaliseren van processen in de medische sector en het verminderen van de werkdruk voor artsen en andere medische professionals, maar ook een belangrijke rol speelt bij het personaliseren van behandelingen, waardoor de zorgresultaten verbeteren en de efficiëntie van het gebruik van middelen toeneemt. Het toepassen van AI om gezondheidssignalen te detecteren, is echter soms contraproductief.

De vrouwelijke afgevaardigde noemde een praktijkvoorbeeld van een 55-jarige patiënt in Ho Chi Minhstad die lethargisch was toen hij naar het ziekenhuis werd gebracht. Daarvoor gebruikte de familie van de patiënt AI om de diagnose te stellen en kocht vervolgens medicijnen voor de patiënt. Na het gebruik van de medicijnen verslechterde de toestand van de patiënt, en toen hij naar het ziekenhuis werd gebracht, werd bij hem hersenschade, een beroerte en de onvermijdelijke gevolgen vastgesteld.

"Mensen zouden zoekresultaten absoluut niet moeten gebruiken om diagnoses te stellen of medicijnen voor te schrijven. Maar overtreden mensen die medicijnen verkopen op basis van AI-voorschriften de wet?", vroeg afgevaardigde Tran Khanh Thu zich af. Hij hoopte dat dit wetsontwerp over kunstmatige intelligentie (AI) meer specifieke wettelijke kaderbepalingen zou bevatten voor het beheer van AI-producten in de gezondheidszorg, met name met betrekking tot de verantwoordelijkheden van de betrokken partijen.

Met betrekking tot de verschuiving van post-audit naar pre-audit in het wetsontwerp stelde afgevaardigde Tran Khanh Thu voor om een duidelijke kwantitatieve drempelwaarde in te voeren, bijvoorbeeld wanneer het model zijn algoritme verandert, de gebruikersgrootte toeneemt of de trainingsgegevens een specifieke drempelwaarde overschrijden.

Kijkend naar het "misbruik van AI", zei plaatsvervangend Pham Trong Nghia (Lang Son) dat als we te afhankelijk worden van AI in ons leven, dit ons denkvermogen en onze creativiteit zal verminderen. Het misbruik van AI brengt veel potentiële instabiliteiten met zich mee, zoals: schending van de nationale soevereiniteit, vermindering van de effectiviteit van het openbaar bestuur en negatieve gevolgen voor elk individu en elk gezin, met name de jonge generatie.

"Voor de publieke sector vermindert AI-misbruik de haalbaarheid, menselijkheid en effectiviteit van beleid en wetgeving. Het verstrekken van gevoelige informatie en data aan AI kan, indien niet strikt gecontroleerd, leiden tot datalekken, wat de nationale veiligheid en de maatschappelijke orde en veiligheid schaadt, met onvoorspelbare gevolgen", aldus plaatsvervangend Pham Trong Nghia, die voorstelde om een bepaling aan het wetsontwerp toe te voegen die verboden handelingen vastlegt, waaronder een verbod op AI-misbruik in de publieke sector.

Bron: https://www.sggp.org.vn/can-co-che-danh-gia-rui-ro-lien-quan-toi-ai-post825783.html

![[Foto] Premier Pham Minh Chinh leidt de 15e vergadering van de Centrale Raad voor Emulatie en Beloning](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F11%2F27%2F1764245150205_dsc-1922-jpg.webp&w=3840&q=75)

![[Foto] President Luong Cuong woont de 50e verjaardag van de nationale feestdag van Laos bij](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F11%2F27%2F1764225638930_ndo_br_1-jpg.webp&w=3840&q=75)

Reactie (0)