De afdeling Informatiebeveiliging heeft onlangs een waarschuwing afgegeven over de aanhoudende herhaling van fraude met hightechvideo 's en -beelden.

De autoriteiten hebben een groot aantal mensen gewaarschuwd voor de situatie waarin cybercriminelen misbruik maken van openbare afbeeldingen en video's van mensen om deze te bewerken, in te korten en te bedreigen met chantage met nepvideo's.

Met behulp van Deepfake-technologie, waarmee het geluid en beeld van een persoon zeer nauwkeurig kunnen worden gereproduceerd, kunnen criminelen zich voordoen als leiders van onlinevergaderingen of video's en telefoongesprekken maken om financiële fraude te plegen.

Bovendien maken deze oplichtingspraktijken vaak gebruik van psychologische factoren zoals urgentie, angst of macht, waardoor slachtoffers overhaast handelen zonder de authenticiteit zorgvuldig te controleren.

Deepfakes beperken zich niet tot financiële beleggingsfraude. Een ander voorbeeld is liefdesfraude, waarbij deepfakes worden gebruikt om fictieve personages te creëren die via videogesprekken met slachtoffers communiceren. Nadat de oplichter het vertrouwen van het slachtoffer heeft gewonnen, vraagt hij om geld over te maken om noodgevallen, reiskosten of leningen op te lossen.

Gezien bovenstaande situatie adviseert de afdeling Informatiebeveiliging mensen om voorzichtig te zijn met beleggingsadvies van beroemdheden op sociale netwerken, om op hun hoede te zijn voor onbekende berichten, e-mails of telefoontjes en om goed te letten op onnatuurlijke gezichtsuitdrukkingen in video's.

Mensen moeten ook het plaatsen van content met persoonlijke informatie op sociale netwerken beperken, om te voorkomen dat informatie zoals afbeeldingen, video's of stemmen door slechteriken worden gestolen. Tegelijkertijd moeten accounts in de privémodus worden gezet om persoonlijke informatie te beschermen.

In een gesprek met de verslaggever van de krant Dai Doan Ket zei cybersecurity-expert Ngo Minh Hieu, medeoprichter van het Vietnam Cyber Fraud Prevention Project (Chongluadao.vn), dat het gebruik van deepfake-technologie in AI om nepvideogesprekken te voeren voor fraudedoeleinden nog steeds ingewikkeld is. Proefpersonen misbruiken deze technologie om de geloofwaardigheid van hun 'prooi' te vergroten.

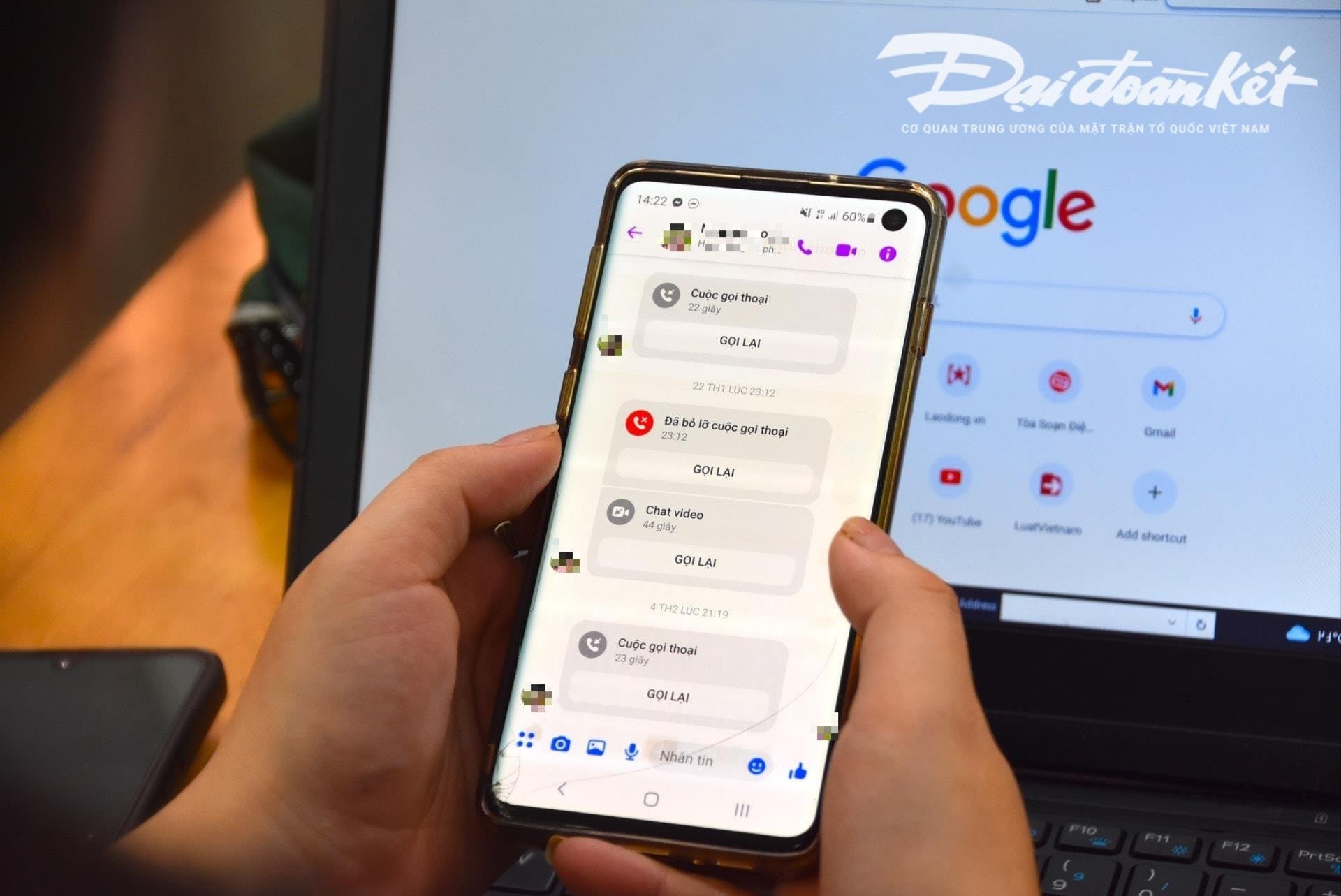

Concreet betekent dit dat de slachtoffers proactief videogesprekken voeren met behulp van eerder 'gestolen' afbeeldingen en video's. Ze manipuleren de techniek, vervormen het geluid of vervalsen de beelden om het vertrouwen van het slachtoffer te winnen.

Meestal zijn deze telefoontjes erg kort, hooguit een paar seconden. Vervolgens wordt het slachtoffer gevraagd om aan de verzoeken van de oplichter te voldoen, bijvoorbeeld omdat het netwerk instabiel is of omdat hij op straat is.

Deskundigen waarschuwen dat het gebruik van AI voor cyberfraude in de nabije toekomst waarschijnlijk aanzienlijk zal toenemen. Daarom moeten mensen proactief hun waakzaamheid vergroten, vooral bij het ontvangen van vreemde berichten, videogesprekken en links.

Volgens de analyse van deze expert kan het huidige algoritme voor kunstmatige intelligentie (AI) voor deepfake-gesprekken niet omgaan met de situatie als de beller naar links of rechts gaat, of opstaat...

Een specifieke zwakte waar mensen op moeten letten bij het ontvangen van dit soort telefoontjes, is het gebit. Huidige AI-algoritmen kunnen het gebit van de persoon die wordt geïmiteerd, dan ook niet reproduceren.

Bij deepfake is de afbeelding van de persoon die zijn mond opent mogelijk zonder tanden; sommige mensen hebben er zelfs drie of vier. De kenmerken van de tanden zijn daarom het meest herkenbare element van een nepgesprek met deepfake.

"Langzaam" reageren en het verzoek niet direct opvolgen is een voorwaarde om te voorkomen dat je in de valkuil van oplichting trapt. Wanneer je een bericht of telefoontje via sociale media ontvangt, moet je je familie rechtstreeks bellen om te verifiëren wie er precies contact met je opneemt, met een minimale tijd van meer dan 30 seconden, of persoonlijk afspreken.

In geval van vermoedens dat men zich voordoet als familieleden op sociale media om op te lichten of eigendommen te verduisteren, dient men onmiddellijk de dichtstbijzijnde politiedienst te contacteren zodat er tijdig hulp en afhandeling kan plaatsvinden.

Bron: https://daidoanket.vn/chuyen-gia-chi-meo-nhan-biet-cuoc-goi-deepfake-lua-dao-10300910.html

![[Foto] Cat Ba - Groen paradijselijk eiland](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F04%2F1764821844074_ndo_br_1-dcbthienduongxanh638-jpg.webp&w=3840&q=75)

![[INFOGRAPHIC] Kiwi Ears Belle-koptelefoon met opvallend design](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/04/1764833240932_info-tainghethietke-03-jpg.webp)

![[VIMC 40 dagen bliksemsnel] Haven van Da Nang: Eenheid - Bliksemsnel - Doorbraak naar de finish](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/04/1764833540882_cdn_4-12-25.jpeg)

Reactie (0)