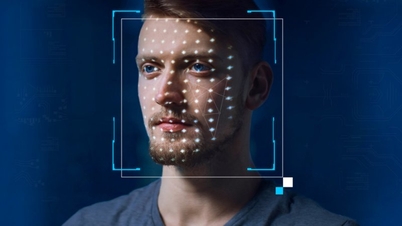

Det sosiale nettverket X har måttet blokkere søk etter Taylor Swift etter at deepfake-pornografiske bilder av sangeren gikk viralt. Når man søker etter Taylor Swift på X-plattformen, vil brukere se en feilmelding og be om å laste inn siden på nytt. Joe Benarroch – direktør for forretningsdrift i X – sa at dette er et foreløpig tiltak og blir gjort med forsiktighet.

AI-genererte pornografiske bilder av Taylor Swift begynte å sirkulere på X 24. januar, noe som fikk fans av sangeren til å legge ut en serie ekte bilder av stjernen for å «drukne» deepfaken. De ba også X om å ta strengere grep for å slette disse bildene og rapportere kontoer som deler falske bilder. Slagordet «beskytt Taylor Swift» ble også en topptrend på plattformen.

En dag senere ble de rapporterte kontoene suspendert eller begrenset, men det var fortsatt enkelt å finne AI-porno på X.

I en uttalelse i helgen sa X at de forbyr deling av grafiske bilder uten den aktuelle personens tillatelse og har en nulltoleransepolicy for slikt innhold. Uttalelsen nevnte ikke Swift ved navn.

«Teamet vårt fjerner aktivt alle bilder som er identifisert og tar passende tiltak mot kontoene som la dem ut. Vi vil overvåke situasjonen nøye for å sikre at eventuelle ytterligere brudd blir tatt hånd om umiddelbart og at innholdet fjernes», sa X.

Fremskritt innen generativ AI har gjort det enklere å forfalske pornografiske bilder av andre mennesker. Med X, etter at det kom under Elon Musks kontroll i 2022, har mange sensurregler blitt lempet på, samtidig som han har permittert tusenvis av ansatte for å stabilisere økonomien sin.

Ifølge NBC News er det uklart hvor deepfake-bildene av Taylor Swift stammer fra, men de var vannmerket for å indikere at de kom fra en nettside kjent for å distribuere falske pornografiske bilder av kjendiser. Nettstedet har også en seksjon dedikert til AI-deepfakes. De falske bildene av Swift ble sett mer enn 27 millioner ganger og likt mer enn 260 000 ganger etter 19 timer etter at de ble publisert.

Etter hendelsen oppfordret Microsofts administrerende direktør Satya Nadella til at det skulle etableres flere rekkverk for å regulere AI. I et intervju med NBC News argumenterte han for at vi har et ansvar for å overvåke denne nye teknologien slik at mer trygt innhold kan produseres.

Som svar på et spørsmål om Swifts deepfake, sa Microsoft-sjefen: «Ja, vi må handle. Jeg tror vi alle drar nytte av en trygg onlineverden . Jeg tror ikke noen ønsker en onlineverden som er fullstendig utrygg for både innholdsskapere og innholdsforbrukere. Så jeg tror vi må handle raskt med denne saken.»

Ifølge 404 Media sa en Telegram-chatgruppe at de brukte Microsofts AI-genererte Designer-verktøy for å forfalske Taylors bilde. Nadella kommenterte ikke direkte informasjonen fra 404 Media, men i en uttalelse sendt til nyhetsnettstedet delte Microsoft at de undersøkte rapporten og ville iverksette nødvendige tiltak.

Administrasjonen til den amerikanske presidenten Joe Biden kalte spredningen av Taylor Swifts pornografiske deepfake «alarmerende» og oppfordret sosiale medieselskaper til å undersøke sin «viktige rolle» i å håndheve regelverk for å forhindre spredning av falsk informasjon og sensitive bilder uten samtykke.

I oktober 2023 signerte president Biden en presidentordre om AI med fokus på å regulere ny teknologi og risikoene knyttet til den.

(Ifølge The Hill, WSJ)

[annonse_2]

Kilde

![[Foto] Statsminister Pham Minh Chinh møter presidenten i den ungarske nasjonalforsamlingen, Kover Laszlo](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/20/1760970413415_dsc-8111-jpg.webp)

![[Foto] Innbyggere i Da Nang «leter etter bilder» av store bølger ved munningen av Han-elven](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/21/1761043632309_ndo_br_11-jpg.webp)

![[Foto] Statsminister Pham Minh Chinh mottok Yamamoto Ichita, guvernør i Gunma-provinsen (Japan)](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/21/1761032833411_dsc-8867-jpg.webp)

Kommentar (0)