Pod koniec każdego roku Fortinet publikuje raport Global Threat Landscape Report, który podsumowuje wydarzenia z danego roku i prognozuje sytuację w cyberbezpieczeństwie na nadchodzący rok. W tym roku firma opublikowała swoją pierwszą coroczną prognozę CISO, obejmującą okres do 2026 roku.

Sztuczna inteligencja napędza innowacje, ale wiąże się z ryzykiem

Sztuczna inteligencja zmienia niemal każdą firmę, nie tylko automatyzując zadania, ale także zmieniając sposób podejmowania decyzji, tworzenia wartości i konkurowania firm. Wydaje się, że korzyści płynące ze sztucznej inteligencji, w tym jej zdolność do napędzania innowacji, są nieograniczone.

Szerokie zmiany technologiczne tradycyjnie leżały w gestii zespołów informatycznych (IT). Jednak nowa fala generatywnej sztucznej inteligencji (GenAI) transformuje technologię, oddając kontrolę w ręce zespołów z działów produkcji, sprzedaży, finansów i IT. Każdy dział wykorzystuje potencjał sztucznej inteligencji do zwiększania efektywności poprzez automatyzację procesów, poprawę skalowalności, usprawnienie procesu decyzyjnego i zapewnienie bardziej spersonalizowanych doświadczeń klientom.

Zmiana ta niesie jednak ze sobą również nowe zagrożenia:

Brak przejrzystości: Wiele modeli sztucznej inteligencji jest nieprzejrzystych, co utrudnia interpretację sposobu podejmowania decyzji przez system. Może to stwarzać problemy z odpowiedzialnością i zgodnością z przepisami.

Prywatność i niewłaściwe wykorzystanie danych: Sztuczna inteligencja wymaga przesyłania dużych, często wrażliwych zbiorów danych do systemów sztucznej inteligencji w chmurze. Brak odpowiedniej edukacji użytkowników na temat zagrożeń może doprowadzić do wycieku wrażliwych danych osobowych lub własności intelektualnej, co może skutkować naruszeniem prywatności lub naruszeniem przepisów.

Luka w zabezpieczeniach

Ataki antagonistyczne: subtelna manipulacja danymi wejściowymi (takimi jak obrazy, tekst, dźwięk) mająca na celu oszukanie modelu i wygenerowanie fałszywych prognoz.

Inwersja i ekstrakcja modelu: zapytania dotyczące modeli umożliwiają atakującym odtworzenie poufnych danych szkoleniowych lub skopiowanie samego modelu, np. wyodrębnienie poszczególnych twarzy z algorytmu sztucznej inteligencji rozpoznającego twarze.

Zatruwanie danych: Manipulowanie danymi w celu wygenerowania fałszywych prognoz.

Ataki typu Prompt Injection: omijanie barier poprzez osadzanie ukrytych instrukcji w tekście lub na stronach internetowych, które powodują, że systemy AI omijają zasady bezpieczeństwa lub powodują wyciek danych.

Słaba tożsamość i uwierzytelnianie: Sztuczna inteligencja agentów może umożliwić wielu agentom wzajemne przeszukiwanie zasobów, podejmowanie autonomicznych, racjonalnych decyzji i wykonywanie działań w celu osiągnięcia określonych celów, często bez ingerencji człowieka.

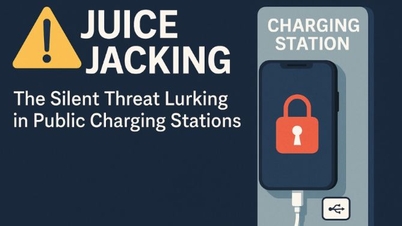

Wykorzystywanie sztucznej inteligencji w celach szkodliwych

Usługi dezinformacji i deepfake. Wiele przypadków wykorzystywania dezinformacji do niepotrzebnego wpływania na ludzi, szczególnie w trakcie procesu Brexitu w Wielkiej Brytanii, było wykorzystywanych w celu wywierania na nich niepotrzebnego wpływu. Potęga sztucznej inteligencji przeniosła to na wyższy poziom dzięki usługom takim jak OpenAI DALL-E i Sora 2, które ułatwiają tworzenie plików audio, graficznych i wideo , które są niemal nie do odróżnienia od oryginału.

Prognoza: Usługi deepfake przeniosą włamania do firmowych e-maili i socjotechnikę na wyższy poziom. W latach 2024 i 2025 zaobserwowaliśmy wyraźną zmianę w jakości wiadomości phishingowych, ponieważ sztuczna inteligencja tworzy starannie opracowane, wysoce ukierunkowane wiadomości e-mail, które są coraz trudniejsze do wykrycia.

Wykorzystanie dźwięku generowanego przez sztuczną inteligencję było już obserwowane w próbach szantażu, ale do 2026 roku organizacje spodziewają się ogromnego napływu treści audio i wideo wykorzystywanych do włamań do firmowej poczty e-mail, phishingu i innych ukierunkowanych ataków. Skoro tak wiele osób padło ofiarą ataków SMS-owych, skutkujących stratami rzędu miliardów dolarów, wyobraź sobie, ile osób da się oszukać i odbierze telefon, a nawet wideorozmowę od prezesa z prośbą o przelew pieniędzy.

Fortinet przewiduje, że w nadchodzącym roku nastąpi znaczny wzrost liczby ataków phishingowych i innych oszustw za pośrednictwem poczty firmowej, a wiele z nich będzie miało dużą liczbę poważnych i kosztownych skutków.

Zaplanowane ataki

W latach 2024 i 2025 nastąpi znaczny wzrost aktywności państw narodowych, mającej na celu kradzież poufnych danych i utrzymanie ukrytej obecności w sieciach organizacji. Biorąc pod uwagę obecne napięcia geopolityczne na świecie, Fortinet przewiduje, że aktywność ta wzrośnie w 2026 roku, ponieważ państwa narodowe będą dążyć do umocnienia swojej pozycji w globalnym ekosystemie.

Następne pokolenie specjalistów ds. bezpieczeństwa

Pokolenie Z (urodzone między 1997 a 2012 rokiem) jest już mocno zakorzenione na rynku pracy, a pokolenie Alfa (urodzone między 2013 a 2029 rokiem) wejdzie na rynek pracy w ciągu najbliższych kilku lat. To pierwsze pokolenia iPadów, które dorastały z Instagramem, Snapchatem i TikTokiem.

Ci obecni i przyszli pracownicy nie znają tradycyjnych technologii „korporacyjnych”, takich jak poczta e-mail. Ponieważ wielu nowych pracowników dorasta w erze cyfrowej, gdzie informacji jest pod dostatkiem, a możliwości skupienia uwagi są ograniczone przez platformy takie jak TikTok, YouTube i Instagram, musimy dostosować nasze podejście do rekrutacji, szkoleń, a ostatecznie do pracy. Co gorsza, szybki rozwój sztucznej inteligencji zastępuje wiele stanowisk na poziomie podstawowym, które absolwenci mogli zajmować w przeszłości. Oznacza to, że nie będzie już miejsca na bardziej kierownicze stanowiska, na które wciąż jest duże zapotrzebowanie.

Jeśli nie dostosujemy się do tych zmian, ryzykujemy pozbawieniem praw kolejnego pokolenia specjalistów ds. cyberbezpieczeństwa.

Quantum – nieprzewidywalne wyzwanie

Komputery kwantowe to technologia, która dla CISO jest trudna do opanowania i zaplanowania. Jest złożona, niepodobna do niczego, do czego jesteśmy przyzwyczajeni. I choć jest niemal niemożliwa do zrozumienia, bezpośrednie zagrożenia nie są jeszcze widoczne, ponieważ komputer kwantowy zdolny do złamania dzisiejszych szyfrów jest prawdopodobnie odległy o ponad 10 lat (chyba że nastąpi nagły skok technologiczny, który zawsze jest możliwy).

Wymagania dla każdego Dyrektora ds. Bezpieczeństwa Informacji

Rok 2026 wystawi na próbę wszystkie założenia dotyczące tego, jak bronimy się, odzyskujemy siły i adaptujemy do stale ewoluującego krajobrazu zagrożeń. Tempo zmian przyspiesza (ponownie), sztuczna inteligencja jest teraz zarówno bronią, jak i tarczą, napięcia geopolityczne przenoszą się na sieci przedsiębiorstw, a granica między ryzykiem IT a ryzykiem biznesowym zaciera się.

CISO muszą najpierw zbudować odporność. Załóż, że zakłócenia są nieuniknione i inwestuj w ciągłość działania, segmentację i gotowość do odzyskiwania danych.

Traktuj sztuczną inteligencję jako zarządzaną funkcję, a nie skrót. Używaj jej do usprawnienia wykrywania i reagowania, ale chroń modele, dane i dostęp z taką samą starannością, jak każdy inny system krytyczny.

Wzmacnianie tożsamości wszędzie. Wraz z rozprzestrzenianiem się ludzi i maszyn, tożsamości nie-ludzkie muszą być stale zabezpieczane i weryfikowane.

Wzmocnij współpracę. Zlikwiduj podział między bezpieczeństwem, operacjami i kierownictwem. Odporność zależy od wspólnego zrozumienia i jednolitej reakcji.

Bądź na bieżąco i dostosowuj się. Aktorzy zagrożeń szybko wprowadzają innowacje wraz z rozwojem technologii, co oznacza, że ciągła nauka i testowanie są obecnie podstawowymi zasadami bezpieczeństwa.

Rola CISO nigdy nie była szersza ani ważniejsza. Sukces w 2026 roku będzie należał do tych, którzy potrafią połączyć wiedzę techniczną ze strategiczną wizją, przekształcając bezpieczeństwo z funkcji reaktywnej w siłę odporności, zaufania i rozwoju.

Source: https://doanhnghiepvn.vn/chuyen-doi-so/nhung-thach-thuc-cac-giam-doc-an-ninh-thong-tin-se-phai-doi-mat-trong-nam-2026/20251126034618176

Komentarz (0)