Explozia inteligenței artificiale (IA) aduce mari beneficii umanității, dar implică și nenumărate consecințe: de la prejudecăți rasiale, fraude online sofisticate, până la riscul ca țările în curs de dezvoltare să devină „mine de date” ieftine.

Având în vedere această realitate, ar trebui ca utilizarea responsabilă a inteligenței artificiale să fie voluntară sau obligatorie? Ce ar trebui să facă Vietnamul atunci când construiește un coridor legal pentru acest domeniu?

În marja evenimentului VinFuture Science and Technology Week, reporterul a avut o conversație cu profesorul Toby Walsh - Universitatea din New South Wales (Australia), academician al Societății Americane de Calculatoare.

Profesorul oferă perspective asupra modului în care ne „comportăm” cu inteligența artificială, de la tragerea la răspundere a „mașinilor” până la sfaturi pentru familii pentru a se proteja de valul de escrocherii high-tech.

Cine este responsabil pentru IA?

Domnule profesor, ar trebui ca utilizarea responsabilă a IA să fie voluntară sau obligatorie? Și cum ar trebui să ne comportăm, de fapt, față de IA?

- Cred cu tărie că utilizarea responsabilă a IA ar trebui să fie obligatorie . Există stimulente perverse , existând sume uriașe de bani câștigate cu IA, iar singura modalitate de a asigura un comportament adecvat este impunerea unor reglementări stricte , astfel încât interesul public să fie întotdeauna echilibrat cu interesele comerciale .

Când IA greșește, cine este responsabil? Mai ales în cazul agenților IA, avem capacitatea de a le repara mecanismele de operare?

Problema principală cu greșelile comise de inteligența artificială este că nu putem trage la răspundere inteligența artificială. Inteligența artificială nu este umană – iar acesta este un defect în fiecare sistem juridic din lume . Doar oamenii pot fi trași la răspundere pentru deciziile și acțiunile lor.

Dintr-o dată, avem un nou „agent”, IA, care poate – dacă îi permitem – să ia decizii și să acționeze în lumea noastră, ceea ce reprezintă o provocare: pe cine vom trage la răspundere?

Răspunsul este: Companiile care implementează și operează sisteme de inteligență artificială trebuie să fie responsabile pentru consecințele pe care le provoacă aceste „mașini”.

Multe companii vorbesc și despre inteligența artificială responsabilă. Cum putem avea încredere în ele? De unde știm că sunt serioase și cuprinzătoare și că nu folosesc „IA responsabilă” doar ca pe o stratagemă de marketing?

- Trebuie să creștem transparența. Este important să înțelegem capacitățile și limitele sistemelor de inteligență artificială. De asemenea, ar trebui să „votăm prin acțiune”, adică să alegem să utilizăm serviciile în mod responsabil.

Cred cu tărie că modul în care companiile utilizează inteligența artificială în mod responsabil va deveni un factor de diferențiere pe piață, oferindu-le un avantaj comercial.

Dacă o companie respectă datele clienților, va aduce beneficii și va atrage clienți. Companiile își vor da seama că a face ceea ce trebuie nu este doar etic, ci le va ajuta și să aibă mai mult succes. Văd acest lucru ca o modalitate de a diferenția între companii, iar companiile responsabile sunt cele cu care ne putem simți confortabil să facem afaceri.

Vietnamul trebuie să protejeze în mod proactiv valorile culturale.

Vietnamul este una dintre puținele țări care iau în considerare promulgarea Legii privind Inteligența Artificială. Care este evaluarea dumneavoastră în acest sens? În opinia dumneavoastră, pentru țările în curs de dezvoltare precum Vietnamul, care sunt provocările legate de etică și siguranță în dezvoltarea IA?

- Mă bucur foarte mult că Vietnamul este una dintre țările pioniere care va avea o lege specializată privind inteligența artificială. Acest lucru este important deoarece fiecare țară are propriile valori și cultură și are nevoie de legi care să protejeze aceste valori.

Valorile și cultura vietnameză sunt diferite de cele din Australia, China și Statele Unite. Nu ne putem aștepta ca firmele de tehnologie din China sau Statele Unite să protejeze automat cultura și limba vietnameză. Vietnamul trebuie să ia inițiativa de a proteja aceste lucruri.

Sunt conștient că în trecut multe țări în curs de dezvoltare au trecut printr-o perioadă de colonizare fizică. Dacă nu suntem atenți, am putea trece printr-o perioadă de „colonizare digitală”. Datele dumneavoastră vor fi exploatate și veți deveni o resursă ieftină.

Acest lucru este în pericol dacă țările în curs de dezvoltare dezvoltă industria inteligenței artificiale într-un mod care exploatează doar datele, fără a controla sau proteja propriile interese.

Deci, cum să depășești această situație?

- E simplu: Investește în oameni. Îmbunătățește-ți competențele oamenilor, asigură-te că înțeleg inteligența artificială. Sprijină antreprenorii, companiile de inteligență artificială, sprijină universitățile. Fii proactiv. În loc să așteptăm ca alte țări să transfere tehnologie sau să ne îndrume, trebuie să fim proactivi și să stăpânim tehnologia.

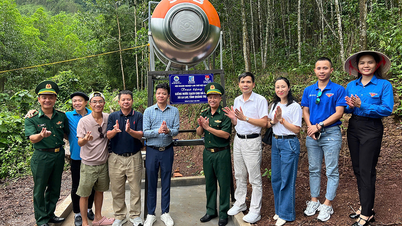

Profesorul Toby Walsh își prezintă experiența la Săptămâna Științei și Tehnologiei VinFuture (Foto: Comitetul de organizare).

În al doilea rând, trebuie să pledăm cu tărie pentru ca platformele de socializare să creeze un mediu sigur pentru utilizatorii din Vietnam, fără a afecta democrația țării.

De fapt, există numeroase exemple despre cum conținutul de pe rețelele de socializare a influențat rezultatele alegerilor, a divizat țări și chiar a incitat la terorism.

Am petrecut 40 de ani lucrând la inteligența artificială. În primii 30 de ani, m-am preocupat de cum să fac IA mai puternică. În ultimii 10 ani, am devenit din ce în ce mai interesat și mai vocal în ceea ce privește dezvoltarea responsabilă a IA.

Puteți oferi câteva sfaturi, având în vedere că Vietnamul este în proces de elaborare a Legii privind Inteligența Artificială?

- Există multe cazuri în care nu sunt necesare legi noi. Avem deja legi privind confidențialitatea, avem deja legi privind concurența. Aceste legi existente se aplică spațiului digital, la fel cum se aplică lumii fizice.

Este important să aplicăm aceste legi la fel de strict în mediul digital ca și în mediul fizic.

Totuși, apar unele riscuri noi și începem să le vedem. Oamenii încep să formeze relații cu inteligența artificială, folosind-o ca terapeuți, iar uneori aceasta le va provoca daune utilizatorilor, așa că trebuie să fim atenți.

Întotdeauna îi tragem la răspundere pe producători atunci când lansează produse. De exemplu, dacă companiile de inteligență artificială lansează produse de inteligență artificială care dăunează oamenilor, și acestea ar trebui să fie trase la răspundere.

Deci, cum putem preveni ca IA să provoace efecte dăunătoare copiilor și cum putem crea un mediu sigur pentru copii ori de câte ori apare IA, domnule?

- Cred că nu am învățat prea multe lecții din rețelele de socializare. Multe țări încep acum să realizeze că rețelele de socializare au beneficii mari, dar și multe dezavantaje, în special impactul asupra sănătății mintale, nivelului de anxietate și imaginii corporale a tinerilor, în special a fetelor.

Multe țări au început deja să implementeze măsuri pentru a aborda această problemă. În Australia, limita de vârstă pentru utilizarea rețelelor sociale va intra în vigoare pe 10 decembrie. Cred că avem nevoie de măsuri similare pentru inteligența artificială.

Construim instrumente care pot avea impacturi pozitive, dar pot și cauza daune și trebuie să protejăm mințile și inimile copiilor noștri de aceste impacturi negative.

În plus, sper că țările vor emite și reglementări stricte pentru gestionarea rețelelor sociale, creând astfel un mediu cu adevărat sigur pentru toată lumea atunci când utilizează inteligența artificială.

De fapt, nu doar copiii, ci și adulții se confruntă cu riscurile cauzate de însăși inteligența artificială. Așadar, cum pot oamenii să folosească inteligența artificială pentru a-și îmbunătăți viața și a nu reprezenta un pericol?

- IA este aplicată în multe domenii, contribuind la îmbunătățirea calității vieții noastre. În medicină, IA ajută la descoperirea de noi medicamente. În educație , IA aduce, de asemenea, multe beneficii pozitive.

Totuși, acordarea accesului la inteligența artificială fără garanții adecvate este prea riscantă. Am văzut procese în SUA în care părinții au dat în judecată companii de tehnologie care și-au împins copiii la sinucidere după ce au interacționat cu chatboți cu inteligență artificială.

Deși procentul utilizatorilor ChatGPT care se confruntă cu probleme de sănătate mintală este doar de câteva procente, cu sute de milioane de utilizatori, numărul real este de ordinul sutelor de mii.

Datele sunt foarte importante pentru dezvoltarea inteligenței artificiale, dar din perspectiva managementului, dacă gestionarea datelor este prea strictă, aceasta va împiedica dezvoltarea inteligenței artificiale. În opinia dumneavoastră, ce pericole poate cauza relaxarea gestionării datelor? Cum să echilibrăm colectarea datelor, gestionarea în siguranță a datelor cu crearea de dezvoltări pentru inteligență artificială?

- Sunt absolut de acord. Datele sunt în centrul progresului inteligenței artificiale , deoarece datele sunt cele care îl propulsează. Fără date, nu vom face niciun progres. Datele de înaltă calitate sunt în centrul a tot ceea ce facem. De fapt, valoarea comercială și avantajul competitiv pe care le obțin companiile provin din date. Indiferent dacă avem sau nu date de calitate, aceasta este problema cheie.

Este exasperant să vezi cărțile autorilor din întreaga lume - inclusiv a mea - fiind folosite fără permisiune și fără compensații. Este un act de furt al roadelor muncii altora. Dacă această situație continuă, autorii își vor pierde motivația de a scrie cărți, iar noi vom pierde valorile culturale pe care le prețuim.

Trebuie să găsim o soluție mai echitabilă decât cea pe care o avem acum.

În prezent, „Silicon Valley” ia conținut și creativitate de la autori fără să plătească pentru asta – acest lucru este nesustenabil. Compar situația actuală cu Napster și cu primele zile ale muzicii online din anii 2000. Pe atunci, muzica online era complet „furată”, dar asta nu putea dura la nesfârșit, deoarece muzicienii aveau nevoie de venituri pentru a continua să creeze.

În cele din urmă, avem sisteme de streaming plătite , precum Spotify sau Apple Music, sau muzică susținută prin reclame, cu o parte din venituri revenind artistului. Trebuie să facem același lucru și cu cărțile, astfel încât autorii să obțină valoare din datele lor. Altfel, nimeni nu va fi motivat să scrie cărți, iar lumea va fi mult mai rea fără a se scrie cărți noi.

În cadrul Săptămânii Științei și Tehnologiei VinFuture, expoziția „Toa V - Punctul de contact al științei” va avea loc și la Centrul de Artă Contemporană Vincom Royal City (Foto: Comitetul de organizare).

Inteligența artificială este foarte dezvoltată în Vietnam. În ultima vreme, Vietnamul a avut numeroase politici de promovare a inteligenței artificiale, dar se confruntă și cu o problemă, și anume frauda cauzată de inteligența artificială. Așadar, potrivit profesorului, cum ar trebui Vietnamul să gestioneze această situație? Care este sfatul profesorului pentru cei care utilizează inteligența artificială astăzi pentru a-și asigura siguranța și a-și proteja datele?

- Pentru fiecare individ, cred că cea mai simplă modalitate este verificarea informațiilor. De exemplu, atunci când primim un apel telefonic sau un e-mail, de exemplu de la o bancă, trebuie să verificăm din nou: Putem suna înapoi la numărul abonatului respectiv sau putem contacta direct banca pentru a verifica informațiile.

Există o mulțime de e-mailuri false, numere de telefon false, chiar și apeluri Zoom false în zilele noastre. Aceste escrocherii sunt simple, ieftine și nu durează mult.

În familia mea, avem și noi propria noastră măsură de securitate: o „întrebare secretă” pe care doar membrii familiei o știu, cum ar fi numele iepurelui nostru de companie. Acest lucru asigură că informațiile importante rămân în cadrul familiei și nu sunt scurse.

Vietnamul a inclus și educația în domeniul inteligenței artificiale în învățământul general, așadar ce ar trebui reținut în acest proces?

- IA schimbă ceea ce se predă și modul în care se predă. Aceasta afectează abilități importante ale viitorului, cum ar fi gândirea critică, abilitățile de comunicare, inteligența socială și inteligența emoțională. Aceste abilități vor deveni esențiale.

IA poate ajuta la predarea acestor abilități, de exemplu ca tutore personal, asistent personal de evaluare, oferind instrumente educaționale foarte eficiente prin intermediul aplicațiilor de IA.

Mulțumesc, domnule profesor, că ți-ai făcut timp să discutăm cu noi!

Sursă: https://dantri.com.vn/cong-nghe/viet-nam-can-lam-gi-de-tranh-nguy-co-tro-thanh-nguon-luc-re-tien-20251203093314154.htm

![[Foto] Paradă pentru a sărbători cea de-a 50-a aniversare a Zilei Naționale a Laosului](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764691918289_ndo_br_0-jpg.webp&w=3840&q=75)

Comentariu (0)