Технологии искусственного интеллекта открывают беспрецедентную эру творчества, когда люди могут создавать изображения, голоса и цифровой контент всего за несколько кликов. Однако это удобство сопряжено с серьёзными рисками, особенно когда ИИ используется для создания опасных розыгрышей.

Казалось бы, безобидные ситуации становятся причиной социальных, правовых и психологических кризисов.

ИИ превращает бездомных в виртуальных персонажей в розыгрыше в TikTok — грань между развлечением и преступлением стирается. (Источник: The Verge)

TikTok и шутка про «ИИ-бездомного»

В США тренд в TikTok вызывает тревогу у полиции: пользователи используют искусственный интеллект Snapchat, чтобы создавать изображения бездомных, появляющихся в домах, а затем снимать панику своих родителей. Некоторые родители вызвали полицию, что привело к экстренному реагированию, которое выглядит как настоящее ограбление.

Полицейское управление города Сейлем, штат Массачусетс, предупреждает, что подобное поведение может привести к действиям спецназа.

Агентство лучше всего выразило ситуацию в своём заявлении: «Эта шутка унижает бездомных, вызывает панику среди звонящих и напрасно тратит ресурсы полиции. Прибывшие на место происшествия полицейские не знали о розыгрыше и восприняли звонок как настоящее ограбление, создав потенциально опасную ситуацию».

Розыгрыши с использованием искусственного интеллекта распространяются по всему миру, а не только в США. В Индии видео с дипфейком во время выборов 2024 года вызвало общественное недоумение, когда политика обвинили в спорных заявлениях, полностью сгенерированных искусственным интеллектом.

Во всем мире День смеха превратился в «игровую площадку для искусственного интеллекта» с серией поддельных изображений знаменитостей, поддельных сообщений от родственников, что приводит к психологическим травмам и сбоям в работе экстренных служб.

«Развитие технологий искусственного интеллекта сопряжено с риском их использования в преступных целях или возникновения социальной паники», — предупреждает Льюис Гриффин, исследователь из Университетского колледжа Лондона.

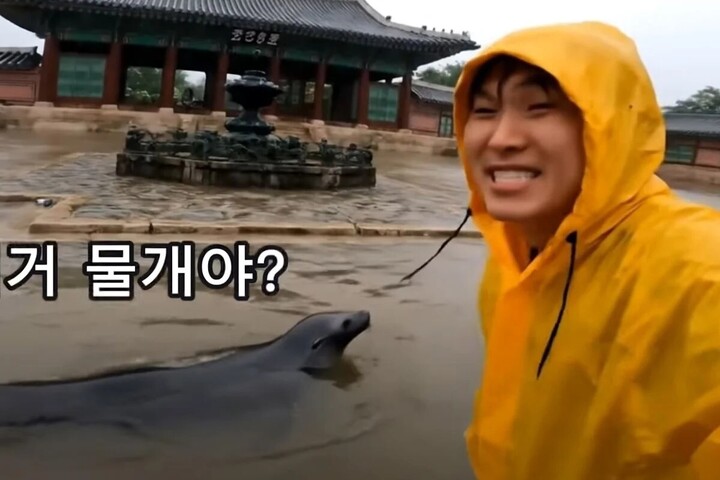

Сцена наводнения во дворце Кёнбоккун, созданная искусственным интеллектом. (Фото вырезано из видео , источник: Youtube).

Образование и контроль

Чтобы предотвратить злоупотребление ИИ, крайне важно обучать пользователей, особенно молодёжь, этике использования технологий. ИИ — это не игрушка, и его использование для создания фейкового контента следует рассматривать как потенциально опасное поведение.

Таким платформам, как TikTok и Snapchat, необходимо внедрить более строгие фильтры контента на основе искусственного интеллекта, а также чёткие предупреждения о создании пользователями поддельных изображений или звуков. Это не только защитит пользователей, но и снизит риск возникновения паники в сообществе.

Согласно опросу Pew Research, хотя общественность по-прежнему испытывает немало опасений по поводу ИИ, эксперты настроены более оптимистично. Однако обе группы сходятся во мнении, что для предотвращения злоупотреблений необходимы чёткие правила. Создание правовой базы и механизмов контроля над ИИ — это не только обязанность правительства, но и обязанность всего общества.

ИИ способен создавать фантастические миры, но если его не контролировать, он легко может стать инструментом для создания путаницы и когнитивных искажений. (Источник: loveonly.ai/Instagram)

Кроме того, властям необходимо тесно сотрудничать с технологическими компаниями для разработки соответствующих процедур реагирования. Когда розыгрыш с использованием искусственного интеллекта приводит к экстренному вызову, нельзя игнорировать трату ресурсов и риск чрезмерной реакции.

Источник: https://vtcnews.vn/ai-bien-nguoi-vo-gia-cu-thanh-tro-dua-canh-sat-my-canh-bao-ar970842.html

![[Фото] Торжественное открытие I съезда Правительственной партии](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/13/1760337945186_ndo_br_img-0787-jpg.webp)

![[Фото] Генеральный секретарь То Лам присутствует на открытии 1-го съезда правительственной партии](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/13/1760321055249_ndo_br_cover-9284-jpg.webp)

Комментарий (0)