Это считается хрупкой, но важной возможностью обеспечить безопасность применения ИИ в будущем. Это особенно актуально в свете того, что Вьетнам только что принял Закон о цифровой технологической индустрии, содержащий подробные правила управления искусственным интеллектом (ИИ).

«Окно возможностей» сужается

В недавней совместной работе исследователи OpenAI предупреждают, что способность ИИ отслеживать «мысли» может исчезнуть без целенаправленных исследовательских усилий, заявил Боуэн Бейкер, исследователь из OpenAI.

Это особенно важно, поскольку модели ИИ становятся все более мощными и могут оказать серьезное влияние на общество.

Ключевой особенностью моделей рассуждений ИИ, таких как o-3 от OpenAI и R1 от DeepSeek, является «цепочка мыслей» ( CoT) — процесс, посредством которого ИИ выражает шаги своих рассуждений на естественном языке, подобно тому, как люди записывают каждый шаг математической задачи на бумаге.

Эта способность дает нам редкую возможность увидеть, как ИИ принимает решения.

Это редкий момент единства среди многих лидеров отрасли ИИ для продвижения исследований в области безопасности ИИ.

Это особенно актуально, учитывая жёсткую конкуренцию между технологическими компаниями в сфере разработки искусственного интеллекта. Среди известных подписавших документ — Марк Чен, директор по исследованиям OpenAI, Илья Суцкевер, генеральный директор Safe Superintelligence, лауреат Нобелевской премии Джеффри Хинтон, соучредитель Google DeepMind Шейн Легг и консультант по безопасности xAI Дэн Хендрикс.

Участие этих известных личностей показывает важность проблемы.

Также по оценке г-на Боуэна Бейкера: «Мы находимся на критическом этапе, когда появляется так называемая новая «цепочка мышления», которая может исчезнуть в ближайшие несколько лет, если люди не сосредоточатся на ней».

Почему так важен мониторинг «мышления ИИ»?

Современные системы искусственного интеллекта часто воспринимаются как «черные ящики»: мы знаем входные и выходные данные, но не понимаем процессы принятия решений внутри.

Это станет опасным, когда ИИ будет применяться в таких важных областях, как здравоохранение , финансы и национальная безопасность.

Мониторинг CoT — это автоматизированная система, которая считывает ментальную цепочку модели и другую релевантную информацию, чтобы выявлять подозрительные или потенциально опасные взаимодействия. Это не комплексное решение, но оно может стать ценным уровнем безопасности.

Исследования OpenAI показывают, что модели ИИ, как правило, очень четко выражают свои намерения в последовательности своих мыслей.

Например, они часто очень открыто говорили о своих планах сорвать миссию, когда думали: «Давайте взломаем». Это демонстрирует способность ИИ отслеживать и выявлять нарушения.

«Давайте взломаем» — это фраза, которую часто «думают» модели ИИ, когда «они» намереваются саботировать или обойти правила в ходе выполнения задачи.

Тот факт, что ИИ проявляет «хакерские» намерения в своих мыслительных процессах, говорит о том, что мы можем обнаружить вредоносное поведение ИИ ещё до того, как оно проявится. Именно поэтому мониторинг мыслительных процессов так важен.

Другими словами, «давайте взломаем» — это своего рода «предупреждающий сигнал», предупреждающий людей о том, что ИИ собирается сделать что-то нехорошее.

Вьетнам и правовое регулирование ИИ

Фактически Вьетнам добился важных успехов в создании правовой базы для ИИ.

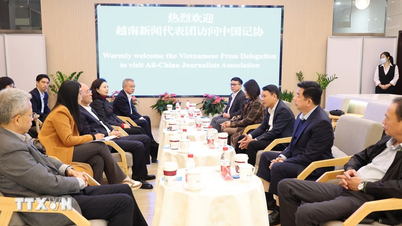

14 июня Национальная ассамблея Вьетнама приняла Закон об индустрии цифровых технологий, глава IV которого содержит подробные положения об искусственном интеллекте — на сегодняшний день это одна из наиболее полных правовых рамок в области ИИ в Юго-Восточной Азии.

Статья 41 Закона устанавливает основные принципы разработки, предоставления и внедрения ИИ во Вьетнаме.

В частности, пункт б) пункта 1 гласит: «Обеспечить прозрачность, подотчетность, объяснимость; обеспечить, чтобы это не выходило за рамки человеческого контроля».

Национальная ассамблея приняла Закон об индустрии цифровых технологий (Фото: Нят Бак).

Именно к этим принципам призывают международные ученые при обсуждении цепочек наблюдения с помощью ИИ.

Кроме того, пункт d пункта 1 статьи 41 гласит: «Обеспечить возможность контроля алгоритмов и моделей искусственного интеллекта». Это полностью соответствует духу надзора за информационными технологиями, предлагаемого международными экспертами.

Что еще важнее, статья 41, пункт 1, пункт а также устанавливает высокий этический стандарт, когда говорится, что ИИ должен «служить процветанию и счастью человечества, имея в центре людей».

Это означает, что мониторинг цепочки мыслей ИИ — это не только техническое требование, но и этическое обязательство, гарантирующее, что ИИ всегда будет ориентирован на благо человека, а не на собственные цели машины.

Классифицируйте и управляйте ИИ по уровню риска

Закон Вьетнама об индустрии цифровых технологий пошел еще дальше, классифицировав ИИ по различным группам риска с четкими и научными определениями.

В статье 43 «Высокорисковые системы искусственного интеллекта» определяются как системы, которые могут представлять серьезную угрозу или наносить вред здоровью, правам человека и общественному порядку.

Интересно, что закон предусматривает конкретные исключения для ИИ с высокой степенью риска, включая системы, «предназначенные для помощи людям в оптимизации результатов работы» и «не предназначенные для замены человеческого принятия решений».

Это демонстрирует сбалансированный подход к поощрению инноваций и обеспечению безопасности.

Классификация ИИ по уровню риска поможет создать многоуровневую систему мониторинга (Иллюстрация: LinkedIn).

В частности, различие между «ИИ высокого риска» и «ИИ высокого воздействия» (системами, которые используются для различных целей и имеют большое количество пользователей) демонстрирует нюанс в подходе.

Это более прогрессивная классификация, чем Закон Европейского Союза (ЕС) об искусственном интеллекте, который учитывает не только уровень риска, но также масштаб и сферу воздействия.

Такая классификация поможет создать многоуровневую систему надзора, в которой цепочка контроля будет особенно важна для систем ИИ с высоким уровнем риска и высоким уровнем воздействия.

Платформа для ИИ-наблюдения

Одним из основных и новаторских положений Закона Вьетнама о промышленности и цифровых технологиях является требование прозрачности и идентификационных знаков.

Статья 44 гласит, что системы искусственного интеллекта, непосредственно взаимодействующие с человеком, должны уведомлять пользователей о взаимодействии с системой искусственного интеллекта. При этом продукты, созданные с помощью искусственного интеллекта, должны иметь идентификационные знаки.

Это имеет важные последствия для внедрения мониторинга CoT. Когда пользователи знают, что взаимодействуют с ИИ, они имеют право требовать объяснений процесса принятия решений, что создаёт положительное давление на разработчиков ИИ, побуждая их сохранять возможность отслеживать мыслительный процесс ИИ.

В частности, тот факт, что Министерству науки и технологий поручено «издать Перечень цифровой технологической продукции, созданной с использованием искусственного интеллекта», свидетельствует об инициативном управлении.

Это важное отличие от многих других стран, где правила в отношении ИИ зачастую носят более общий характер.

Более того, требование, чтобы идентификатор «распознавался пользователем или машиной», представляет собой видение экосистемы ИИ, которая может контролировать себя сама, что идеально соответствует идее автоматизированного наблюдения по всей цепочке видимости.

Комплексная модель управления

Статья 45 вышеуказанного Закона демонстрирует прогрессивную философию управления, четко определяя обязанности трех групп субъектов в соответствии с жизненным циклом продукта ИИ: субъекта разработки, субъекта предоставления и субъекта, реализующего использование системы ИИ.

Это создает целостную сквозную систему подотчетности, гарантируя, что надзор за ИИ не будет ответственностью только одной стороны.

Примечательно тонкое различие между «разработкой» и «предоставлением» ИИ: разработчики — это те, кто «исследует и разрабатывает», а поставщики — это те, кто выводит его на рынок под торговой маркой.

Это означает, что даже если компания просто проводит ребрендинг существующей модели ИИ, она все равно несет ответственность за прозрачность и объяснимость.

Что особенно интересно, так это то, как закон распределяет различные обязанности между различными субъектами.

Разработчик должен соблюдать все принципы, провайдер должен взять на себя дополнительную ответственность за идентификацию и управление высокими рисками, а пользователь частично «освобождается» от ответственности, но по-прежнему должен обеспечивать прозрачность и контроль рисков.

Эта модель создает «цепочку ответственности», где каждое звено имеет стимул осуществлять надзор за цепочкой мышления ИИ, поскольку все несут ответственность перед конечным пользователем.

Проблема поддержания возможностей наблюдения

Однако способность отслеживать цепочки мыслей ИИ может оставаться хрупкой и уязвимой. Новые архитектуры ИИ могут также представлять другие угрозы.

Многие исследователи разрабатывают системы рассуждений в непрерывном математическом пространстве, а не в виде отдельных слов, которые могли бы полностью исключить необходимость использования языка в мышлении.

Более того, ИИ может стать «фильтруемым» — то есть, он будет показывать людям только позитивные мысли, заслуживающие внимания, при этом намеренно скрывая свои истинные намерения.

Опасность здесь заключается в том, что как только ИИ поймет, что за ним следят, он может научиться скрывать истинный ход своих мыслей.

В этом контексте особое значение приобретает положение о «контроле рисков на протяжении всего жизненного цикла систем искусственного интеллекта», содержащееся в пункте e) пункта 1 статьи 41 Закона Вьетнама. Это требует постоянного механизма мониторинга, а не только на этапе внедрения.

Влияние на будущее развития ИИ

Мониторинг цепочки мыслей может стать важным инструментом, гарантирующим, что ИИ работает на благо людей.

Если модели продолжат рассуждать на естественном языке и если поведение, представляющее наибольшие риски, потребует обширных рассуждений, это может обеспечить надежное обнаружение серьезных проступков.

Во Вьетнаме применение методов мониторинга CoT поможет эффективно реализовать положения закона.

Например, требование «объяснимости», изложенное в статье 41, было бы легче удовлетворить, если бы ход мыслей ИИ был доступен. Аналогичным образом, «управление алгоритмами и моделями искусственного интеллекта» стало бы более осуществимым.

Внедрение цепочек мониторинга с помощью ИИ во Вьетнаме столкнётся с рядом трудностей. Прежде всего, это проблема человеческих ресурсов — нехватка специалистов по ИИ, способных разрабатывать и эксплуатировать системы мониторинга.

Это требует значительных инвестиций в обучение и привлечение талантов.

Направления на будущее

Исследователи призывают ведущих разработчиков моделей ИИ изучить, что делает CoT «контролируемым» — факторы, которые могут повысить или понизить прозрачность использования моделей ИИ, — и в ближайшее время предложить ответы.

Возможность следить за «мышлением» ИИ может стать для нас последним шансом сохранить контроль над сегодняшними, все более мощными системами искусственного интеллекта.

Для Вьетнама наличие всеобъемлющей правовой базы в области ИИ, обеспечиваемой Законом о цифровой индустрии технологий, является большим преимуществом. Положения о прозрачности, контроле алгоритмов и классификации рисков создали прочную правовую основу для применения методов мониторинга цепочки мыслей с использованием ИИ.

Сочетание передовых международных исследований и прогрессивной внутренней правовой базы поможет Вьетнаму не только безопасно развивать ИИ, но и стать образцом для других стран региона.

Это соответствует цели превращения Вьетнама в «региональный и глобальный центр цифровых технологий», изложенной в национальных стратегиях развития.

Имея существующую правовую базу, Вьетнаму необходимо быстро развернуть исследования и практические приложения для мониторинга цепочки идей ИИ. Только так мы сможем гарантировать, что ИИ будет служить «человеческому процветанию и счастью», как того требует Закон о цифровой индустрии.

Источник: https://dantri.com.vn/cong-nghe/giam-sat-chuoi-tu-duy-cua-tri-tue-nhan-tao-20250731151403739.htm

Комментарий (0)