เหตุการณ์ล่าสุดที่เกี่ยวข้องกับอคติและการปลอมแปลงเอกสารทำให้บรรดานักวิชาการต้องพิจารณาทบทวนระดับที่เหมาะสมของการมีส่วนร่วมของ AI ในการวิจัยอีกครั้ง

เมื่อไม่นานมานี้ ศาสตราจารย์เหงียน วัน เฮียป ศาสตราจารย์ดุษฎีบัณฑิต สาขาภาษาศาสตร์ ได้แชร์เรื่องราวที่ทำให้ผู้อ่านตกตะลึงในหน้าส่วนตัวของเขา เขาค้นพบว่าปัญญาประดิษฐ์ (AI) ได้ปลอมแปลงเอกสารของเขาโดยใช้ข้อมูลที่เพื่อนส่งมาให้ นอกจากนี้ เขายังค้นพบโดยบังเอิญว่าบทความของรองศาสตราจารย์ ดร. ตรัน วัน โก นัก วิทยาศาสตร์ ดุษฎีบัณฑิต ก็ถูกปลอมแปลงโดยปัญญาประดิษฐ์เช่นกัน

AI ได้กลายเป็นส่วนสำคัญที่ขาดไม่ได้ในชีวิตมนุษย์ อย่างไรก็ตาม ผู้เชี่ยวชาญมักเน้นย้ำว่าเราควรมอง AI เป็นเพียงเครื่องมือสนับสนุนเท่านั้น ผู้ใช้ AI จำเป็นต้องตื่นตัวและมีความรู้ในการประมวลผลข้อมูลและประเมินผลลัพธ์ที่ได้หลังจาก "ร่วมมือ" กับ AI เสมอ โดยเฉพาะอย่างยิ่งในงานวิจัยทางวิทยาศาสตร์ งานวิจัยหลายชิ้นแสดงให้เห็นว่าปัญหาใหญ่ที่สุดที่จำเป็นต้องเฝ้าระวังคืออคติในข้อมูลและแบบจำลอง AI อาจมีอคติ บิดเบือนผลการวิเคราะห์ สร้างอคติหรือการเลือกปฏิบัติ และบิดเบือนข้อมูลได้หากไม่ได้รับการควบคุมที่ดี

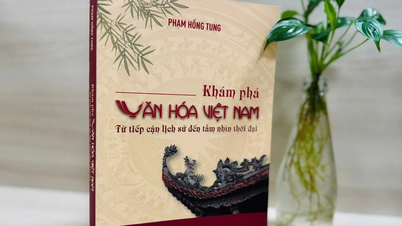

โดยเฉพาะอย่างยิ่ง การใช้ AI ในการวิจัยทางสังคมศาสตร์จำเป็นต้องระมัดระวังมากขึ้น เนื่องจากสาขาต่างๆ ในสังคมศาสตร์ เช่น ปรัชญา ภาษาศาสตร์ ชาติพันธุ์วิทยา ประวัติศาสตร์ ฯลฯ ล้วนใช้พฤติกรรม วัฒนธรรม และความประพฤติของมนุษย์เป็นวัตถุวิจัย ข้อมูลจึงมักเชื่อมโยงอย่างใกล้ชิดกับบริบททางสังคมวัฒนธรรมของเวียดนาม ทั้งในด้านความลึกซึ้งและความจำเพาะเจาะจง หากข้อมูลการฝึกอบรม AI สะท้อนถึงอคติทางประวัติศาสตร์ อันตรายที่อาจเกิดขึ้นคือ AI สามารถสรุปผลที่ทำให้ปัญหาความไม่เท่าเทียมกันทางเพศ ชนชั้น เชื้อชาติ หรือภูมิภาครุนแรงขึ้น ความเสี่ยงจะยิ่งสูงขึ้นไปอีกเมื่อนำ AI มาวิเคราะห์พฤติกรรมมนุษย์ ตอบแบบสำรวจแบบเปิด หรือมีส่วนร่วมในเนื้อหาสื่อ

ตามที่ผู้เชี่ยวชาญด้านสังคมศาสตร์บางคนกล่าวไว้ ในปัจจุบัน AI ประสบปัญหาในการเข้าถึงแหล่งข้อมูลที่มีลิขสิทธิ์หรือต้องชำระเงิน ส่งผลให้ข้อมูลไม่ได้รับการอัปเดตอย่างครบถ้วน

ปรากฏการณ์การสร้างเอกสารเพื่อสร้างเรื่องราวที่น่าเชื่อถือมักเกิดขึ้นในหัวข้อที่ไม่ค่อยเป็นที่นิยม ในภาษาที่มีแหล่งข้อมูลจำกัด เช่น ภาษาเวียดนาม และควรมีการแจ้งเตือนให้ผู้ใช้ทราบ ปัจจุบันระบบ AI ทั่วไปมีข้อจำกัดมากในการทำความเข้าใจบริบททางสังคมและวัฒนธรรม ดังนั้น ความช่วยเหลือในการตีความความรู้ทางสังคมศาสตร์ที่คลุมเครือและเต็มไปด้วยอุปมาอุปไมยจึงยังไม่น่าเชื่อถืออย่างแท้จริง

แม้ว่าจะมีศักยภาพมากมายในการวิจัยทางวิทยาศาสตร์ แต่การประยุกต์ใช้ AI จำเป็นต้องมีความระมัดระวังอย่างยิ่ง มีข้อจำกัด และต้องควบคู่ไปกับความสามารถในการคิดเชิงวิเคราะห์ของนักวิจัยอยู่เสมอ

จะเห็นได้ว่าแม้จะมีศักยภาพมากมายในการวิจัยทางวิทยาศาสตร์ แต่การประยุกต์ใช้ AI จำเป็นต้องระมัดระวัง มีข้อจำกัด และต้องมาพร้อมกับศักยภาพเชิงวิพากษ์ของนักวิจัยอยู่เสมอ ผู้รับการทดลอง AI จะต้องระบุข้อจำกัดเหล่านี้อย่างชัดเจนในการใช้งาน AI เพื่อให้มั่นใจว่า AI จะไม่เปลี่ยนแปลงค่านิยมหลักของวิทยาศาสตร์ เพื่อปกป้องความสมบูรณ์ของงานวิจัยทางวิทยาศาสตร์ บทบาทและความรับผิดชอบของนักวิทยาศาสตร์จำเป็นต้องยกระดับขึ้นไปอีกขั้น นอกจากนี้ จำเป็นต้องเสนอกรอบจริยธรรมด้าน AI ที่มีผลผูกพันทางกฎหมายในบริบทของวัฒนธรรม ประเพณี และบรรทัดฐานทางสังคมของเวียดนาม

เรามีระบบหลัก 9 ประการเพื่อส่งเสริมการวิจัยและพัฒนาระบบ AI ที่ปลอดภัยและมีความรับผิดชอบ จำกัดผลกระทบด้านลบ และควบคุมความเสี่ยงตามที่ กระทรวงวิทยาศาสตร์และเทคโนโลยี เสนอ ซึ่งเน้นย้ำถึงความปลอดภัยของข้อมูล รวมถึงการเคารพสิทธิมนุษยชนและศักดิ์ศรีความเป็นมนุษย์ และความรับผิดชอบของผู้ใช้ AI โดยเฉพาะอย่างยิ่งในด้านการวิจัยทางวิทยาศาสตร์ สภาศาสตราจารย์แห่งรัฐได้ออกหนังสือแจ้งอย่างเป็นทางการเลขที่ 25/HDGSNN ในปี พ.ศ. 2566 โดยเรียกร้องให้สภาศาสตราจารย์ในอุตสาหกรรมและสิ่งอำนวยความสะดวกสำหรับการประเมินคุณภาพผลงานทางวิทยาศาสตร์ให้ความสำคัญเป็นพิเศษกับการตรวจจับและประเมินผลงานที่ใช้หรือได้รับความช่วยเหลือจากเทคโนโลยี AI ข้อกำหนดเหล่านี้มีจุดมุ่งหมายเพื่อให้มั่นใจว่าผลการวิจัยที่ใช้ AI ยังคงเป็นไปตามมาตรฐานทางวิทยาศาสตร์ และป้องกันการใช้ AI ในทางที่ผิดในการวิจัยและการตีพิมพ์ทางวิทยาศาสตร์

ในอนาคตอันใกล้นี้ เมื่อมีการประกาศใช้กฎหมายว่าด้วยปัญญาประดิษฐ์ ซึ่งมีกฎระเบียบที่เข้มงวดเกี่ยวกับจริยธรรมและความรับผิดชอบในการใช้ AI จะช่วยสร้างสภาพแวดล้อมที่เอื้อต่อการพัฒนา AI และให้การสนับสนุนนักวิทยาศาสตร์ในการวิจัยอย่างแข็งขันและรับผิดชอบมากขึ้น

ที่มา: https://nhandan.vn/canh-giac-voi-mat-trai-cua-ai-post916545.html

![[ภาพ] ประธานรัฐสภาฮังการีเยี่ยมชมสุสานประธานาธิบดีโฮจิมินห์](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/20/1760941009023_ndo_br_hungary-jpg.webp)

![[ภาพ] พิธีเปิดการประชุมสมัยสามัญครั้งที่ 10 สมัยประชุมสมัชชาแห่งชาติ ครั้งที่ 15](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/20/1760937111622_ndo_br_1-202-jpg.webp)

![[ภาพ] นายกรัฐมนตรี Pham Minh Chinh พบกับประธานสภาแห่งชาติฮังการี Kover Laszlo](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/20/1760970413415_dsc-8111-jpg.webp)

![[ภาพ] ประธานสภาแห่งชาติ Tran Thanh Man หารือกับประธานสภาแห่งชาติฮังการี Kover Laszlo](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/20/1760952711347_ndo_br_bnd-1603-jpg.webp)

การแสดงความคิดเห็น (0)