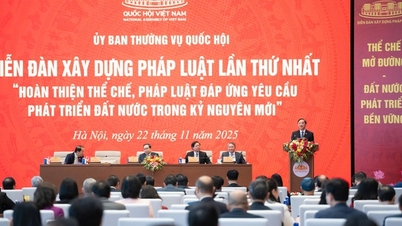

ตามที่ผู้แทน Dong Ngoc Ba กล่าว การประกาศใช้กฎหมายปัญญาประดิษฐ์ (AI) จะช่วยสร้างพื้นฐานทางกฎหมายที่เป็นหนึ่งเดียวและสอดคล้องกัน ส่งเสริมการพัฒนาและรับรองการจัดการความเสี่ยงที่มีประสิทธิภาพในการวิจัย พัฒนา และใช้งาน AI ตอบสนองความต้องการของการพัฒนา เศรษฐกิจ และสังคมในยุคดิจิทัล

ผู้แทนกล่าวว่าหน่วยงานร่างกฎหมายได้ดำเนินการอย่างแข็งขันและมีความรับผิดชอบอย่างมาก โดยได้ศึกษาและรับฟังความคิดเห็นจากหน่วยงานตรวจสอบและหน่วยงานที่เกี่ยวข้องจำนวนมากเพื่อจัดทำร่างกฎหมายให้แล้วเสร็จ ผู้แทนชื่นชมเนื้อหาหลายส่วนที่ได้นำมาปรับปรุงแก้ไขในร่างกฎหมายฉบับใหม่เป็นอย่างยิ่ง

พร้อมกันนี้ขอแนะนำให้มีการทบทวนและปรับปรุงอย่างต่อเนื่อง โดยเฉพาะอย่างยิ่งการดูแลให้มีความสอดคล้องและสอดคล้องกับกฎหมายที่เกี่ยวข้อง เช่น ประมวลกฎหมายแพ่ง กฎหมายว่าด้วยคุณภาพผลิตภัณฑ์และสินค้า กฎหมายว่าด้วยทรัพย์สินทางปัญญา กฎหมายว่าด้วยเทคโนโลยีขั้นสูง กฎหมายว่าด้วยมาตรฐานและกฎข้อบังคับทางเทคนิค ตลอดจนการสร้างแนวคิดและเทคนิคการนิติบัญญัติใหม่ๆ

นอกจากนี้ รองนายกรัฐมนตรี ดงหง็อกบา ยังได้เสนอคำแนะนำเฉพาะเจาะจงบางประการด้วย

ร่างกฎหมายปัญญาประดิษฐ์ (มาตรา 7 ถึง 11) กำหนดให้จำแนกประเภทการจัดการความเสี่ยงของระบบปัญญาประดิษฐ์ออกเป็น 4 ระดับ คือ ความเสี่ยงต่ำ ความเสี่ยงปานกลาง ความเสี่ยงสูง และความเสี่ยงที่ยอมรับไม่ได้

รองนายกรัฐมนตรี กล่าวว่า เมื่อพิจารณาจากลักษณะของ AI แล้ว หากระบบ AI ถือเป็นสินค้าหรือโภคภัณฑ์ประเภทหนึ่ง บทบัญญัติของร่างกฎหมายฉบับนี้ก็ไม่สมเหตุสมผล ไม่สอดคล้อง และไม่สอดคล้องกับบทบัญญัติของกฎหมายว่าด้วยคุณภาพสินค้าและสินค้า (แบ่งสินค้าและสินค้าออกเป็น 3 กลุ่ม คือ ความเสี่ยงต่ำ ความเสี่ยงปานกลาง และความเสี่ยงสูง)

ดังนั้นขอแนะนำให้หน่วยงานร่างกฎหมายศึกษาวิจัยและจำแนกประเภทระบบ AI อย่างรอบคอบในลักษณะที่สอดคล้องกับกฎหมายว่าด้วยคุณภาพสินค้าและสินค้า (3 ระดับความเสี่ยง) เพื่อให้การนำไปปฏิบัติเป็นไปได้สะดวกยิ่งขึ้น

“ในกรณีที่ระบบ AI มี “ ความเสี่ยงที่ยอมรับไม่ได้” ควรถือว่าการกระทำดังกล่าวเป็นกิจกรรมต้องห้าม และควรกำหนดเป็นข้อห้ามไว้ในร่างกฎหมายโดยเฉพาะ จำเป็นต้องเพิ่มการกระทำต้องห้ามอื่นๆ ในการวิจัย พัฒนา และใช้งาน AI (เช่น การใช้ AI เพื่อละเมิดความมั่นคงแห่งชาติ การใช้ AI เพื่อเลือกปฏิบัติโดยอิงจากข้อมูลไบโอเมตริกซ์ เป็นต้น) เพื่อให้มั่นใจว่ามีความสมบูรณ์และเข้มงวด” - รองนายกรัฐมนตรีบา เสนอ

เกี่ยวกับความรับผิดชอบในการชดเชยความเสียหายที่เกิดจากระบบ AI ในข้อ ก. วรรค 3 มาตรา 30 แห่งร่างกฎหมายปัญญาประดิษฐ์ กำหนดว่า “สำหรับระบบ AI ที่มีความเสี่ยงสูง: ในกรณีที่เกิดความเสียหายจากการละเมิดในการบริหารจัดการและการใช้งานระบบ AI องค์กรหรือบุคคลที่ละเมิดต้องชดเชยความเสียหายตามบทบัญญัติของกฎหมายแพ่ง”

ตามประมวลกฎหมายแพ่ง มาตรา 601 วรรคหนึ่ง แหล่งกำเนิดอันตรายร้ายแรง ได้แก่ รถยนต์ ระบบส่งกำลัง การประกอบกิจการโรงงานอุตสาหกรรม อาวุธ วัตถุระเบิด วัตถุไวไฟ วัตถุมีพิษ วัตถุกัมมันตรังสี สัตว์ป่า และ แหล่งกำเนิดอันตรายร้ายแรงอื่นตามที่กฎหมายกำหนด

รองผู้ว่าการดง หง็อก บา กล่าวว่า ประมวลกฎหมายแพ่งได้แยกความแตกต่างระหว่างค่าสินไหมทดแทนสำหรับความเสียหายที่เกิดจากแหล่งที่มาของอันตรายสูงกับกรณีอื่นๆ โดยเฉพาะอย่างยิ่งเกี่ยวกับปัจจัยความผิดในการพิจารณาความรับผิดต่อค่าสินไหมทดแทน บทบัญญัติของร่างกฎหมายปัญญาประดิษฐ์ ข้อ ก วรรค 3 มาตรา 30 ข้างต้น ยังไม่เป็นที่แน่ชัดว่า "ระบบปัญญาประดิษฐ์ที่มีความเสี่ยงสูง" เป็น "แหล่งที่มาของอันตรายสูง" หรือไม่ ขณะเดียวกัน ในเชิงเทคนิคและเทคโนโลยี ระบบปัญญาประดิษฐ์ที่มีความเสี่ยงสูงก็มีลักษณะของแหล่งที่มาของอันตรายสูงเช่นกัน

ดังนั้น ผู้แทนจึงเสนอให้ศึกษาและปรับปรุงบทบัญญัติในข้อ ก. วรรค 3 มาตรา 30 แห่งร่างกฎหมายปัญญาประดิษฐ์ ให้เป็นการกำหนดระบบปัญญาประดิษฐ์ที่มีความเสี่ยงสูงให้เป็นแหล่งอันตรายร้ายแรง เพื่อเป็นพื้นฐานในการบังคับใช้กฎหมายว่าด้วยความรับผิดชอบในการชดใช้ค่าเสียหายอันเกิดจากระบบปัญญาประดิษฐ์ตามบทบัญญัติแห่งประมวลกฎหมายแพ่ง

ในส่วนของนวัตกรรมทางความคิดและเทคนิคการออกกฎหมาย รองนายกรัฐมนตรีบาได้เสนอให้มีการทบทวนเพื่อให้มั่นใจว่ากฎหมายว่าด้วยปัญญาประดิษฐ์ (AI) จะไม่ควบคุมประเด็นต่างๆ ภายใต้อำนาจของ รัฐบาล โดยเฉพาะอย่างยิ่งในบทที่ 6 (การตรวจสอบ การตรวจสอบ และการจัดการการละเมิด) ให้พิจารณาไม่ควบคุมการตรวจสอบเฉพาะทาง แต่ปล่อยให้รัฐบาลเป็นผู้ควบคุมตามอำนาจของตน ทบทวนบทที่ 7 (การจัดการ AI ของรัฐ) ยกเลิกกฎระเบียบภายใต้อำนาจของรัฐบาล เช่น ความรับผิดชอบในการบริหารจัดการของกระทรวงต่างๆ... เสนอให้รวมบทที่ 6 เข้ากับบทที่ 7 เนื่องจากการตรวจสอบ การตรวจสอบ และการจัดการการละเมิดเป็นเนื้อหาเฉพาะของการจัดการ AI ของรัฐ

นายซิวเฮือง รองหัวหน้าคณะผู้แทนรัฐสภาจังหวัดจาลาย แสดงความสนใจในกฎระเบียบว่าด้วยจริยธรรมและความรับผิดชอบในการดำเนินกิจกรรม AI ในบทที่ 5

ผู้แทน Huong กล่าวว่า ปัจจุบันโมเดล AI จำนวนมากได้รับการฝึกฝนโดยการรวบรวมข้อมูล งานศิลปะ และเนื้อหาสร้างสรรค์จากอินเทอร์เน็ตโดยไม่ได้รับความยินยอมจากผู้เขียน และไม่มีกลไกในการชดเชยให้กับผู้เขียน ซึ่งอาจมีความเสี่ยงต่อการละเมิดสิทธิ์ในทรัพย์สินทางปัญญาของผู้สร้างเนื้อหา

ดังนั้น ผู้แทนจึงเสนอแนะให้หน่วยงานร่างพิจารณาเพิ่มข้อบังคับในบทที่ 5 ว่านักพัฒนาระบบ AI ต้องมีกลไกการอนุญาตที่ชัดเจน โดยอนุญาตให้เจ้าของเนื้อหาสามารถเลือกที่จะตกลงหรือปฏิเสธการนำผลงานของตนไปใช้ในการฝึกอบรม AI ได้ ขณะเดียวกัน การวิจัยควรสร้างกลไกการจ่ายค่าตอบแทนหรือการแบ่งปันผลประโยชน์ให้กับผู้เขียน เมื่อผลงานของพวกเขาถูกนำไปใช้ในการฝึกอบรมโมเดล AI

ในการเข้าร่วมการอภิปราย นายเหงียน วัน คานห์ สมาชิกคณะผู้แทนรัฐสภาจังหวัดจาลาย ได้หยิบยกประเด็นนี้ขึ้นมาจากมุมมองของผู้บริโภคที่กังวลเมื่อใช้ผลิตภัณฑ์ "AI" หากเกิดเหตุการณ์ที่อยู่นอกเหนือการควบคุมจนเกิดความเสียหาย ใครจะเป็นผู้รับผิดชอบในการชดเชย

รองนายกรัฐมนตรี Canh กล่าวว่า ร่างกฎหมายว่าด้วยปัญญาประดิษฐ์ไม่ได้อธิบายคำว่า “ผลิตภัณฑ์ที่ใช้เทคโนโลยี AI” ผู้บริโภครู้จักเพียงผลิตภัณฑ์ แต่มีเพียงนักวิจัยและนักวิทยาศาสตร์เท่านั้นที่รู้ว่าเทคโนโลยี AI คืออะไร

รองนายกรัฐมนตรี Canh เสนอให้แยก AI อย่างชัดเจนว่าเป็นผลิตภัณฑ์นำเข้า เครื่องมือทางการเงิน ผลิตภัณฑ์กึ่งสำเร็จรูป หรือผลิตภัณฑ์สำเร็จรูป จากนั้นจะมีการกำหนดกฎระเบียบเฉพาะเกี่ยวกับความรับผิดชอบของซัพพลายเออร์

ยกตัวอย่างเช่น AI ถูกผสานเข้ากับผลิตภัณฑ์เพียงอย่างเดียว เมื่อเกิดความเสียหายขึ้น ผู้ขายผลิตภัณฑ์นั้นต้องรับผิดชอบอย่างเต็มที่ และไม่สามารถโทษ AI ได้ “เพราะบริษัทที่ผลิต AI ขาย AI ให้ผม ผมจึงควบคุมมันไม่ได้” - รองหัวหน้า Canh วิเคราะห์

ที่มา: https://baogialai.com.vn/viec-ban-hanh-luat-tri-tue-nhan-tao-la-van-de-cap-bach-post573129.html

การแสดงความคิดเห็น (0)