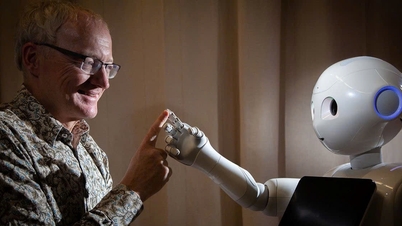

У жовтневому звіті OpenAI було виявлено, що кіберсуб'єкти в усьому світі переважно інтегрують штучний інтелект (ШІ) в існуючі канали атак для покращення продуктивності, а не розробляють абсолютно нові інструменти чи методи атак.

Згідно з OpenAI, значна частина виявленої активності стосувалася використання штучного інтелекту для допомоги у виконанні звичних завдань, таких як розробка шкідливого програмного забезпечення, побудова інфраструктури контролю, створення складніших фішингових електронних листів та збір інформації про цілі.

«Заблоковані команди здебільшого впроваджували штучний інтелект у існуючі процеси, а не створювали нові процеси на основі штучного інтелекту», – йдеться у звіті.

У звіті також було виявлено, що багато груп користувачів використовували великі мовні моделі (LLM) для видобутку знань у різних технічних областях, від розробки додатків до конфігурації мережевих систем, часто таким чином, що кожен обліковий запис спеціалізується на певному завданні.

Було виявлено, що кілька інших мереж користувачів використовують платформи штучного інтелекту для створення онлайн-контенту, включаючи статті, зображення та відео , для проведення медіа-кампаній або просування певних точок зору. Однак більшість цих облікових записів є неефективними, з дуже низьким рівнем залученості.

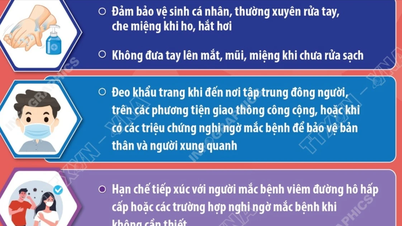

Крім того, OpenAI також зафіксував феномен використання ChatGPT центрами шахрайства та кіберзлочинцями для підтримки онлайн-шахрайської діяльності в М'янмі та Камбоджі. Деякі випадки показують, що ШІ використовується не лише для редагування контенту, але й для управління робочими графіками, людськими ресурсами та фінансами.

Однак, OpenAI зазначає, що штучний інтелект також активно використовується для запобігання шахрайству. За оцінками, ChatGPT використовується втричі частіше для виявлення та уникнення шахрайства, ніж для його скоєння.

Більшість шкідливих запитів система відхиляє, але у звіті зазначається, що все ще існує «сіра зона», де технічні або дослідницькі запити можуть бути використані для непередбачених цілей.

Однак, OpenAI стверджує, що створений код або контент не є шкідливим, доки його не використають поза межами платформи.

(TTXVN/В'єтнам+)

Джерело: https://www.vietnamplus.vn/openai-canh-bao-tin-tac-loi-dung-ai-de-hoat-dong-tinh-vi-hon-post1068941.vnp

![[Фото] Поруч із «горою сміття» після повені мешканці Туй Хоа прагнуть відновити своє життя](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F11%2F24%2F1763951389752_image-1-jpg.webp&w=3840&q=75)

Коментар (0)