Розвиток підзвітності є важливим фактором у просуванні дедалі кориснішого штучного інтелекту. Фото-ілюстрація: Bloomberg. |

Генеративний штучний інтелект (ШІ) змінює багато сфер. В освіті ШІ підтримує навчання, виявляє плагіат і допомагає у викладанні. У медичній сфері ШІ підтримує діагностику зображень, персоналізує схеми лікування та дослідження ліків. Цей інструмент також сприяє автоматичному створенню контенту, підтримує обслуговування клієнтів і створює «віртуальні KOL» у бізнесі та маркетингу.

Поряд з перевагами, поширення генеративного штучного інтелекту також викликає етичні проблеми, оскільки цей інструмент може посилювати упередженість та поширювати дезінформацію. Штучний інтелект також може поставити під загрозу конфіденційність, безпеку даних та стабільність робочої сили.

Подібно до багатьох країн світу , В'єтнам переходить на новий рівень застосування генеративного штучного інтелекту. Щоб штучний інтелект став корисним інструментом, а не шкідливим для людини, відповідальна розробка штучного інтелекту є одним із важливих завдань.

Відповідальні тенденції штучного інтелекту

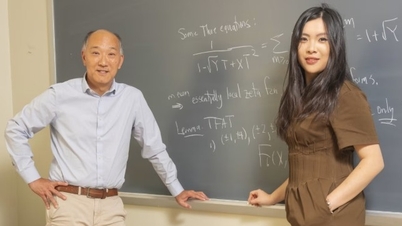

Доктор Сем Гаундар, старший викладач інформаційних технологій у В'єтнамському інституті Королівського технологічного інституту Мельбурна, згадує деякі суперечки навколо етики генеративного штучного інтелекту. Від порноскандалу з Тейлор Свіфт, імітації колишнього президента США Джо Байдена до академічного шахрайства з використанням штучного інтелекту.

«Більше занепокоєння викликають випадки, коли чат-боти підбурюють до самогубства, створюють контент про жорстоке поводження з дітьми, заохочують до вбивств, використовують упереджені алгоритми вербування або вразливості безпеки з боку штучного інтелекту».

«Ці проблеми підкреслюють необхідність людиноцентричного підходу, мінімізації зловживання штучним інтелектом та захисту індивідуальних та суспільних інтересів», – поділився доктор Гундар.

Скріншот інструменту Microsoft Copilot. Фото: Bloomberg. |

За словами доктора Гаундара, у 2025 році спостерігатиметься тенденція до відповідального, орієнтованого на людину штучного інтелекту. Зі зростанням занепокоєння щодо упередженості, дезінформації та етичних ризиків, технологія прозорого штучного інтелекту (XAI) набуває пріоритетного значення, допомагаючи користувачам зрозуміти, як штучний інтелект приймає рішення.

Кілька країн, таких як США, Канада, Австралія, Китай, Японія... почали впроваджувати правила щодо штучного інтелекту для управління та забезпечення етичного впровадження штучного інтелекту в галузі.

Ще однією тенденцією є гібридний штучний інтелект, модель, що поєднує штучний інтелект і людей, яка також може розвинутися у 2025 році.

У сфері сталого розвитку штучний інтелект може допомогти у вирішенні проблеми зміни клімату та просуванні зелених технологій. Крім того, штучний інтелект розширить своє застосування в кібербезпеці, допомагаючи покращити здатність аналізувати ризики та реагувати на загрози в цифровому просторі.

«Оскільки впровадження штучного інтелекту прискорюється, забезпечення відповідального управління ШІ є важливим для оптимізації переваг технології та зменшення потенційних ризиків», – наголосив доктор Гаундар.

Відповідальні рішення для розробки штучного інтелекту

В'єтнам є однією з країн, які активно впроваджують інновації у сфері штучного інтелекту. Тому забезпечення етичного розвитку штучного інтелекту відіграє важливу роль, уникаючи упереджених алгоритмів ШІ, ризиків для конфіденційності та втрати довіри громадськості.

Для розвитку ШІ відповідно до етичних принципів доктор Гаундар запропонував низку рішень, таких як інвестування в дослідження етики ШІ та співпраця з університетами для розробки правової бази для відповідального впровадження ШІ.

Далі, розгляньте інтеграцію етики штучного інтелекту в університетські програми, розширення програм навчання з питань штучного інтелекту для бізнес-лідерів, освітян та політиків.

Просування відповідальності та етики допомагає штучному інтелекту стати корисним інструментом для людей. Фото: Bloomberg. |

Підвищення обізнаності громадськості також важливе, допомагаючи окремим особам та підприємствам зрозуміти вплив штучного інтелекту на конфіденційність. Крім того, це може заохотити застосування штучного інтелекту для соціальних цілей, таких як охорона здоров'я , довкілля та освіта, замість того, щоб зосереджуватися виключно на прибутку.

Окрім освіти та підвищення обізнаності, правові рамки також відіграють важливу роль у підтримці відповідального розвитку штучного інтелекту.

Експерти з RMIT Vietnam запропонували низку рішень, таких як застосування суворіших правил щодо ШІ, наближення до міжнародних моделей управління ШІ, запуск етичної сертифікації ШІ, а також створення системи класифікації ризиків та аудиту ШІ для оцінки та тестування систем високого ризику.

«Оскільки В’єтнам прагне стати регіональним центром розвитку штучного інтелекту до 2030 року, його успіх залежатиме не лише від технологічного прогресу, але й від суворого регулювання, етичних інвестицій у штучний інтелект та обізнаності громадськості щодо боротьби з потенційними ризиками», – наголосив доктор Гундар.

Джерело: https://znews.vn/xu-huong-ai-moi-cua-nam-2025-post1538816.html

![[Фото] Голова Національних зборів Тран Тхань Ман відвідав церемонію нагородження VinFuture 2025](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F05%2F1764951162416_2628509768338816493-6995-jpg.webp&w=3840&q=75)

![[Фото] 60-та річниця заснування В'єтнамської асоціації фотохудожників](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F05%2F1764935864512_a1-bnd-0841-9740-jpg.webp&w=3840&q=75)

Коментар (0)