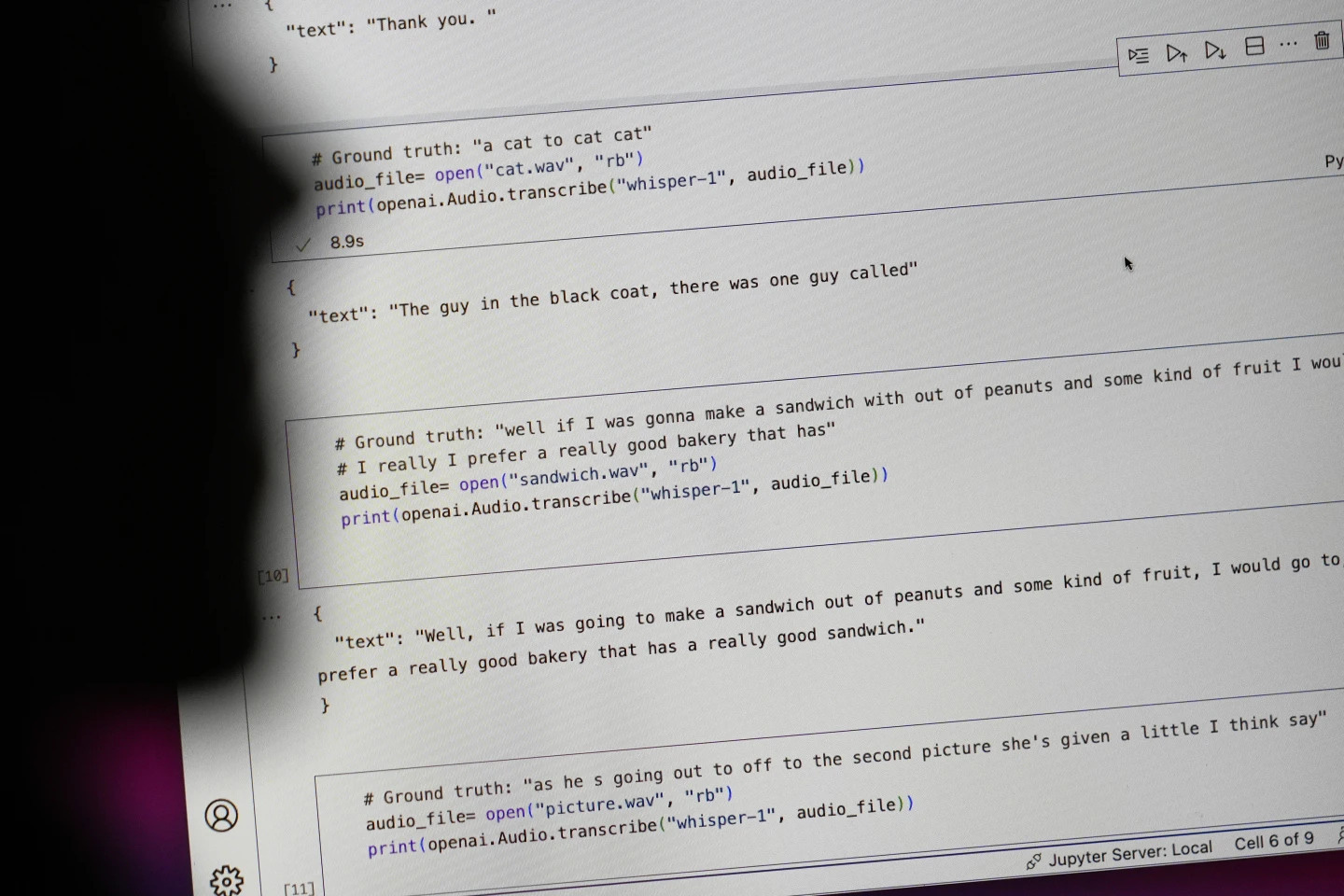

ٹیک وشال اوپن اے آئی نے اپنے اسپیچ ٹو ٹیکسٹ ٹول وِسپر کو 'انسان جیسی درستگی اور مضبوطی' کے ساتھ AI کے طور پر پیش کیا۔ لیکن وسپر میں ایک بڑی خامی تھی: اس نے متن اور جملے بنائے جو مکمل طور پر جعلی تھے۔

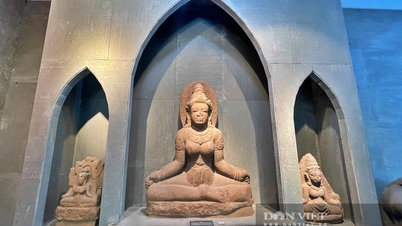

AI سے تیار کردہ کچھ متن - جسے "ہیلوسینیشن" کہا جاتا ہے - میں نسلی تبصرے، پرتشدد زبان اور یہاں تک کہ خیالی طبی علاج بھی شامل ہو سکتا ہے - تصویر: اے پی

اے پی کے مطابق، اے پی کے مطابق، AI سے تیار کردہ کچھ متن نام نہاد "خیالی" ہے، جس میں نسلی تبصرے، پرتشدد زبان اور یہاں تک کہ خیالی طبی علاج بھی شامل ہیں۔

AI سے تیار کردہ متن میں "وہم" کی اعلی شرح

ماہرین کو خاص طور پر تشویش ہے کیونکہ Whisper دنیا بھر کی بہت سی صنعتوں میں انٹرویوز کا ترجمہ اور نقل کرنے، صارفین کی مقبول ٹیکنالوجیز میں متن تیار کرنے اور ویڈیوز کے لیے سب ٹائٹلز بنانے کے لیے وسیع پیمانے پر استعمال ہوتا ہے۔

مزید تشویشناک بات یہ ہے کہ بہت سے طبی مراکز ڈاکٹروں اور مریضوں کے درمیان مشاورت کی منتقلی کے لیے Whisper کا استعمال کر رہے ہیں، حالانکہ OpenAI نے خبردار کیا ہے کہ اس آلے کو "زیادہ خطرہ" والے علاقوں میں استعمال نہیں کیا جانا چاہیے۔

مسئلے کی مکمل حد کا تعین کرنا مشکل ہے، لیکن محققین اور انجینئرز کا کہنا ہے کہ وہ اپنے کام میں باقاعدگی سے وسوسے "فریب" کا سامنا کرتے ہیں۔

مشی گن یونیورسٹی کے ایک محقق نے کہا کہ اس نے جانچ کی دس میں سے آٹھ آڈیو ٹرانسکرپشنز میں "فریب" پایا۔ ایک کمپیوٹر انجینئر کو 100 گھنٹے سے زیادہ آڈیو کے تقریباً نصف ٹرانسکرپشنز میں " فریب نظر " پایا۔ ایک اور ڈویلپر نے کہا کہ اس نے تقریباً تمام 26,000 ریکارڈنگز میں "ہیلوسینیشن" پایا جو اس نے وسپر کا استعمال کرتے ہوئے بنائی۔

مختصر، واضح طور پر ریکارڈ شدہ آڈیو نمونوں کے ساتھ بھی مسئلہ برقرار ہے۔ کمپیوٹر سائنس دانوں کی ایک حالیہ تحقیق میں 13,000 سے زیادہ واضح آڈیو کلپس میں 187 "وہم" پائے گئے۔ محققین نے کہا کہ یہ رجحان لاکھوں ریکارڈنگز میں دسیوں ہزار غلط نقلوں کا باعث بنے گا۔

اس طرح کی غلطیوں کے "انتہائی سنگین نتائج" ہو سکتے ہیں، خاص طور پر ہسپتال کی ترتیبات میں، الوندرا نیلسن کے مطابق، جو بائیڈن انتظامیہ میں گزشتہ سال تک وائٹ ہاؤس آفس آف سائنس اینڈ ٹیکنالوجی کی سربراہ تھیں۔

"کوئی بھی غلط تشخیص نہیں چاہتا،" نیلسن نے کہا، جو اب پرنسٹن، نیو جرسی میں انسٹی ٹیوٹ فار ایڈوانسڈ اسٹڈی کے پروفیسر ہیں۔ "ایک اعلی معیار ہونے کی ضرورت ہے۔"

وسوسے کا استعمال بہروں اور کم سننے والوں کے لیے کیپشن بنانے کے لیے بھی کیا جاتا ہے — ایسی آبادی جو خاص طور پر غلط ترجمہ کے لیے خطرے میں ہے۔ اس کی وجہ یہ ہے کہ بہرے اور کم سننے والے لوگوں کے پاس "دیگر تمام متن میں چھپے ہوئے" من گھڑت اقتباسات کی شناخت کرنے کا کوئی طریقہ نہیں ہے، کرسچن ووگلر کہتے ہیں، جو بہرے ہیں اور گالوڈیٹ یونیورسٹی میں ٹیکنالوجی ایکسیسبیلٹی پروگرام کے ڈائریکٹر ہیں۔

مسئلہ حل کرنے کے لیے اوپن اے آئی سے مطالبہ کیا جاتا ہے۔

اس طرح کے "ہیلوسینیشنز" کے پھیلاؤ نے ماہرین، وکیلوں، اور اوپن اے آئی کے سابق ملازمین کو وفاقی حکومت سے AI ضوابط پر غور کرنے کا مطالبہ کرنے پر مجبور کیا ہے۔ کم از کم، OpenAI کو اس خامی کو دور کرنے کی ضرورت ہے۔

"یہ مسئلہ قابل حل ہے اگر کمپنی اس کو ترجیح دینے کے لیے تیار ہو،" سان فرانسسکو کے ایک ریسرچ انجینئر ولیم سانڈرز نے کہا، جس نے کمپنی کی سمت کے بارے میں خدشات پر فروری میں OpenAI چھوڑ دیا تھا۔

"یہ ایک مسئلہ ہو گا اگر آپ اسے وہاں رکھ دیں اور لوگوں کو اس کے بارے میں اتنا اعتماد ہو جائے کہ یہ کیا کر سکتا ہے کہ وہ اسے ان تمام نظاموں میں ضم کر دیں۔" اوپن اے آئی کے ترجمان نے کہا کہ کمپنی مسلسل "فریب" کو کم کرنے کے طریقوں پر کام کر رہی ہے اور محققین کے نتائج کو سراہتی ہے، انہوں نے مزید کہا کہ اوپن اے آئی ماڈل اپ ڈیٹس میں فیڈ بیک کو شامل کرتا ہے۔

اگرچہ زیادہ تر ڈویلپرز یہ سمجھتے ہیں کہ ٹیکسٹ ٹو اسپیچ ٹولز ٹائپنگ یا دیگر غلطیاں کر سکتے ہیں، انجینئرز اور محققین کا کہنا ہے کہ انہوں نے کبھی بھی AI سے چلنے والا ٹیکسٹ ٹو اسپیچ ٹول نہیں دیکھا جو وسپر جتنا "فریب" کرتا ہے۔

طبیعیات کا نوبل انعام 2024: وہ لوگ جنہوں نے AI کی بنیاد رکھی

طبیعیات کا نوبل انعام 2024: وہ لوگ جنہوں نے AI کی بنیاد رکھیماخذ: https://tuoitre.vn/cong-cu-ai-chuyen-loi-noi-thanh-van-ban-cua-openai-bi-phat-hien-bia-chuyen-20241031144507089.htm

![[تصویر] ہنگری کی پارلیمنٹ کے چیئرمین صدر ہو چی منہ کے مزار پر حاضری دے رہے ہیں۔](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/20/1760941009023_ndo_br_hungary-jpg.webp)

![[تصویر] 10 ویں اجلاس، 15 ویں قومی اسمبلی کا شاندار افتتاح](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/20/1760937111622_ndo_br_1-202-jpg.webp)

![[تصویر] 2025 فال میلے کی اسٹیئرنگ کمیٹی تنظیم کی پیشرفت کا جائزہ لے رہی ہے](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/20/1760918203241_nam-5371-jpg.webp)

تبصرہ (0)