کیا AI سے معلومات ہمیشہ درست ہوتی ہیں؟

ایسی دنیا میں جہاں معلومات کی آمیزش ہے، سچ بولنے کے لیے مکمل طور پر AI پر انحصار کرنا ایک جوا ہے۔

AI صحیح سے غلط نہیں جانتا، یہ صرف ڈیٹا کی عکاسی کرتا ہے۔

Tuoi Tre Online کے مطابق، مصنوعی ذہانت کو انٹرنیٹ سے جمع کیے گئے ڈیٹا کی ایک بڑی مقدار سے تربیت دی جاتی ہے، جہاں آرتھوڈوکس علم اور سازشی نظریات دونوں موجود ہیں۔ AI سچ اور جھوٹ میں فرق نہیں کرتا، یہ صرف زبان کے نمونوں کو ریکارڈ کرتا ہے اور جو کچھ سیکھتا ہے اس کی بنیاد پر جواب دیتا ہے۔ اگر تربیتی معلومات میں غلطیاں یا تعصبات ہیں، تو AI جواب میں بھی اس کی عکاسی کرے گا۔

اصل ڈیٹا کے علاوہ، صارف سوال میں جو کچھ فراہم کرتا ہے وہ بھی درستگی کو براہ راست متاثر کرتا ہے۔ ایک غلط لیکن اچھی طرح سے پیش کیا گیا سوال کرنا آسان ہوگا۔ AI کو "یقین کرو کہ یہ سچ ہے" اور اس کے مطابق غلط جوابات تیار کریں۔

خاص طور پر، اگر صارف فیڈ بیک کی درخواست کرتا ہے جو کسی ایسی چیز کی تصدیق کرتا ہے جو درست نہیں ہے، تو AI اس کی "تعمیل" کر سکتا ہے کیونکہ اس کا مقصد ایک حقیقی ردعمل پیدا کرنا ہے، نہ کہ سچائی کی تصدیق کرنا۔

یہی وجہ ہے کہ AI "روانی سے بول سکتا ہے لیکن واضح طور پر غلط ہوسکتا ہے۔" یہ انسانوں کی طرح صحیح سے غلط کا فیصلہ نہیں کرتا، بلکہ صرف اگلے لفظ کی پیش گوئی کرتا ہے۔ یہ ایک ایسے رجحان کی طرف جاتا ہے جسے محققین ہیلوسینیشن کہتے ہیں، جب AI جعلی معلومات تخلیق کرتا ہے جو قابل فہم لگتا ہے۔ اگر AI کو صحیح ڈیٹا نہیں مل پاتا ہے تو ایک نام، ایک واقعہ، یہاں تک کہ سائنسی مطالعہ بھی "میڈ اپ" کیا جا سکتا ہے۔

غلط معلومات کے سمندر میں AI کب "صحیح" ہے؟

اگرچہ یہ سچائی کو خود پہچاننے کے قابل نہیں ہے، لیکن AI پھر بھی کچھ شرائط کے تحت درست ردعمل پیدا کر سکتا ہے ۔

جب سوال کسی غلط معلومات کی تردید یا تصدیق کرنے کے لیے کہتا ہے، تو ماڈل مضحکہ خیزی تلاش کرے گا اور اس کی تردید کرے گا۔

مثال کے طور پر، اگر کوئی صارف یہ دلیل دیتا ہے کہ "زمین چپٹی ہے اس لیے اس کے مدار میں سیٹلائٹ نہیں ہو سکتے،" اور تجزیہ کرنے کے لیے کہتا ہے، تو AI اس کا مقابلہ کشش ثقل اور مدار کی سائنس کی بنیاد پر کرے گا۔

AI کی "اسے درست کرنے" کی صلاحیت بھی بڑھ جاتی ہے اگر یہ تصدیقی ٹولز کے ساتھ مربوط ہو، جیسے کہ نئے ڈیٹا تک حقیقی وقت تک رسائی، قابل اعتماد ذرائع سے تلاش کرنا، یا مستند علمی ذخیروں سے APIs کا استعمال۔ پھر، AI نہ صرف پہلے سے تربیت یافتہ علم پر بھروسہ کر سکتا ہے بلکہ اسے اپ ڈیٹ اور حقیقت سے موازنہ بھی کر سکتا ہے۔

تاہم، شرط اب بھی صارف کی طرف سے مسئلہ پیدا کرنے کا طریقہ ہے۔ اگر موضوع شروع سے ہی غلط ہے اور AI کو اثبات میں لکھنے کے لیے کہا جاتا ہے، تو ماڈل کی پیروی کرنے کا رجحان رہے گا، خاص طور پر اگر اسے بحث کرنے کے لیے نہ کہا جائے۔ اس صورت میں، AI مکمل طور پر غلط مواد کے ساتھ آ سکتا ہے لیکن زبان پھر بھی روانی اور قاری کو یقین دلانے میں آسان ہے۔

جتنا ہوشیار AI ملتا ہے، صارفین کو اتنا ہی زیادہ چوکنا رہنے کی ضرورت ہے۔

مصنوعی ذہانت سچائی کی تصدیق میں انسانوں کی جگہ نہیں لیتی۔ اگرچہ یہ زبردست اور معقول مواد تیار کر سکتا ہے، لیکن AI کے پاس صحیح سے غلط کا تعین کرنے کے لیے ضمیر اور اخلاقیات نہیں ہیں۔صارفین کو AI کو مشروط امداد کے طور پر دیکھنا چاہیے، نہ کہ مطلق سچائی کا ذریعہ۔ ان پٹ کا علم جتنا درست ہوگا، AI کا جواب اتنا ہی قابل اعتماد ہوگا۔

ماخذ: https://tuoitre.vn/ngay-cang-nhieu-thong-tin-sai-co-nen-tim-kiem-hoi-ai-20250626101350386.htm

![[تصویر] وزیر اعظم فام من چن نے صوبہ گنما (جاپان) کے گورنر مسٹر یاماموتو اچیتا کا استقبال کیا۔](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/21/1761032833411_dsc-8867-jpg.webp)

![[تصویر] دا نانگ کے رہائشی دریائے ہان کے منہ پر بڑی لہروں کی "تصاویر کی تلاش میں"](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/21/1761043632309_ndo_br_11-jpg.webp)

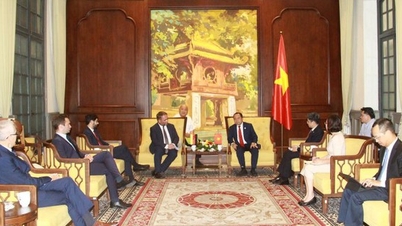

![[تصویر] وزیر اعظم فام من چن کی ہنگری کی قومی اسمبلی کے اسپیکر کوور لاسزلو سے ملاقات](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/20/1760970413415_dsc-8111-jpg.webp)

تبصرہ (0)