بعد المصافحة بين الرئيس الصيني والأمين العام شي جين بينغ والمؤسس ليانغ وينفنغ في مؤتمر الشهر الماضي، زادت العديد من المنظمات في الصين من استخدامها لبرنامج DeepSeek.

في ندوة عقدت في فبراير، أتيحت الفرصة لمؤسس شركة DeepSeek، لونغ فان فونغ، لمصافحة الرئيس الصيني والأمين العام شي جين بينغ.

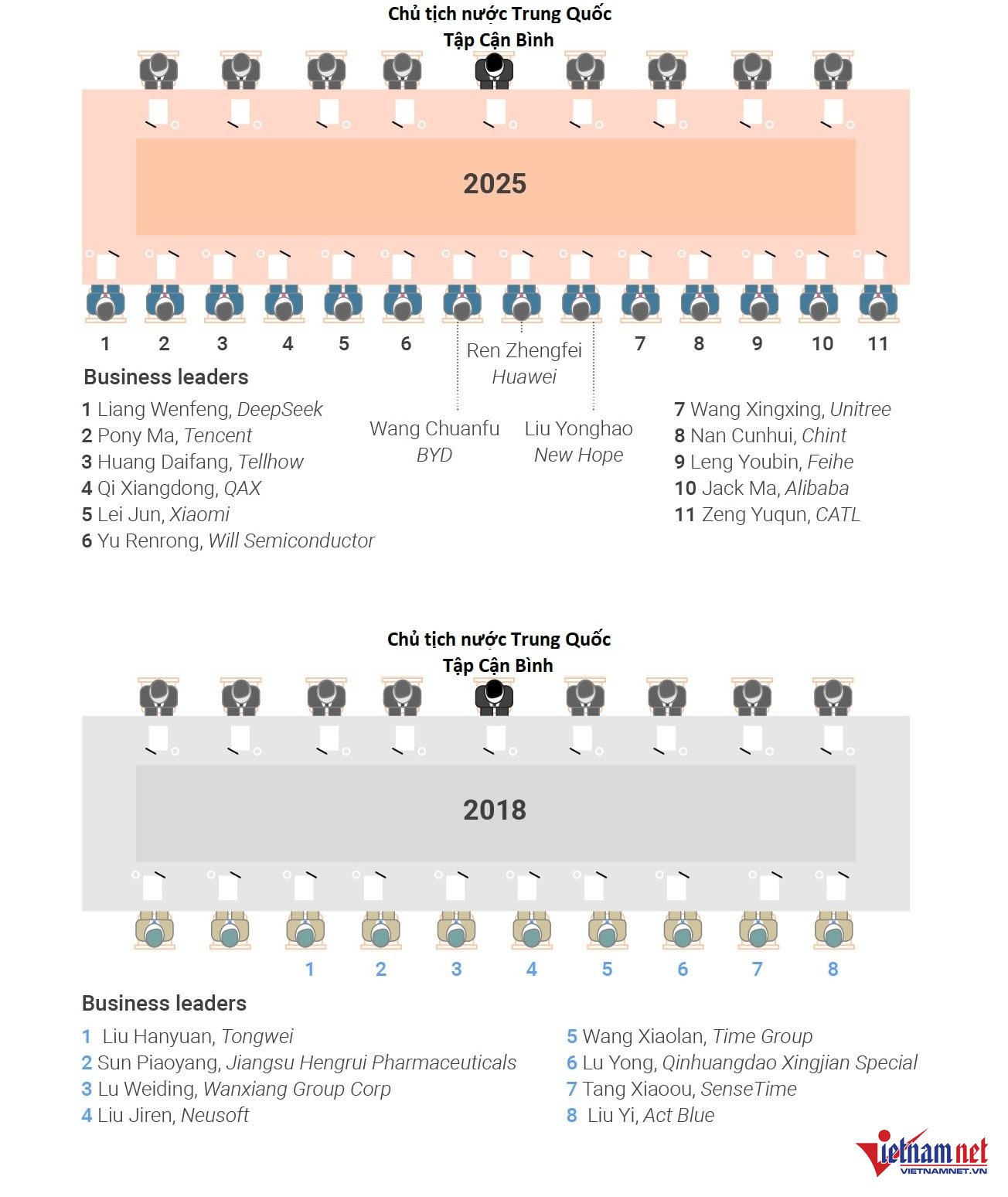

كما جلس في الصف الأمامي إلى جانب شخصيات بارزة أخرى مثل رن تشنغفي من هواوي، وبوني ما من تينسنت، وجاك ما من علي بابا. ومنذ ذلك الحين، ازداد استخدام نموذج الذكاء الاصطناعي "ديب سيك" الذي ابتكره في الوكالات الحكومية.

تستخدم المحاكم برنامج DeepSeek لصياغة الأحكام في غضون دقائق. ويستخدمه الأطباء في فوتشو لتخطيط علاج المرضى. وفي الأمريكتين، يدعم DeepSeek خطًا ساخنًا للحكومة.

يقوم مسؤولو شنتشن بتحليل فيديوهات المراقبة باستخدام تقنية DeepSeek لتحديد هوية الأشخاص المفقودين، وقد نجحوا في ذلك في 300 حالة على الأقل.

أشارت صحيفة نيويورك تايمز إلى أن الاستقبال الحماسي لشركة DeepSeek من قبل الحكومة الصينية يعكس ما يحدث غالبًا عندما يدعم شي جين بينغ شيئًا ما، مثل كرة القدم أو الرياضات الشتوية أو التصنيع عالي التقنية.

ومع ذلك، فإن صعود شركة DeepSeek يثبت أيضًا شيئًا واحدًا: الشركات الصينية قادرة تمامًا على إنتاج أنظمة الذكاء الاصطناعي المتقدمة، مما يقوض ريادة أمريكا في هذه التكنولوجيا الاستراتيجية.

بحسب هوانغ غوانغ بين، خبير الذكاء الاصطناعي في جامعة جنوب شرق نانجينغ، فإن الحكومة الصينية لا ترفض التقنيات الجديدة؛ بل بمجرد تحديد اتجاه واضح، فإنها تروج لها بقوة ونشاط.

خلال الأسابيع القليلة الماضية، أجرت الشرطة الصينية دورات تدريبية على برنامج DeepSeek لموظفيها. وتشجع شركات الخدمات اللوجستية والفنادق العاملين لديها على استخدام هذا البرنامج في التصميم الجرافيكي وخدمة العملاء.

تُعتبر شركة DeepSeek ومؤسسها، لونغ فان فونغ، من رواد الإنترنت الجدد في البلاد. وقد عززت مصافحة شي جين بينغ هذا التأثير. ويُعدّ التواجد في قلب ثاني أكبر اقتصاد في العالم - الذي يضم أكثر من مليار مستخدم للإنترنت - حلم كل شركة ناشئة.

مع ذلك، لا تزال التساؤلات قائمة حول فعالية استخدام تقنية DeepSeek مقارنةً بالأساليب السابقة. فبحسب صحيفة نيويورك تايمز، ورغم تعهد العديد من المسؤولين باستخدام هذا النموذج في عملهم، إلا أن قلة منهم فقط قدمت أمثلة ملموسة على تفوقه.

بالإضافة إلى ذلك، أثار الارتفاع الكبير في الطلب مخاوف بشأن ما إذا كانت شركة DeepSeek تمتلك الموارد البشرية والتقنية الكافية لتلبية هذا الطلب. وقد تعرّضت خدمات الشركة الناشئة لانقطاعات متكررة نتيجة إقبال ملايين الأشخاص على تجربتها. ووفقًا لوسائل الإعلام الصينية، لا يتجاوز عدد موظفي شركة ليانغ وينفنغ 160 موظفًا.

علاوة على ذلك، هناك مخاطر مصاحبة لتسرع المسؤولين الحكوميين في استخدام الذكاء الاصطناعي دون فهم كامل لمخاطره المحتملة.

في مقال نُشر في صحيفة "ذا بيبر"، أوصى تشونغ هويونغ، الباحث في جامعة شنغهاي جياو تونغ، المسؤولين بإعادة تقييم المحتوى المُولّد بواسطة الذكاء الاصطناعي قبل استخدامه، إذ حتى أكثر الأنظمة تطوراً قد تُقدّم معلومات غير دقيقة. كما أن من يعتمدون بشكل مفرط على الذكاء الاصطناعي سيفشلون في إدراك حقيقة الوضع.

تتناقض رغبة المسؤولين الصينيين في تجربة الذكاء الاصطناعي مع ما هو سائد في أجزاء أخرى من العالم. ففي يناير، أطلقت شركة OpenAI نسخة من برنامج ChatGPT مخصصة للجهات الحكومية. ومع ذلك، فإن اللوائح المتعلقة باستخدام الذكاء الاصطناعي في القطاع العام غير متسقة بين مختلف الإدارات.

بالنسبة لشركة ديب سيك، فإن لفت انتباه بكين ليس مفيدًا تمامًا. أولًا، لم تخرج شركات الإنترنت الصينية إلا مؤخرًا من سنوات من القمع الحكومي. وكلما زاد نفوذها، زادت حدة التدقيق الذي تواجهه. أما في الخارج، فقد أثارت شعبية ديب سيك مخاوف لدى الجهات التنظيمية بشأن الرقابة والأمن ومعالجة البيانات. وقد أصدرت أستراليا وكوريا الجنوبية تعليمات لموظفي الحكومة بعدم استخدام ديب سيك.

ثانيًا، أصبحت صلة DeepSeek بالحكومة الصينية ذريعةً لشكاوى المنافسين. فعلى سبيل المثال، راسلت OpenAI مكتب البيت الأبيض لسياسة العلوم والتكنولوجيا محذرةً من أن بكين قد تستخدم DeepSeek "للتلاعب بالنموذج وإلحاق الضرر به".

قام مطور ChatGPT بمقارنة DeepSeek بشركة Huawei وجادل بأن الولايات المتحدة يجب أن تتبنى سياسة تشجع حلفاءها على عدم استخدام مثل هذه التقنيات التي يحتمل أن تكون محفوفة بالمخاطر.

وكتبت شركة OpenAI في الرسالة: "على الرغم من أن الولايات المتحدة لا تزال متقدمة في مجال الذكاء الاصطناعي، إلا أن DeepSeek يوضح أن الفجوة لم تعد واسعة وتضيق تدريجياً".

(بحسب صحيفة نيويورك تايمز، كومن ويلث)

المصدر: https://vietnamnet.vn/cai-bat-tay-voi-ong-tap-giup-deepseek-duoc-sung-ai-2382601.html

تعليق (0)