● Risiken können kontrolliert werden, wenn Unternehmen entsprechende Sicherheitsmaßnahmen implementieren.

● Team8, ein Cybersicherheitsunternehmen aus Israel, hat zu diesem Thema einen Bericht mit Feedback von Informationssicherheitsdirektoren vieler Unternehmen verfasst.

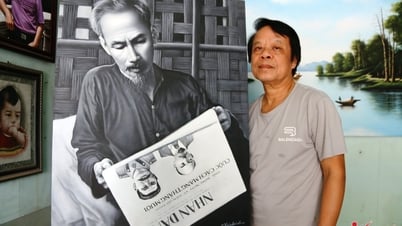

Foto: Gabby Jones/Bloomberg.

Team8, ein israelisches Cybersicherheitsunternehmen, erklärte in einem Bericht, dass Unternehmen, die derzeit einige Anwendungen künstlicher Intelligenz wie ChatGPT verwenden, wahrscheinlich dem Risiko ausgesetzt seien, vertrauliche Kundeninformationen und ihre Geschäftsgeheimnisse preiszugeben.

Der Bericht, der Bloomberg News vor seiner Veröffentlichung zur Verfügung gestellt wurde, besagt, dass der zunehmende Einsatz von KI in Chatbots und Texteditoren viele Unternehmen dem Risiko von Datenschutzverletzungen und Klagen aussetzen könnte. Der Bericht weckt Bedenken, dass Chatbots von Hackern genutzt werden könnten, um vertrauliche Unternehmensinformationen abzugreifen oder andere schädliche Aktivitäten gegen das Unternehmen durchzuführen. Es gibt zudem Bedenken, dass vertrauliche Informationen, die Chatbots derzeit zur Verfügung gestellt werden, künftig von KI-Unternehmen genutzt werden könnten.

Viele große Technologieunternehmen wie Microsoft und Alphabet arbeiten mit Hochdruck an der Integration künstlicher Intelligenz, um ihre Chatbots und Suchmaschinen zu verbessern. Sie trainieren ihre KI-Modelle mit Datensätzen aus dem Internet, um Nutzern ein multifunktionales Tool zur Verfügung zu stellen, das alle ihre Fragen beantworten kann. Dem Bericht zufolge wird es äußerst schwierig sein, vertrauliche oder private Daten zu entfernen, wenn diese Anwendungen mit Daten gefüllt werden.

„Der Einsatz künstlicher Intelligenz im Unternehmensumfeld birgt das Risiko, dass sensible Informationen, geistiges Eigentum, Quellcode, Geschäftsgeheimnisse und andere Daten, die direkt von Nutzern oder über APIs empfangen werden, missbraucht und verarbeitet werden, einschließlich der Privatsphäre der Nutzer und vertraulicher Informationen“, heißt es in dem Bericht. Der Bericht stufte diese Risiken als „hoch“ ein und erklärte, dass sie „beherrschbar“ seien, wenn geeignete Cybersicherheitsmaßnahmen umgesetzt würden.

Der Bericht von Team8 betont, dass Chatbot-Eingaben Unternehmen nicht zur Schulung künstlicher Intelligenz zur Verfügung gestellt werden, im Gegensatz zu jüngsten Berichten, wonach Eingaben von anderen gelesen werden können.

Zum jetzigen Zeitpunkt sind KI-Modelle, die mit umfangreichen Sprachdaten trainiert wurden, nicht in der Lage, sich in Echtzeit zu aktualisieren und daher nicht in der Lage, die Eingaben einer Person zu nutzen, um auf die einer anderen zu reagieren. Daher sind Bedenken hinsichtlich dieser Möglichkeit unbegründet. Zukünftige Versionen dieser Modelle werden jedoch nicht unbedingt ähnliche Eigenschaften aufweisen.

Der Bericht stufte außerdem drei weitere Probleme bei der KI-Integration als „hohes Risiko“ ein und hob die wachsende Bedrohung durch den Informationsaustausch mit Anwendungen von Drittanbietern hervor. Microsoft hat mehrere Chatbot-Funktionen in seine Suchmaschine Bing und die Software-Suite Microsoft 365 integriert.

„Auf der Benutzerseite können beispielsweise Anwendungen von Drittanbietern, die die APIs von Modellen künstlicher Intelligenz nutzen, kompromittiert werden und Zugriff auf die E-Mails und den Webbrowser des Benutzers erhalten, sodass der Eindringling Aktivitäten im Namen dieses Benutzers ausführen kann.“

Der Bericht bewertete außerdem das Risiko als „mittel“, dass der Einsatz künstlicher Intelligenz die Diskriminierung verstärken, den Ruf eines Unternehmens schädigen oder es rechtlichen Schritten im Zusammenhang mit Urheberrechtsfragen aussetzen könnte.

Ann Johnson, Corporate Vice President bei Microsoft, hat zu dem Bericht beigetragen. Microsoft hat Milliarden von Dollar in OpenAI investiert, das Unternehmen, das die ChatGPT-Anwendung entwickelt hat.

„Microsoft fördert eine transparente Diskussion über sich entwickelnde Cyberrisiken innerhalb der Cybersicherheits- und künstlichen Intelligenz-Communitys“, sagte ein Microsoft-Sprecher.

Auch mehrere Chief Information Security Officers (CIS) mehrerer US-Unternehmen haben an dem Bericht mitgewirkt. Der Team8-Bericht wurde zudem von Michael Rogers, dem ehemaligen Vorsitzenden der US-amerikanischen National Security Agency und des US Cyber Command, unterstützt.

Nguyen Quang Minh (laut Bloomberg)

[Anzeige_2]

Quelle

![[Infografik] Rundschreiben zu den Funktionen, Aufgaben und Befugnissen der Provinzabteilung für Kultur, Sport und Tourismus und der Gemeindeabteilung für Kultur und Soziales](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/6/29/877f24989bb946358f33a80e4a4f4ef5)

Kommentar (0)