Η συζήτηση στρογγυλής τραπέζης με τίτλο «Τεχνητή Νοημοσύνη για την ανθρωπότητα: Ηθική και ασφάλεια της ΤΝ στη νέα εποχή» στο πλαίσιο της Εβδομάδας Επιστήμης και Τεχνολογίας VinFuture 2025 συγκεντρώνει επιστήμονες, πολιτικούς και εφευρέτες για να συζητήσουν την υπεύθυνη ανάπτυξη της ΤΝ, με γνώμονα τις ανθρωπιστικές αξίες.

Στο περιθώριο της συζήτησης, ο Καθηγητής Toby Walsh - Πανεπιστήμιο της Νέας Νότιας Ουαλίας (Αυστραλία), Ακαδημαϊκός της Αμερικανικής Ένωσης Υπολογιστικών Μηχανημάτων, μοιράστηκε την ηθική και υπεύθυνη χρήση της Τεχνητής Νοημοσύνης.

Η υπεύθυνη χρήση της Τεχνητής Νοημοσύνης θα πρέπει να είναι υποχρεωτική

- Σύμφωνα με τον καθηγητή, η υπεύθυνη χρήση της Τεχνητής Νοημοσύνης πρέπει να είναι προαιρετική ή υποχρεωτική; Και πώς πρέπει στην πραγματικότητα να συμπεριφερόμαστε απέναντι στην Τεχνητή Νοημοσύνη;

Καθηγητής Τόμπι Γουόλς: Πιστεύω ακράδαντα ότι η υπεύθυνη χρήση της Τεχνητής Νοημοσύνης θα πρέπει να είναι υποχρεωτική. Αυτή τη στιγμή, υπάρχουν αντιφατικά κίνητρα, με τα τεράστια χρηματικά ποσά που κερδίζονται με την Τεχνητή Νοημοσύνη, και ο μόνος τρόπος για να διασφαλιστεί η καλή συμπεριφορά είναι η ύπαρξη αυστηρών κανονισμών, έτσι ώστε το δημόσιο συμφέρον να ισορροπεί πάντα με τα εμπορικά συμφέροντα.

- Μπορείτε να δώσετε συγκεκριμένα παραδείγματα από διαφορετικές χώρες υπεύθυνων και ηθικών εφαρμογών Τεχνητής Νοημοσύνης;

Καθηγητής Τόμπι Γουόλς: Ένα κλασικό παράδειγμα είναι οι αποφάσεις υψηλού διακυβεύματος, όπως η επιβολή ποινής και η επιβολή ποινής στις Ηνωμένες Πολιτείες, όπου ένα σύστημα τεχνητής νοημοσύνης χρησιμοποιείται για να κάνει συστάσεις σχετικά με την ποινή φυλάκισης ενός ατόμου και την πιθανότητα υποτροπής.

Δυστυχώς, αυτό το σύστημα έχει σχεδιαστεί με βάση ιστορικά δεδομένα και αντικατοπτρίζει ακούσια παρελθούσες φυλετικές προκαταλήψεις που οδήγησαν σε διακρίσεις εις βάρος των μαύρων. Δεν πρέπει να αφήνουμε συστήματα σαν κι αυτό να αποφασίζουν ποιος φυλακίζεται.

- Όταν η Τεχνητή Νοημοσύνη κάνει λάθος, ποιος είναι υπεύθυνος; Ειδικά με τους πράκτορες της Τεχνητής Νοημοσύνης, έχουμε τη δυνατότητα να διορθώσουμε τους μηχανισμούς λειτουργίας τους;

Καθηγητής Τόμπι Γουόλς: Το βασικό πρόβλημα όταν η Τεχνητή Νοημοσύνη κάνει λάθη είναι ότι δεν μπορούμε να θεωρήσουμε την Τεχνητή Νοημοσύνη υπεύθυνη. Η Τεχνητή Νοημοσύνη δεν είναι άνθρωπος και αυτό αποτελεί ελάττωμα σε κάθε νομικό σύστημα στον κόσμο . Μόνο οι άνθρωποι είναι υπεύθυνοι για τις αποφάσεις και τις πράξεις τους.

Ξαφνικά, έχουμε έναν νέο «πράκτορα» που ονομάζεται Τεχνητή Νοημοσύνη, η οποία μπορεί – αν της το επιτρέψουμε – να λαμβάνει αποφάσεις και να αναλαμβάνει δράσεις στον κόσμο μας, κάτι που θέτει μια πρόκληση: ποιον θα θεωρήσουμε υπεύθυνο;

Η απάντηση είναι να θεωρηθούν οι εταιρείες που αναπτύσσουν και λειτουργούν συστήματα Τεχνητής Νοημοσύνης υπόλογες για τις συνέπειες που προκαλούν αυτές οι «μηχανές».

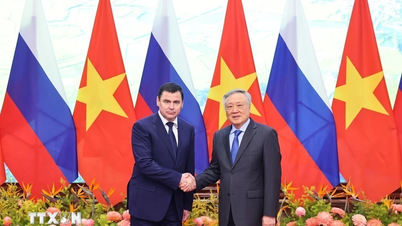

Ο καθηγητής Toby Walsh - Πανεπιστήμιο της Νέας Νότιας Ουαλίας μοιράστηκε την παρουσίασή του στο σεμινάριο «Τεχνητή Νοημοσύνη για την ανθρωπότητα: Ηθική και ασφάλεια της ΤΝ στη νέα εποχή» στο πλαίσιο της Εβδομάδας Επιστήμης και Τεχνολογίας VinFuture 2025. (Φωτογραφία: Minh Son/Vietnam+)

- Πολλές εταιρείες μιλούν επίσης για υπεύθυνη Τεχνητή Νοημοσύνη. Πώς μπορούμε να τις εμπιστευτούμε; Πώς ξέρουμε ότι είναι σοβαρές και ολοκληρωμένες και ότι δεν χρησιμοποιούν απλώς την «υπεύθυνη Τεχνητή Νοημοσύνη» ως τέχνασμα μάρκετινγκ;

Καθηγητής Τόμπι Γουόλς: Πρέπει να αυξήσουμε τη διαφάνεια. Είναι σημαντικό να κατανοήσουμε τις δυνατότητες και τους περιορισμούς των συστημάτων Τεχνητής Νοημοσύνης. Θα πρέπει επίσης να «ψηφίζουμε πράττοντας» – επιλέγοντας να χρησιμοποιούμε τις υπηρεσίες με υπευθυνότητα.

Πιστεύω ακράδαντα ότι ο τρόπος με τον οποίο οι επιχειρήσεις χρησιμοποιούν την Τεχνητή Νοημοσύνη υπεύθυνα θα αποτελέσει διαφοροποιητικό παράγοντα στην αγορά, δίνοντάς τους εμπορικό πλεονέκτημα. Εάν μια εταιρεία σέβεται τα δεδομένα των πελατών, θα ωφεληθεί και θα προσελκύσει πελάτες.

Οι επιχειρήσεις θα συνειδητοποιήσουν ότι το να κάνουν το σωστό δεν είναι μόνο ηθικό, αλλά θα τις κάνει και πιο επιτυχημένες. Το βλέπω αυτό ως έναν τρόπο διαφοροποίησης μεταξύ των επιχειρήσεων, και οι υπεύθυνες επιχειρήσεις είναι αυτές με τις οποίες μπορούμε να νιώθουμε άνετα να συνεργαζόμαστε.

«Αν δεν είμαστε προσεκτικοί, μπορεί να βιώσουμε μια περίοδο ψηφιακού αποικισμού»

- Το Βιετνάμ είναι μία από τις λίγες χώρες που εξετάζουν το ενδεχόμενο ψήφισης του Νόμου για την Τεχνητή Νοημοσύνη. Ποια είναι η εκτίμησή σας για αυτό; Κατά τη γνώμη σας, για τις αναπτυσσόμενες χώρες όπως το Βιετνάμ, ποιες είναι οι προκλήσεις όσον αφορά την ηθική και την ασφάλεια στην ανάπτυξη της Τεχνητής Νοημοσύνης; Ποιες συστάσεις έχει ο καθηγητής για το Βιετνάμ ώστε να επιτύχει τους στόχους του στη στρατηγική της Τεχνητής Νοημοσύνης - να βρεθεί στην κορυφή της περιοχής και του κόσμου στην έρευνα και την αριστεία της Τεχνητής Νοημοσύνης;

Καθηγητής Toby Walsh: Χαίρομαι ιδιαίτερα που το Βιετνάμ είναι μια από τις πρωτοπόρες χώρες που θα έχει έναν ειδικό νόμο για την Τεχνητή Νοημοσύνη. Αυτό είναι σημαντικό επειδή κάθε χώρα έχει τις δικές της αξίες και πολιτισμό και χρειάζεται νόμους για την προστασία αυτών των αξιών.

Οι αξίες και ο πολιτισμός του Βιετνάμ διαφέρουν από την Αυστραλία, την Κίνα και τις Ηνωμένες Πολιτείες. Δεν μπορούμε να περιμένουμε από τις εταιρείες τεχνολογίας από την Κίνα ή τις Ηνωμένες Πολιτείες να προστατεύουν αυτόματα τον πολιτισμό και τη γλώσσα του Βιετνάμ. Το Βιετνάμ πρέπει να αναλάβει την πρωτοβουλία να προστατεύσει αυτά τα πράγματα.

Ο καθηγητής Τόμπι Γουόλς προειδοποιεί ότι αν δεν είμαστε προσεκτικοί, θα μπορούσαμε να βιώνουμε μια περίοδο ψηφιακού αποικισμού. (Φωτογραφία: Minh Son/Vietnam+)

Έχω επίγνωση ότι στο παρελθόν, πολλές αναπτυσσόμενες χώρες πέρασαν μια περίοδο φυσικού αποικισμού. Αν δεν είμαστε προσεκτικοί, θα μπορούσαμε να περάσουμε μια περίοδο «ψηφιακού αποικισμού». Τα δεδομένα σας θα γίνουν αντικείμενο εκμετάλλευσης και θα γίνετε ένας φθηνός πόρος.

Αυτό διακυβεύεται εάν οι αναπτυσσόμενες χώρες αναπτύξουν τη βιομηχανία Τεχνητής Νοημοσύνης με τρόπο που εκμεταλλεύεται μόνο δεδομένα χωρίς να ελέγχει ή να προστατεύει τα δικά της συμφέροντα.

- Πώς λοιπόν θα ξεπεράσουμε αυτή την κατάσταση, κύριε καθηγητά;

Καθηγητής Τόμπι Γουόλς: Είναι απλό, επενδύστε στους ανθρώπους. Αναβαθμίστε τις δεξιότητές τους, βεβαιωθείτε ότι κατανοούν την Τεχνητή Νοημοσύνη. Υποστηρίξτε τους επιχειρηματίες και τις εταιρείες Τεχνητής Νοημοσύνης, υποστηρίξτε τα πανεπιστήμια. Να είστε προνοητικοί. Αντί να περιμένουμε από άλλες χώρες να μας μεταφέρουν τεχνολογία ή να μας καθοδηγήσουν, πρέπει να είμαστε προνοητικοί και να έχουμε την τεχνολογία στην κατοχή μας.

Το πιο σημαντικό είναι ότι πρέπει να υποστηρίξουμε σθεναρά τη δημιουργία ενός ασφαλούς περιβάλλοντος για τους χρήστες στο Βιετνάμ μέσω των πλατφορμών κοινωνικής δικτύωσης, χωρίς να επηρεάζεται η δημοκρατία της χώρας.

Στην πραγματικότητα, υπάρχουν πολλά παραδείγματα για το πώς το περιεχόμενο των μέσων κοινωνικής δικτύωσης έχει επηρεάσει τα αποτελέσματα των εκλογών, έχει διχάσει χώρες, ακόμη και έχει υποκινήσει τρομοκρατία.

- Η Τεχνητή Νοημοσύνη είναι πολύ ανεπτυγμένη στο Βιετνάμ. Πρόσφατα, το Βιετνάμ έχει εφαρμόσει πολλές πολιτικές για την προώθηση της Τεχνητής Νοημοσύνης, αλλά το Βιετνάμ αντιμετωπίζει επίσης ένα πρόβλημα, την απάτη που προκαλείται από την Τεχνητή Νοημοσύνη. Πώς, λοιπόν, πρέπει να χειριστεί το Βιετνάμ αυτή την κατάσταση;

Καθηγητής Toby Walsh: Για τα άτομα, νομίζω ότι ο απλούστερος τρόπος είναι η επαλήθευση των πληροφοριών. Για παράδειγμα, όταν λαμβάνουμε ένα τηλεφώνημα ή ένα email, για παράδειγμα από μια τράπεζα, πρέπει να το ελέγξουμε ξανά: μπορούμε να καλέσουμε πίσω αυτόν τον αριθμό τηλεφώνου ή να επικοινωνήσουμε απευθείας με την τράπεζα για να επαληθεύσουμε τις πληροφορίες. Στις μέρες μας, υπάρχουν πολλά ψεύτικα email, ψεύτικοι αριθμοί τηλεφώνου, ακόμη και οι κλήσεις Zoom μπορούν να είναι πλαστές. Αυτές οι απάτες είναι πολύ απλές, φθηνές και δεν απαιτούν πολύ χρόνο.

Στην οικογένειά μου, έχουμε επίσης το δικό μας μέτρο ασφαλείας: μια «μυστική ερώτηση» που γνωρίζουν μόνο τα μέλη της οικογένειας, όπως το όνομα του κουνελιού μας. Αυτό διασφαλίζει ότι οι σημαντικές πληροφορίες παραμένουν εντός της οικογένειας και δεν διαρρέουν.

- Σας ευχαριστώ πολύ./

Ο καθηγητής Toby Walsh είναι επίτιμος υπότροφος του ARC και καθηγητής Scientia στην Τεχνητή Νοημοσύνη (ΤΝ) στο Πανεπιστήμιο της Νέας Νότιας Ουαλίας στο Σίδνεϊ (UNSW). Είναι ένθερμος υποστηρικτής της θέσπισης ορίων για να διασφαλιστεί ότι η ΤΝ χρησιμοποιείται για τη βελτίωση της ζωής των ανθρώπων.

Είναι επίσης μέλος της Αυστραλιανής Ακαδημίας Επιστημών και έχει συμπεριληφθεί στον διεθνή κατάλογο των «επιδραστικών προσώπων στην Τεχνητή Νοημοσύνη».

(Βιετνάμ+)

Πηγή: https://www.vietnamplus.vn/doanh-nghiep-su-dung-ai-co-trach-nhiem-se-mang-lai-loi-the-thuong-mai-post1080681.vnp

![[Φωτογραφία] Λατρεία του αγάλματος Tuyet Son - ένας θησαυρός σχεδόν 400 ετών στην παγόδα Keo](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764679323086_ndo_br_tempimageomw0hi-4884-jpg.webp&w=3840&q=75)

![[Φωτογραφία] Παρέλαση για τον εορτασμό της 50ής επετείου της Εθνικής Ημέρας του Λάος](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764691918289_ndo_br_0-jpg.webp&w=3840&q=75)

Σχόλιο (0)