Οι υποψήφιοι «αγνοούνται» και η Τεχνητή Νοημοσύνη κάνει λάθη

Η Wafa Shafiq, μια 26χρονη Καναδή επαγγελματίας μάρκετινγκ, αναζητά εργασία από τον χειμώνα του 2024. Ένα βράδυ, υπέβαλε αίτηση για θέση ειδικού μάρκετινγκ και αμέσως έλαβε ένα email από τον «Άλεξ». Αφού απάντησε στις ερωτήσεις αξιολόγησης και προγραμματίστηκε μια συνέντευξη, η Shafiq ανακάλυψε ότι ο Άλεξ ήταν υπεύθυνος προσλήψεων τεχνητής νοημοσύνης από την εταιρεία Apriora.

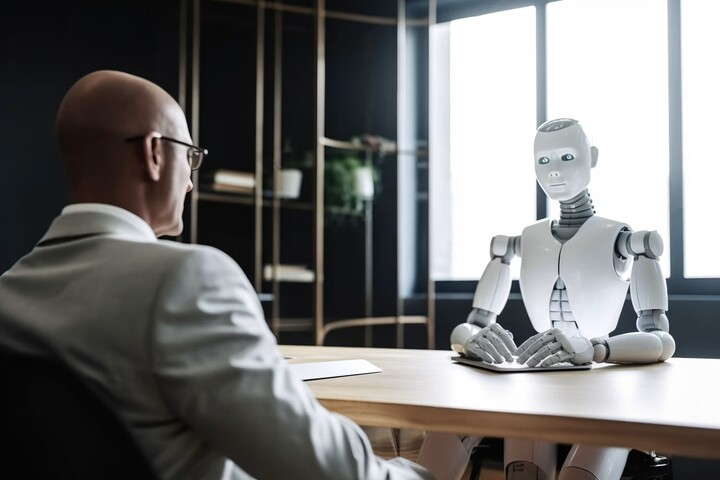

Οι υπεύθυνοι προσλήψεων με τεχνητή νοημοσύνη χρησιμοποιούνται σε κορυφαίες εταιρείες (Πηγή: NBC)

Η συνέντευξη πραγματοποιήθηκε μέσω βίντεο , κάτι που την εξέπληξε. Ενώ της άρεσαν χαρακτηριστικά όπως τα θετικά σχόλια και η ηχογράφηση της συνέντευξης, η Shafiq είπε ότι η εμπειρία ήταν αρκετά μονόπλευρη, καθώς της έλειπαν πληροφορίες για την εταιρεία και την εργασιακή κουλτούρα.

Αναρωτήθηκε επίσης: Αν η Τεχνητή Νοημοσύνη εξαλείψει τις ανθρώπινες προκαταλήψεις, ποιες νέες μπορεί να προκύψουν; «Με αγνόησαν και δεν έλαβα κανένα σχόλιο», είπε στο NBC News. «Αυτό έκανε την εμπειρία ακόμα πιο άτονη».

Μια συνέντευξη με την Τεχνητή Νοημοσύνη μπορεί να κάνει τους υποψηφίους να νιώσουν έλλειψη ενσυναίσθησης (Πηγή: NBC - εικονογράφηση φωτογραφίας)

Παρά το γεγονός ότι δεν ειδοποιήθηκε εκ των προτέρων, ο Wafa Shafiq ολοκλήρωσε τη βιντεοσκοπημένη συνέντευξή του με τον AI Alex χωρίς κανένα πρόβλημα. Ωστόσο, περιστατικά όπως αυτό της φοιτήτριας του Πανεπιστημίου του Οχάιο, Kendiana Colin, υπογραμμίζουν τους κινδύνους της πρόσληψης AI.

Αφού υπέβαλε αίτηση για δουλειά στο Stretch Lab, ο Colin έδωσε συνέντευξη μέσω βίντεο στην τεχνητή νοημοσύνη της Apriora για προσλήψεις. Μετά τις δύο πρώτες ερωτήσεις, η τεχνητή νοημοσύνη άρχισε να επαναλαμβάνει ανοησίες όπως «κάθετη μπάρα Pilates» και ολοκλήρωσε τη συνέντευξη με αμήχανο τρόπο. Ο Colin περιέγραψε την τεχνητή νοημοσύνη ως «τραυλιστή», «διακόπτουσα» και ως κάτι που την έκανε να νιώθει ανατριχιαστική.

Το βίντεο της συνέντευξης του Colin έγινε viral στο TikTok με 3,2 εκατομμύρια προβολές, αλλά δεν έχει λάβει καμία απάντηση από το Stretch Lab ή την Apriora και δεν έχει αναφέρει επίσημα το περιστατικό.

Στις ΗΠΑ, το Υπουργείο Δικαιοσύνης απαιτεί από τις εταιρείες που χρησιμοποιούν Τεχνητή Νοημοσύνη στην πρόσληψη προσωπικού να ενημερώνουν με σαφήνεια τους υποψηφίους σχετικά με την τεχνολογία που χρησιμοποιούν και τον τρόπο αξιολόγησής της. Ωστόσο, στον Καναδά, αυτός ο κανονισμός δεν θα τεθεί σε ισχύ πριν από την 1η Ιανουαρίου 2026.

Οι επιχειρήσεις προωθούν τη χρήση της Τεχνητής Νοημοσύνης στις προσλήψεις

Παρά τα πολλά τεχνικά προβλήματα που έχουν αναφερθεί, μια έρευνα του LinkedIn διαπίστωσε ότι το 74% των επαγγελματιών ανθρώπινου δυναμικού πιστεύουν ότι η Τεχνητή Νοημοσύνη διευκολύνει το φιλτράρισμα των υποψηφίων, ενώ το Resume Builder προβλέπει ότι το 69% των εταιρειών θα χρησιμοποιούν την Τεχνητή Νοημοσύνη για την αξιολόγηση των υποψηφίων έως το 2025.

Η Paradox, η εταιρεία που δημιούργησε την βοηθό προσλήψεων με τεχνητή νοημοσύνη Olivia, συνεργάζεται με μεγάλες εταιρείες όπως η Whole Foods, η Nestle, η FedEx και η Marriott. Η Olivia μπορεί να ελέγχει υποψηφίους, να συνομιλεί μέσω μηνυμάτων, να προγραμματίζει συνεντεύξεις και να στέλνει προσφορές εργασίας.

Στο Fontainebleau Las Vegas, η AI Olivia εξατομικεύτηκε ως Morris για να προσλάβει 6.500 υπαλλήλους. Το αποτέλεσμα: 300.000 αιτήσεις, ξεπερνώντας κατά πολύ τον στόχο των 80.000, συμβάλλοντας στην ολοκλήρωση της διαδικασίας πρόσληψης τρεις μήνες νωρίτερα από το χρονοδιάγραμμα.

Βοηθός προσλήψεων τεχνητής νοημοσύνης, Ολίβια (Πηγή: Paradox)

Η Kim Virtuoso, διευθύντρια ανθρώπινου δυναμικού στο Fontainebleau Las Vegas, δήλωσε ότι το 41% των συζητήσεων μεταξύ των υποψηφίων και του Morris πραγματοποιούνται μετά τη δουλειά. «Έτσι, ενώ κοιμόμαστε ή είμαστε με τις οικογένειές μας, ο Morris μας βοηθά να προσεγγίσουμε τους κατάλληλους υποψηφίους», δήλωσε η Virtuoso.

Η Classet, μια άλλη εταιρεία στον χώρο της προσέλκυσης προσωπικού με τεχνητή νοημοσύνη, επιλέγει να κάνει προσλήψεις μέσω μηνυμάτων κειμένου και τηλεφώνου, αποφεύγοντας το βίντεο, επειδή οι χρήστες θεωρούν «αφύσικο» να αλληλεπιδρούν με ρομπότ μέσω εικόνων.

Ο Διευθύνων Σύμβουλος της Paradox, Άνταμ Γκόντσον, δήλωσε ότι πολλοί υποψήφιοι δημιουργούν σκόπιμα «ψευδαισθήσεις τεχνητής νοημοσύνης» που κάνουν το bot να λέει λάθος πράγματα, επομένως η εταιρεία έχει μια ομάδα για να διατηρεί τη συζήτηση σε καλό δρόμο. Παρά τις αδυναμίες, υποστήριξε: «Η καλύτερη εμπειρία είναι να φέρουμε τον υποψήφιο στον υπεύθυνο λήψης αποφάσεων το συντομότερο δυνατό».

Πηγή: https://vtcnews.vn/tuyen-dung-bang-ai-cach-mang-nhan-su-hay-tham-hoa-quyen-rieng-tu-ar954417.html

![[Φωτογραφία] Ο Πρόεδρος της Εθνοσυνέλευσης, Tran Thanh Man, παρευρίσκεται στην τελετή απονομής βραβείων VinFuture 2025](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F05%2F1764951162416_2628509768338816493-6995-jpg.webp&w=3840&q=75)

![[Φωτογραφία] 60ή επέτειος από την ίδρυση του Συνδέσμου Φωτογραφικών Καλλιτεχνών του Βιετνάμ](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F05%2F1764935864512_a1-bnd-0841-9740-jpg.webp&w=3840&q=75)

Σχόλιο (0)