Incidentes recientes que involucran sesgo y falsificación de documentos han hecho que los académicos reconsideren el nivel apropiado de participación de la IA en la investigación.

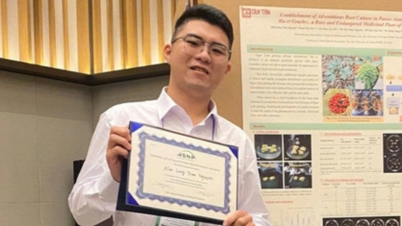

Recientemente, en su página personal, el profesor y doctor en Lingüística Nguyen Van Hiep compartió una historia que impactó a los lectores. Descubrió que una IA había falsificado sus documentos con información enviada por un amigo. También descubrió accidentalmente que el artículo del profesor asociado y doctor en Ciencias Tran Van Co también había sido falsificado por IA.

La IA se ha convertido en una parte indispensable de la vida humana; sin embargo, los expertos siempre enfatizan que solo debemos considerarla como una herramienta de apoyo. Los usuarios de IA deben estar siempre alerta y ser expertos para procesar datos y evaluar los resultados obtenidos tras cooperar con ella. En particular, en la investigación científica, numerosos estudios han demostrado que el mayor problema al que hay que prestar atención es el sesgo en los datos y modelos. Si no se controla adecuadamente, la IA puede estar sesgada, distorsionar los resultados de los análisis, generar prejuicios o discriminación, y manipular la información.

En particular, el uso de la IA en la investigación en ciencias sociales requiere mucha más cautela. Dado que campos como la filosofía, la lingüística, la etnología y la historia, entre otros, toman como objeto de investigación el comportamiento, la cultura y la conducta humanos, los datos suelen estar estrechamente vinculados al contexto sociocultural vietnamita, con profundidad y especificidad. Si los datos de entrenamiento de la IA reflejan prejuicios históricos, existe el riesgo de que la IA extraiga conclusiones que exacerben los problemas de desigualdad de género, clase, raza o región geográfica. El riesgo es aún mayor cuando se utiliza la IA para analizar el comportamiento humano, responder a encuestas abiertas o participar en contenido mediático.

Según algunos expertos en ciencias sociales, actualmente la IA tiene dificultades para acceder a fuentes de datos con derechos de autor o de pago, lo que da como resultado información que no está completamente actualizada.

El fenómeno de la fabricación de documentos para crear historias plausibles suele ocurrir en temas menos populares, en idiomas con fuentes de datos limitadas, como el vietnamita, y debe advertirse a los usuarios. Los sistemas de IA, en general, tienen actualmente una comprensión muy limitada del contexto social y cultural, por lo que su asistencia para interpretar el conocimiento ambiguo y rico en metáforas de las ciencias sociales no es realmente fiable.

Aunque aporta mucho potencial a la investigación científica, la aplicación de la IA necesita ser muy cuidadosa, tiene límites y debe ir siempre de la mano de la capacidad de pensamiento crítico del investigador.

Se puede observar que, si bien ofrece un gran potencial para la investigación científica, su aplicación debe ser muy cautelosa, limitada y siempre acompañada de la capacidad crítica del investigador. Quien utilice la IA debe identificar claramente estas limitaciones, asegurándose de que no altere los valores fundamentales de la ciencia. Para proteger la integridad de la investigación científica, el rol y la responsabilidad de los científicos deben alcanzar un nuevo nivel. Además, es necesario proponer un marco ético de IA legalmente vinculante en el contexto de la cultura, las tradiciones y las normas sociales vietnamitas.

Contamos con un sistema de nueve principios para promover la investigación y el desarrollo de sistemas de IA seguros y responsables, limitar los impactos negativos y controlar los riesgos propuestos por el Ministerio de Ciencia y Tecnología , que enfatiza la seguridad de los datos, así como el respeto por los derechos humanos y la dignidad, y la rendición de cuentas de los usuarios de IA. Particularmente en investigación científica, el Consejo Estatal de Profesores también emitió el Despacho Oficial No. 25/HDGSNN en 2023, solicitando que los consejos de títulos de profesores de la industria y las instalaciones para evaluar la calidad de los trabajos científicos presten especial atención a la detección y evaluación de trabajos que utilizan o son asistidos por tecnología de IA. Estos requisitos tienen como objetivo garantizar que los resultados de la investigación que utiliza IA sigan cumpliendo con los estándares científicos, previniendo el abuso de la IA en la investigación y publicación científica.

En el futuro, cuando se promulgue la Ley de Inteligencia Artificial, con regulaciones estrictas relacionadas con la ética y la responsabilidad en el uso de la IA, contribuirá a crear un entorno saludable para el desarrollo de la IA, brindando un apoyo más activo y responsable a los científicos en el trabajo de investigación.

Fuente: https://nhandan.vn/canh-giac-voi-mat-trai-cua-ai-post916545.html

![[Foto] Solemne apertura de la X Sesión de la XV Asamblea Nacional](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/20/1760937111622_ndo_br_1-202-jpg.webp)

![[Foto] El Comité Directivo de la Feria de Otoño 2025 revisa el avance de la organización](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/20/1760918203241_nam-5371-jpg.webp)

![[Video] El mercado de flores y regalos en la ciudad de Ho Chi Minh se llena de vida con motivo del 20 de octubre.](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/10/20/1760931107653_720-jpg.webp)

![[Video] Líderes de partidos y estados y diputados de la Asamblea Nacional visitan el Mausoleo del Presidente Ho Chi Minh](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/10/20/1760929911350_img-1885-4872-png.webp)

![[Foto] El presidente del Parlamento húngaro visita el mausoleo del presidente Ho Chi Minh](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/20/1760941009023_ndo_br_hungary-jpg.webp)

Kommentar (0)