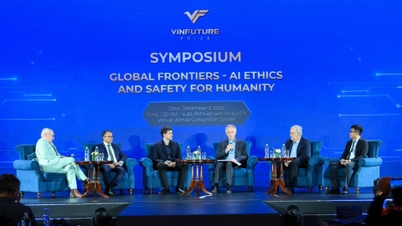

پروفسور توبی والش در میزگرد «هوش مصنوعی برای بشریت - اخلاق و ایمنی هوش مصنوعی در عصر جدید» - فعالیتی در هفته علم و فناوری VinFuture Prize 2025 - سخنرانی کرد.

پروفسور توبی والش، استاد دانشگاه نیو ساوت ولز، سیدنی، استرالیا و همچنین محقق ارشد CSIRO Data61، یک مرکز علمی پیشرو در استرالیا، که ۴۰ سال در زمینه هوش مصنوعی تحقیق کرده است، گفت که در ۳۰ سال اول فقط «به چگونگی توسعه هرچه قدرتمندتر هوش مصنوعی علاقهمند بوده» اما در ۱۰ سال گذشته «به طور فزایندهای به توسعه مسئولانه هوش مصنوعی علاقهمند شده و در این مورد ابراز علاقه کرده است».

پروفسور والش با اشاره به مثال استفاده از یک سیستم هوش مصنوعی در ایالات متحده که از دادههای تاریخی نژادپرستانه استفاده میکرد و منجر به صدور احکام تبعیضآمیز علیه سیاهپوستان شد، بر لزوم استفاده مسئولانه از هوش مصنوعی تأکید کرد.

توبی والش گفت: «شرکتهایی که سیستمهای هوش مصنوعی را مستقر و اداره میکنند، باید در قبال عواقبی که این ماشینها ایجاد میکنند، پاسخگو باشند.»

او گفت برای اینکه کسبوکارها را مجبور به استفاده از «هوش مصنوعی مسئولانه» کنیم، کاربران «به شفافیت بیشتری نیاز دارند. درک قابلیتها و محدودیتهای سیستمهای هوش مصنوعی مهم است. ما همچنین باید «با عمل کردن رأی دهیم»، یعنی انتخاب کنیم که از خدمات مسئولانه استفاده کنیم. تبدیل استفاده مسئولانه از هوش مصنوعی به یک مزیت تجاری برای کسبوکارها، راه خوبی برای تنظیم رفتار آنهاست.

از دام «استعمار دیجیتال» فرار کنید

پروفسور توبی والش، در میان خطراتی که هوش مصنوعی به همراه دارد، به ویژه بر احتمال «استعمار دیجیتالی» تأکید کرد. او گفت: «من کاملاً آگاه هستم که در گذشته، بسیاری از کشورهای در حال توسعه دورهای از استعمار فیزیکی را پشت سر گذاشتهاند. اگر مراقب نباشیم، ممکن است دورهای از استعمار دیجیتالی را تجربه کنیم. دادههای شما مورد سوءاستفاده قرار خواهد گرفت و شما به یک منبع ارزان تبدیل خواهید شد. اگر کشورهای در حال توسعه صنعت هوش مصنوعی را به گونهای توسعه دهند که فقط از دادهها سوءاستفاده کند، بدون اینکه حقوق خود را کنترل و محافظت کنند، این امر در معرض خطر است.»

به گفته او، برای فرار از این خطر، ترویج ارزشهای منحصر به فرد، فرهنگ بومی و نیاز به قوانینی برای محافظت از آن ارزشها ضروری است.

پروفسور توبی والش تأکید کرد: «من بسیار خوشحالم که ویتنام یکی از کشورهای پیشگامی است که قانون تخصصی هوش مصنوعی خواهد داشت. ارزشها و فرهنگ ویتنام با استرالیا، چین و ایالات متحده متفاوت است. ما نمیتوانیم انتظار داشته باشیم که شرکتهای فناوری از چین یا ایالات متحده به طور خودکار از فرهنگ و زبان ویتنامی محافظت کنند. این موارد باید توسط خود ویتنام به طور پیشگیرانه محافظت شوند.»

علاوه بر این، او معتقد است که ما باید به طور فعال روی افراد سرمایهگذاری کنیم، مهارتهای همه، کارآفرینان، کسبوکارهای هوش مصنوعی، دانشگاهها و... را بهبود بخشیم تا آنها هوش مصنوعی را درک کنند. پروفسور توبی والش میگوید: «به جای اینکه منتظر بمانیم کشورهای دیگر فناوری را منتقل کنند یا راهنمایی کنند، باید فعال باشیم و بر فناوری تسلط پیدا کنیم.»

در کنار آن، به گفته پروفسور توبی والش، لازم است پلتفرمهای شبکههای اجتماعی به شدت بسیج شوند تا محیطی امن برای کاربران در ویتنام به طور خاص و در جهان به طور عام ایجاد شود، در حالی که بر دموکراسی این کشور تأثیری نگذارد.

پروفسور توبی والش نویسنده سه کتاب در مورد هوش مصنوعی است: «این زنده است! هوش مصنوعی از پیانوی منطقی تا رباتهای قاتل» تاریخچه و توسعه فعلی هوش مصنوعی را پوشش میدهد؛ «۲۰۶۲: جهانی که هوش مصنوعی ساخت» تأثیر بالقوه هوش مصنوعی بر جامعه بشری را بررسی میکند. کتاب سوم او، «ماشینهایی که بد رفتار میکنند: اخلاق هوش مصنوعی»، به چالشهای اخلاقی هوش مصنوعی میپردازد. پروفسور توبی والش مهمان دائمی کانالهای تلویزیونی معروفی مانند ABC، BBC، CNN، DW، NPR، RT و... با موضوع تأثیر هوش مصنوعی و رباتها بر جامعه است. او همچنین نویسندهای است که مقالات زیادی در The New Scientist، American Scientist، Le Scienze، Cosmos، Technology Review، The New York Times، The Guardian، The Conversation و... منتشر کرده است. |

منبع: https://doanhnghiepvn.vn/cong-nghe/giao-su-toby-walsh-canh-bao-ve-nguy-co-bi-do-ho-so-strong-thoi-dai-ai/20251203061618510

![[عکس] رژه به مناسبت پنجاهمین سالگرد روز ملی لائوس](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764691918289_ndo_br_0-jpg.webp&w=3840&q=75)

![[عکس] پرستش مجسمه تویت سون - گنجینهای تقریباً ۴۰۰ ساله در پاگودای کئو](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764679323086_ndo_br_tempimageomw0hi-4884-jpg.webp&w=3840&q=75)

نظر (0)