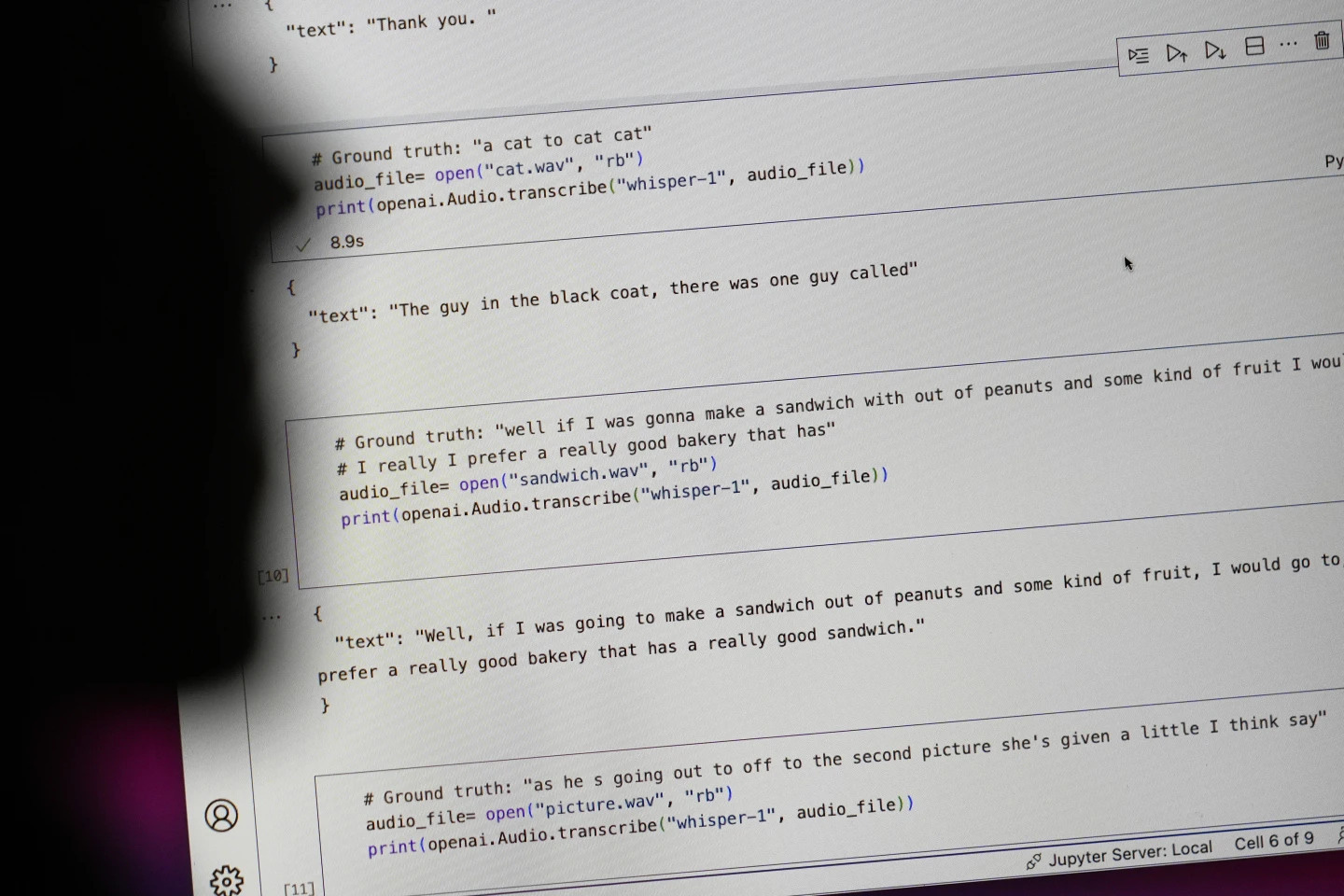

テクノロジー大手のOpenAIは、自社の音声テキスト変換ツール「Whisper」を「人間のような正確さと堅牢性」を備えたAIだと宣伝した。しかし、Whisperには大きな欠陥があった。それは、全く偽のテキストや文章を生成してしまうことだった。

AIが生成したテキストの中には「幻覚」と呼ばれるものがあり、人種差別的なコメントや暴力的な言葉、さらには架空の医療行為まで含まれている可能性がある。写真:AP

AP通信によると、AIが生成したテキストの一部は、人種差別的なコメントや暴力的な言葉、さらには架空の医療処置など、いわゆる「幻覚的」なものだと専門家は述べている。

AI生成テキストにおける「錯覚」の割合が高い

専門家らが特に懸念しているのは、ウィスパーがインタビューの翻訳や文字起こし、人気の消費者向け技術でのテキスト生成、動画の字幕作成など、 世界中の多くの業界で広く利用されているからだ。

さらに懸念されるのは、OpenAIがこのツールは「高リスク」地域では使用すべきではないと警告しているにもかかわらず、多くの医療センターが医師と患者の間で診察を転送するためにWhisperを使用していることだ。

問題の全容を解明するのは難しいが、研究者や技術者らは仕事でウィスパーによる「幻覚」に頻繁に遭遇していると述べている。

ミシガン大学の研究者は、調査した音声転写10件のうち8件に「幻覚」が見られたと述べています。あるコンピューターエンジニアは、100時間以上の音声を分析した転写の約半数に「幻覚」が見られたと述べています。別の開発者は、Whisperを使って作成した2万6000件の録音のほぼすべてに「幻覚」が見られたと述べています。

この問題は、短く明瞭に録音された音声サンプルでも依然として存在します。コンピュータ科学者による最近の研究では、1万3000本以上の明瞭な音声クリップを調査し、その中に187の「錯覚」が見つかりました。研究者らによると、この傾向は数百万件の録音において数万件もの誤った書き起こしにつながる可能性があるとのことです。

昨年までバイデン政権でホワイトハウス科学技術局を率いていたアロンドラ・ネルソン氏によると、こうした誤りは特に病院の現場で「非常に深刻な結果」をもたらす可能性があるという。

「誤診は誰も望んでいません」と、現在ニュージャージー州プリンストン高等研究所の教授を務めるネルソン氏は述べた。「より高い基準が必要です。」

Whisperは、特に誤訳のリスクが高い聴覚障害者や難聴者向けの字幕作成にも利用されています。これは、聴覚障害者や難聴者には「他のテキストの中に隠れている」捏造された文章を見分ける手段がないためです、とギャローデット大学でテクノロジーアクセシビリティプログラムのディレクターを務める聴覚障害者のクリスチャン・フォーグラー氏は言います。

OpenAIは問題解決に求められている

このような「幻覚」の蔓延を受け、専門家、支援者、そしてOpenAIの元従業員たちは、連邦政府に対しAI規制の検討を求めています。少なくとも、OpenAIはこの欠陥に対処する必要があります。

「企業が優先的に取り組む意思があれば、この問題は解決できる」と、同社の方向性に対する懸念から2月にオープンAIを去ったサンフランシスコの研究エンジニア、ウィリアム・サンダース氏は述べた。

「もしそれを公開したら、人々がその機能に自信を持ちすぎて、他のシステムに統合してしまうような事態になれば問題です」OpenAIの広報担当者は、同社は「錯覚」を軽減する方法を常に模索しており、研究者の発見を高く評価していると述べ、OpenAIはフィードバックをモデルの更新に反映させていると付け加えた。

ほとんどの開発者は、音声合成ツールはタイプミスやその他の間違いを起こす可能性があると想定しているが、エンジニアや研究者は、Whisper ほど「幻覚を起こす」 AI 搭載音声合成ツールは見たことがないと述べている。

2024年ノーベル物理学賞:AIの基盤を築いた人々

2024年ノーベル物理学賞:AIの基盤を築いた人々[広告2]

出典: https://tuoitre.vn/cong-cu-ai-chuyen-loi-noi-thanh-van-ban-cua-openai-bi-phat-hien-bia-chuyen-20241031144507089.htm

![[写真] ダナン:数百人が嵐13号後の重要な観光ルートの清掃に協力](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/07/1762491638903_image-3-1353-jpg.webp)

コメント (0)