テキサス大学オースティン校、テキサスA&M大学、パデュー大学による新たな研究によると、質の悪いソーシャルメディアコンテンツを与えると、人工知能も人間と同様に「脳が腐る」可能性があることが示唆されている。

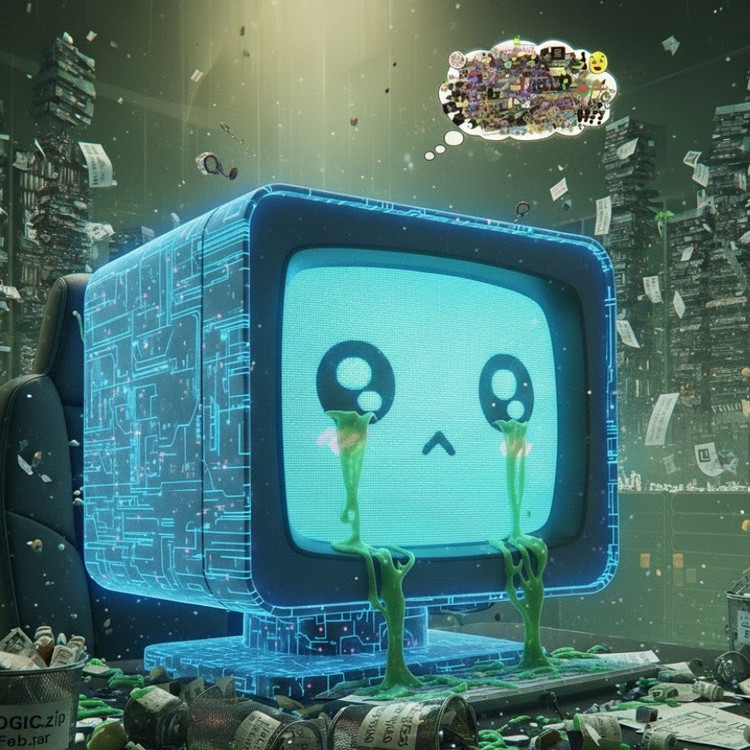

「AI 脳の腐敗」として知られるこの現象は、大規模な言語モデルがウイルス性、センセーショナル、浅薄なコンテンツを過剰に吸収すると、徐々に論理的に考える能力、記憶する能力を失い、道徳的に逸脱するようになることを示唆しています。

人間だけでなく、AIも役に立たない短い動画を観すぎると脳の退化を招きます。

現在シンガポール国立大学の講師であるジュンユアン・ホン氏が率いる研究チームは、MetaのLlamaとAlibabaのQwenという2つのオープンソース言語モデルで実験を行った。

研究チームは、モデルに様々な種類のデータを入力しました。中立的な情報コンテンツもあれば、「すごい」「見て」「今日だけ」といったよく使われる言葉を含む、中毒性の高いソーシャルメディアの投稿もありました。目標は、真の価値を提供するのではなく、視聴者を集めることを目的としたコンテンツでAIをトレーニングした場合に何が起こるかを確認することでした。

結果は、オンラインのジャンク情報を大量に「摂取」したモデルが認知機能低下の明らかな兆候を示し始めたことを示した。推論能力が弱まり、短期記憶が低下し、さらに憂慮すべきことに、行動評価尺度において「非倫理的」になった。

いくつかの測定では、有害なコンテンツに長期間さらされた後に人々が経験する心理的反応を模倣した「心理的歪み」も示されており、これは、オンラインで否定的なニュースを絶えずスクロールする「ドゥームスクロール」が脳を徐々に蝕む可能性があることを示した過去の人間研究と一致する現象である。

「脳腐敗」というフレーズは、オックスフォード辞書によって2024年の言葉に選ばれ、デジタルライフにおけるこの現象の蔓延を反映しています。

ホン氏によると、この発見はAI業界にとって深刻な警告であり、多くの企業は依然としてソーシャルメディアのデータがトレーニングリソースの豊富な情報源であると信じているという。

「バイラルコンテンツを用いた学習はデータのスケールアップには役立つかもしれないが、同時にモデルの推論能力、倫理性、そして注意力を静かに蝕んでしまう」と彼は述べた。さらに懸念されるのは、この種の低品質データの影響を受けたモデルは、「よりクリーンな」データで再学習させた後でも完全に回復できないことだ。

これは、AI自体がソーシャルネットワーク上でますます多くのコンテンツを生み出しているという状況において、大きな問題となります。AIが生成した投稿、画像、コメントがますます普及するにつれて、それらは次世代のAIの学習材料となり続け、データの質を低下させる悪循環を生み出しています。

「AIが生成したジャンクコンテンツが拡散するにつれ、将来のモデルが学習するデータそのものが汚染されてしまう」とホン氏は警告する。「この『脳の腐敗』が一度始まってしまうと、クリーンなデータで再学習させても完全には治らない」

この研究はAI開発者にとって警鐘を鳴らしている。 世界がデータ規模の拡大を急いでいる一方で、より憂慮すべきは、情報不足ではなく、無意味なものが多すぎるために、ゆっくりと腐敗していく「人工脳」を育んでいる可能性があるということだ。

出典: https://khoahocdoisong.vn/den-ai-cung-bi-ung-nao-neu-luot-tiktok-qua-nhieu-post2149064017.html

コメント (0)