WSJ記者のジョアンナ・スターンは、AIを使って偽の自分自身を作成し、家族と銀行システムの両方を騙そうとした。

人工知能(AI)を用いて動画に顔や偽の声を挿入する行為、いわゆるディープフェイクは、ますます一般的になり、危険性も高まっています。これはインターネットにおける真の危険です。

ディープフェイクは、センシティブな動画に加え、 政治目的で利用された場合、深刻な被害をもたらす可能性があります。2018年に拡散した、バラク・オバマ前米国大統領の顔を加工する動画は、政治家も被害者になり得ることを示しました。

|

ディープフェイクポルノは世界的な問題になりつつある。写真: Wired |

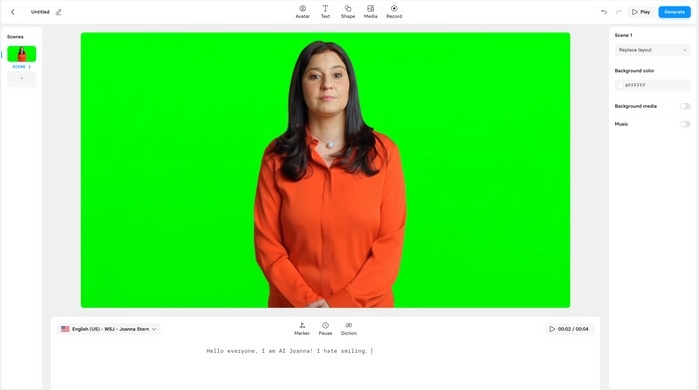

AIの有効性を検証するため、 WSJ記者のジョアンナ・スターンはディープフェイクツール「Synthesia」を使い、自身のクローンを作成しました。その結果、クローンは彼女の家族と銀行システムの両方を欺くことができました。

完璧なコピー

スターン氏は、自身のクローンを作成するまでの道のりを振り返り、シンセシアの実験と、自身のオリジナル動画や音声ファイルからのAIのトレーニングに何カ月も費やしたと語った。

このツールの使い方も非常に簡単で、ユーザーはテキストを入力するだけで、そのコンテンツについて話している自分の声が付いた新しいビデオを受け取ることができます。

「私の仕事は、セリフや画面上での作業を多く必要とするため、AIによって効率が上がり、大変な作業の一部が軽減されると考えました」とスターン氏は語った。

|

ジョアンナ・スターンは、シンセシアのAIを訓練するために自分の声を録音している。写真: WSJ |

このツールを訓練するため、ウォール・ストリート・ジャーナルの記者がレコーディングスタジオに行き、約30分かけて自分の姿を撮影し、2時間かけて自分の声を録音した。数週間のうちに、スターン氏が「ジョアンナAI」と名付けたバーチャル版は、彼女の仕事に取り組める状態になった。

スターンは休暇を利用してJoanna AIを活用。WSJ記者としての最初の仕事として、ChatGPTを使ってiOSのヒント集TikTok動画の台本を作成した。

スターンはテキストをSynthesiaに貼り付けました。初期化後、彼女の声がビデオに重ねて聞こえました。「手のジェスチャーや表情は少し違っていましたが、まるで鏡に映った自分の姿を見ているようでした。とても説得力がありました」と記者はコメントしました。

スターン氏は、ジョアンナAIは短い文章では優れた模倣能力を発揮するが、文章が長くなるにつれてその弱点が明らかになると述べた。

スターン氏は、短編動画プラットフォームがAIにとって最も適した環境である理由もこれだと述べた。彼女によると、TikTokのユーザーは動画の細部にあまり注意を払わないことが多く、コンピューター的な特徴を見逃しやすいという。

電話通話に関しては、SternはSynthesiaではなくElevenLabsという別のAIアプリを使用しています。このAI音声ソフトウェアの利点は、ユーザーが録音スタジオに行くことなく、音声ファイルをツールにアップロードするだけで済むことです。

|

スターン氏によると、ジョアンナAIは短い文章であれば優れた模倣能力を備えているという。写真: WSJ |

WSJの記者は、ElevenLabsがわずか2分で彼女の声を複製できたことに驚きました。注目すべきは、このアプリケーションの使用料が月額わずか約5ドルだということです。

スターンは、Synthesia と比較して、ElevenLabs でクローン化された自分の声は、イントネーションや発音も良く、より人間らしく聞こえるとコメントしました。

信憑性を確かめるため、記者はAIの声を使って親戚に話しかけてみた。スターンの妹は、AIの声は息継ぎをしない点を除けば、彼女によく似ていると述べた。

一方、スターン氏がAI音声を使って父親に電話をかけ、社会保障番号を尋ねたところ、録音された音声ファイルのように聞こえたため、すぐに何かがおかしいことに気づいたという。

銀行を騙す

最も注目すべきは、AIが非常に効果的で、スターンのチェースクレジットカードの音声生体認証システムを騙したことだ。

WSJの記者はまず、ジョアンナAIにチェイスが尋ねるであろう質問をいくつか教えました。その後、ジョアンナはカスタマーサービスに電話をかけ、AIに答えてもらいました。

|

AIは非常に効果的で、スターンのチェース銀行クレジットカードの音声生体認証システムを欺くことができた。写真: WSJ |

生体認証の段階で、自動システムが彼女の名前と住所を尋ねると、ジョアンナAIは正式に応答しました。AIの声を聞くとすぐに、チェースのシステムはそれがスターンだと認識し、銀行の担当者に繋ぎました。

テストが成功した後、スターンはチェース銀行に直接連絡し、同銀行とは取引がないと伝えた。

チェース銀行の広報担当者はその後、同行は発信者の確認に音声生体認証とその他のツールを活用していると述べた。

チェース銀行は、この機能は顧客が迅速かつ安全に本人確認を行えるようにするためのものだが、取引やその他の金融リクエストを完了するには顧客が追加情報を提供する必要があるとも付け加えた。

しかし、最も懸念されるのは、ElevenLabsのようなアプリが、ほとんど手間をかけずに非常に優れたコピーを作成していることです。ユーザーは責任規定に同意するだけで、音声ファイルをアップロードして独自のコピーを作成できます。

ウォール・ストリート・ジャーナルのテストを受けて、ElevenLabsは詐欺的または違法なコンテンツを作成していると思われるアカウントをブロックすると発表した。同社はまた、プラットフォーム上で作成された動画をAIで分類するツールの開発にも取り組んでいる。

一方、Synthesia では、音声ファイルや動画ファイルの使用にユーザーによる口頭での同意が必要となるため、スターンは同社とともにスタジオに出向き、ライブで撮影や録音を行わなければならなかった。

|

Synthesiaの使い方は簡単です。テキストを入力すると、その内容についてユーザーの声が流れる新しい動画が表示されます。写真: WSJ |

連邦捜査局(FBI)の広報担当者シボーン・ジョンソン氏によれば、米国の家庭は詐欺電話1件につき平均約1万1000ドルを失っているという。

2022年、米国連邦取引委員会(FTC)のデータによると、アメリカ人は詐欺電話により総額26億ドルの損失を被った。

安価で入手しやすい AI プログラムの開発により、詐欺師は自由に音声を複製し、元の音声とまったく同じ会話を作成できるようになりました。

「この脅威は単なる仮説ではありません。詐欺師がこれらのツールを武器として利用しているのを目撃しています。1分未満の音声で、比較的精巧な音声クローンを作成できます。人によっては、数秒でも十分な場合もあります」と、カリフォルニア大学バークレー校のコンピュータサイエンス教授、ハニー・ファリド氏は述べた。

[広告2]

ソースリンク

コメント (0)