ChatGPTの公開リンク経由でチャットを共有する機能 - 写真: Techradar

ChatGPT は現在、世界中のユーザーから毎日 25 億件を超えるクエリを受信しており、このチャットボットの人気の高まりを示しています。

しかし、このツールはユーザーから強い反発を受けています。「共有」機能のせいで何千もの会話から機密情報がGoogleやインターネット上の一部の検索エンジンに漏洩したからです。

高いセキュリティリスク

国家サイバーセキュリティ協会(NCA)の技術部門責任者であるVu Ngoc Son氏は、上記の事件はChatGPTユーザーにとって高いレベルのセキュリティリスクを示していると評価しました。

「上記のインシデントは、ユーザーがシェアボタンをクリックするという一定の主体性があるため、必ずしも技術的な欠陥とは言えません。しかし、AIチャットボット製品の設計に問題があり、ユーザーを混乱させ、シェアによる個人データ漏洩のリスクについて十分な警告措置が講じられていないと言えるでしょう」と、ヴー・ゴック・ソン氏は分析しました。

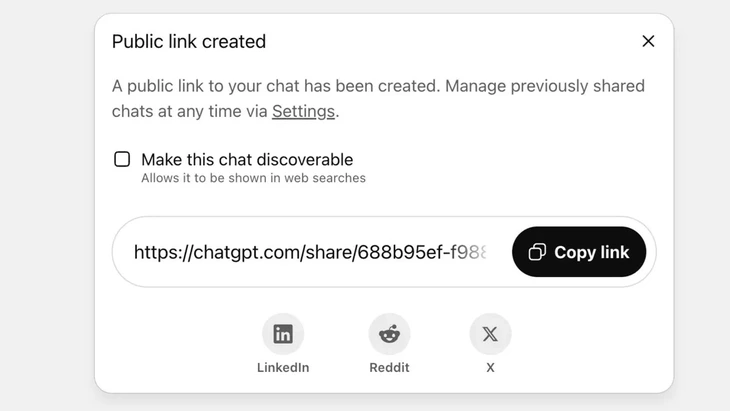

ChatGPT では、ユーザーがパブリック リンク経由でチャットを共有することを選択すればこの機能が実装され、コンテンツは OpenAI のサーバー上にパブリック Web サイト (chatgpt.com/share/...) として保存され、アクセスにログインやパスワードは必要ありません。

Google のクローラーはこれらのページを自動的にスキャンしてインデックス化し、機密性の高いテキスト、画像、チャット データなどを含むページを検索結果に表示します。

多くのユーザーは、チャットを友人や知り合いと共有していると思い込み、リスクに気づいていませんでした。その結果、数千件もの会話が流出し、中には個人情報を含むものもありました。

OpenAIはコミュニティからの反発を受け、2025年7月下旬にこの機能を迅速に削除しましたが、古いインデックスを削除するためにGoogleと調整するのに時間がかかりました。特にGoogleのキャッシュサーバーを含む複雑なストレージシステムでは、迅速に行うのは困難です。

AIチャットボットを「安全のブラックボックス」として扱わないでください

データセキュリティ専門家のヴー・ゴック・ソン氏 - 国家サイバーセキュリティ協会(NCA)の技術責任者 - 写真:CHI HIEU

何千ものチャットログの漏洩は、個人およびビジネス上の秘密の漏洩、評判の失墜、経済的リスク、さらには自宅住所の漏洩による安全上の危険など、ユーザーにリスクをもたらす可能性があります。

「AI 対応のチャットボットは便利ですが、『ブラックボックス』ではありません。共有データはチェックされずに放置されると、Web 上に永久に存在する可能性があります。

上記の事件は、提供者と利用者の両方にとって間違いなく教訓となるでしょう。他のAIサービス提供者は、この経験から学び、より明確で透明性のある警告機能を備えた設計をすべきです。

同時に、ユーザーはAIプラットフォーム上での識別情報や個人情報の無制限の投稿を積極的に制限する必要がある」とセキュリティ専門家のヴー・ゴック・ソン氏は勧告した。

データセキュリティの専門家によると、上記の事件はAIのための法的枠組みとサイバーセキュリティ基準の必要性を示しています。AIサプライヤーと開発者は、悪質な脆弱性による漏洩、ソフトウェアの脆弱性を起因とするデータベース攻撃、不適切な管理によるポイズニング、虚偽の質問や歪曲された質問への回答といったデータ漏洩のリスクを回避し、セキュリティを確保するシステムを設計する必要があります。

ユーザーは、AIとの個人情報の共有を制御する必要があり、機密情報を共有しないようにする必要があります。本当に必要な場合は、匿名モードを使用するか、情報を積極的に暗号化することで、データが特定の個人に直接結び付けられるのを防ぐことをお勧めします。

出典: https://tuoitre.vn/hang-ngan-cuoc-tro-chuyen-voi-chatgpt-bi-lo-tren-google-nguoi-dung-luu-y-gi-20250805152646255.htm

![[写真] 土砂崩れに見舞われた国道14E号線で、通行可能な道路を確保するために丘陵を切り開く](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/08/1762599969318_ndo_br_thiet-ke-chua-co-ten-2025-11-08t154639923-png.webp)

![[動画] フエのモニュメントが再開し、観光客を歓迎](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/11/05/1762301089171_dung01-05-43-09still013-jpg.webp)

コメント (0)