イーロン・マスク氏の政府効率化局(DOGE)は、コスト削減の意思決定を導くために AI を使用すると言われている。この戦術は、セキュリティ、偏見、エラーに関する懸念を引き起こします。

イーロン・マスク氏は、米国の財政赤字を少なくとも1兆ドル早急に削減することが目標だと述べた。

匿名の情報源を引用したメディア報道によると、DOGE省はコスト削減の意思決定を迅速化するためにAIを活用しているという。

かつてMetaの責任あるAI部門で働いていたAI専門家のDavid Evan Harris氏は、これを「ひどいアイデア」と呼んでいる。

専門家によると、このアプローチは、2年前にマスク氏がツイッターで採用した「まず削減し、後で修正する」という考え方を反映しており、数千人の雇用喪失、技術的不具合、訴訟、論争を引き起こし、ソーシャルネットワークを蝕んだ。

しかし、政府機関、システム、サービスを解体した場合の影響は、テクノロジー企業よりもはるかに深刻となるだろう。

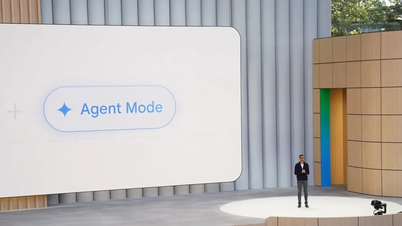

AIを活用してコスト削減の意思決定を導く

ワシントンポスト紙によると、 2月初旬、DOGEのメンバーは教育省の機密データをAIソフトウェアに入力し、同省のプログラムと支出を分析したという。

Wired は、DOGE の従業員が米国一般調達局 (GSA) 向けに、大量の契約および調達データの分析に役立つ GSAi と呼ばれる AI チャットボットを開発したと報じました。

NBCニュースの別の報道によると、DOGEは連邦政府職員の職務フィードバックをAIで分析し、不要になった職種を特定することを検討しているという。

2月にWiredは、DOGEが国防総省のAutoRIFソフトウェアを改造し、発砲目的で人員を自動的にランク付けしていたと報じた。

先週、米国デジタルサービス局(USDS)の職員21人が抗議して辞職した。彼らは、DOGEの職員が機密データを不適切に取り扱い、重要なシステムを混乱させたと非難した。

しかし、AP通信によると、ホワイトハウス報道官のキャロライン・リービット氏は、抗議活動や訴訟、法的措置でトランプ大統領を止められると考える人は「過去数年間、何も分かっていなかったに違いない」と主張した。

Xでは、マスク氏はこれらの人々をオフィスに戻ることを拒否する「保守派」とも呼んだ。

デジタルツールの開発や政府向けの技術的能力の構築を行う非営利団体 Code for America の CEO、アマンダ・レンテリア氏によると、問題の一部は、効果的な AI ツールを構築するにはトレーニングに使用するデータに対する深い理解が必要であり、DOGE チームにはそれがないことだという。

AI ツールが生成する結果は役に立たない可能性があり、またはテクノロジーに正しい決定を下すための情報とコンテキストが不足している可能性があります。 「幻覚」の問題があるかもしれません。

多くの報道機関によると、DOGEのスタッフはマスク氏の他の企業から来た20代の若い男性のグループだという。

DOGEのAI利用に関する懸念

専門家は、AIが人間によく見られる偏見を再現する可能性があると懸念している。たとえば、一部の AI 採用ツールは白人男性の候補者を他の候補者よりも優遇します。

AI がどのポジションやプロジェクトを削減するかを決定するために使用される場合、一部の重要な人物や仕事が、単に外見や所属する企業を理由に削減されることになります。

ハリス氏は、連邦政府職員からのフィードバックを評価するために AI を使用する例を分析しました。英語を母国語としない有能な職員は、AI によって英語話者より劣っていると判断される可能性があります。

こうした懸念は目新しいものではないが、政府内で間違った方向に進んだ場合、より深刻な結果を招く可能性がある。マスク氏自身も、DOGE が間違いを犯す可能性があることを認めており、エボラ予防などのいくつかの重要な取り組みから撤退した。

この意思決定に AI が関与したかどうかは不明です。

AIが業務効率の向上、大量の情報の統合・分析に役立つことは否定できません。しかし、慎重に使用しないと、政府の機密データや人々の個人情報が危険にさらされる可能性があります。

適切な保護と、システムにアクセスできるユーザーに対する制限がなければ、AI プログラムに入力されたデータが他のリクエストへの応答の中に予期せず表示され、知らないはずの人の手に渡ってしまう可能性があります。

ハリス氏は特にDOGEによる人事記録の取り扱いについて懸念しており、人事記録は「どの組織でも最も機密性の高い文書の一つ」であると述べた。

しかし、専門家によると、おそらく最も差し迫った懸念は、DOGE の AI の使用に関する透明性の欠如です。同省はどのようなツールを使用しているのか、どのように監視しているのか、人間が結果を確認し評価しているのか…といった疑問は依然として残る。

ニューヨーク大学コンピュータサイエンス准教授で、責任あるAIセンター所長のジュリア・ストヤノビッチ氏は、AIが効果を発揮するためには、ユーザーがその技術に対する目的を明確にし、AIシステムがそのニーズを満たしているかどうかを十分にテストする必要があると主張している。

「DOGEチームがパフォーマンスをどのように測定し、結果の正確性をどのように評価するのかを詳しく説明してくれるのが本当に楽しみです」と彼女は語った。

(CNNによると)

[広告2]

出典: https://vietnamnet.vn/hiem-hoa-khi-bo-doge-cua-elon-musk-ra-quyet-dinh-dua-tren-ai-2377729.html

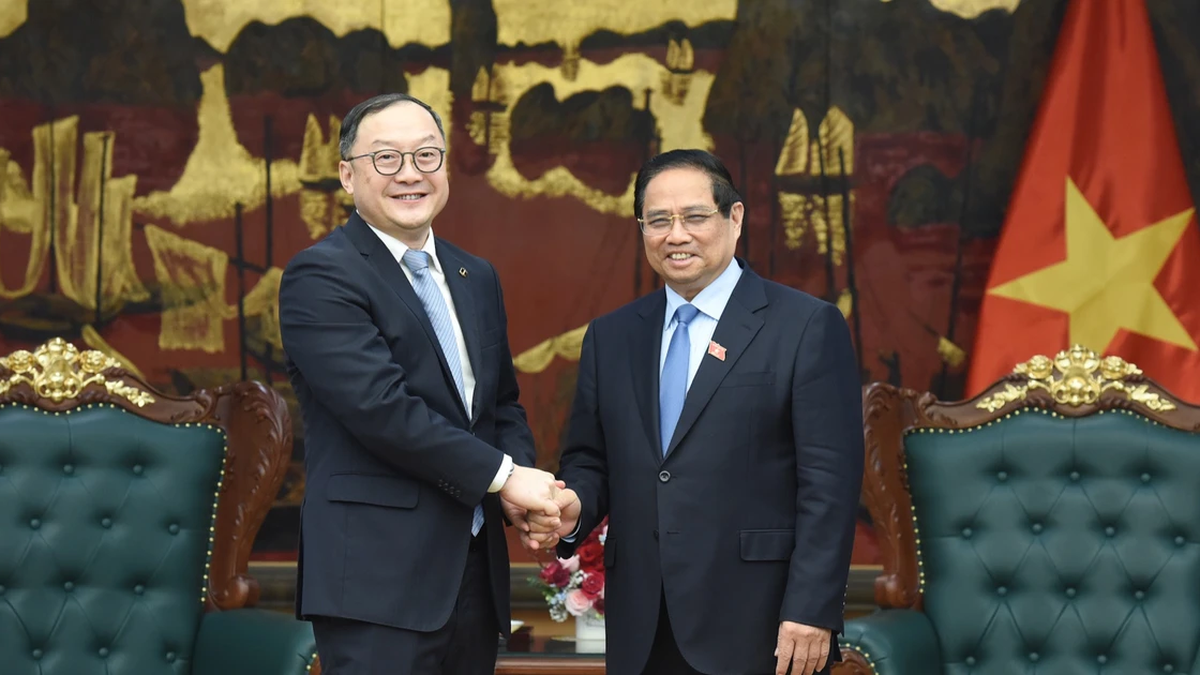

![[写真] ファム・ミン・チン首相がイスラエルの労働大臣ヨアブ・ベン・ツール師と会見](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/21/511bf6664512413ca5a275cbf3fb2f65)

![[写真]ソンラに来て、ウォールフラワーズと一緒に「自慢しよう」](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/21/627a654c41fc4e1a95f3e1c353d0426d)

![[写真] 科学ワークショップ「2025~2030年およびその後の期間にハイフォン市で社会主義人民と連携した社会主義モデルを構築する」](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/21/5098e06c813243b1bf5670f9dc20ad0a)

コメント (0)