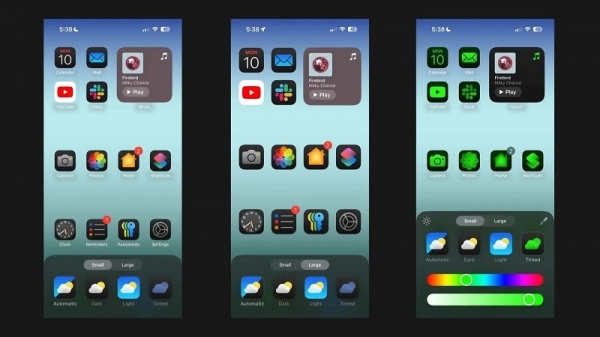

Android Authority 에 따르면, Apple의 연구 논문은 RAM이 제한된 기기에서 대용량 언어 모델(LLM)을 실행하는 솔루션을 자세히 설명합니다. 이 논문은 Apple이 전체 모델을 RAM에 로드하는 대신, "모델 매개변수"를 저장하고 필요에 따라 일부만 기기의 RAM에 로드하는 방법을 보여줍니다.

Apple은 RAM이 적은 구형 iPhone에서 일반 AI를 실행할 수 있도록 지원하려고 합니다.

이 논문에서는 이 방법을 사용하면 CPU와 GPU에서 각각 간단한 로딩 방법에 비해 4~5배와 20~25배의 추론 속도를 보장하면서도 iPhone이 가질 수 있는 RAM의 두 배에 해당하는 모델을 실행할 수 있다고 주장합니다.

RAM이 더 많은 기기에 합성 AI를 배포하면 읽기/쓰기 속도가 더 빨라져 큰 이점이 될 것입니다. 온디바이스 AI에서는 속도가 중요한데, 사용자가 응답이나 최종 결과를 얻기 위해 수십 초(또는 그 이상)를 기다릴 필요가 없기 때문에 추론 시간이 훨씬 빨라집니다. 이 모든 것은 온디바이스 AI 비서가 대화 속도로 실행되고, 이미지/텍스트를 훨씬 더 빠르게 생성하고, 기사를 더 빠르게 요약할 수 있음을 의미합니다. 하지만 Apple의 솔루션은 사용자가 온디바이스 AI 작업 응답 속도를 높이기 위해 반드시 많은 RAM이 필요하지 않다는 것을 의미합니다.

애플의 접근 방식은 구형과 신형 iPhone 모두에서 합성 AI 기능을 기기에서 바로 제공할 수 있도록 할 수 있습니다. 이는 애플 iPhone이 일반적으로 고급형 Android 휴대폰보다 RAM 용량이 적기 때문에 중요합니다. 예를 들어 iPhone 11 시리즈는 RAM 용량이 4GB에 불과한 반면, 일반 iPhone 15도 6GB에 불과합니다.

LLM 축소를 추진하는 모바일 기업은 애플뿐만이 아닙니다. 퀄컴과 미디어텍의 최신 플래그십 칩은 모두 INT4 정밀도를 지원하여 이러한 모델의 크기를 줄입니다. 어느 쪽이든 기업들은 온디바이스 AI의 시스템 요구 사항을 낮추고, 이를 통해 저가형 휴대폰에서도 이 기능을 제공할 수 있도록 새로운 방법을 모색하고 있습니다.

[광고_2]

소스 링크

![[사진] 라오스 국경일 50주년 기념 퍼레이드](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764691918289_ndo_br_0-jpg.webp&w=3840&q=75)

댓글 (0)