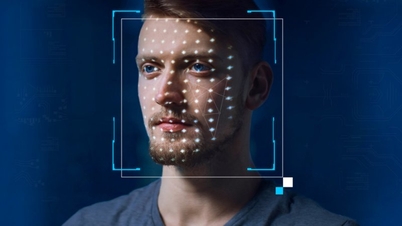

Sociaal netwerk X heeft zoekopdrachten naar Taylor Swift moeten blokkeren nadat deepfake pornografische afbeeldingen van de zangeres viraal gingen. Bij het zoeken naar Taylor Swift op het X-platform krijgen gebruikers een foutmelding en een verzoek om de pagina te herladen. Joe Benarroch – Director of Business Operations van X – zei dat dit een voorlopige maatregel is en dat deze voorzichtig wordt uitgevoerd.

Door AI gegenereerde pornografische afbeeldingen van Taylor Swift begonnen op 24 januari te circuleren op X, wat fans van de zangeres ertoe aanzette een reeks echte foto's van de ster te plaatsen om de deepfake te "verdrinken". Ze vroegen X ook om strengere maatregelen te nemen om deze foto's te verwijderen en accounts die nepfoto's delen te melden. De slogan "bescherm Taylor Swift" werd ook een toptrend op het platform.

Een dag later werden de gerapporteerde accounts opgeschort of beperkt, maar het was nog steeds gemakkelijk om AI-porno op X te vinden.

In een verklaring van afgelopen weekend stelde X dat het delen van expliciete afbeeldingen zonder toestemming van de betrokkene verboden is en een zerotolerancebeleid hanteert voor dergelijke content. Swift werd in de verklaring niet bij naam genoemd.

"Ons team verwijdert actief alle geïdentificeerde afbeeldingen en neemt passende maatregelen tegen de accounts die ze hebben geplaatst. We houden de situatie nauwlettend in de gaten om ervoor te zorgen dat verdere overtredingen onmiddellijk worden aangepakt en de content wordt verwijderd", aldus X.

Vooruitgang in generatieve AI heeft het gemakkelijker gemaakt om pornografische afbeeldingen van anderen te vervalsen. Nadat X in 2022 onder Elon Musks controle kwam, zijn veel censuurregels versoepeld en heeft hij duizenden werknemers ontslagen om zijn financiën te stabiliseren.

Volgens NBC News is het onduidelijk waar de deepfake-foto's van Taylor Swift vandaan komen, maar ze waren voorzien van een watermerk om aan te geven dat ze afkomstig waren van een website die bekendstaat om het verspreiden van neppornografische afbeeldingen van beroemdheden. De website heeft ook een sectie gewijd aan AI-deepfakes. De nepfoto's van Swift werden 19 uur na plaatsing meer dan 27 miljoen keer bekeken en meer dan 260.000 keer geliket.

Na het incident riep Microsoft-CEO Satya Nadella op tot strengere maatregelen om AI te reguleren. In een interview met NBC News betoogde hij dat we de verantwoordelijkheid hebben om deze opkomende technologie te monitoren, zodat er meer veilige content kan worden geproduceerd.

In antwoord op een vraag over Swifts deepfake zei de Microsoft-topman: "Ja, we moeten actie ondernemen. Ik denk dat we allemaal baat hebben bij een veilige online wereld . Ik denk niet dat iemand een online wereld wil die volledig onveilig is voor zowel makers als consumenten van content. Daarom denk ik dat we snel actie moeten ondernemen."

Volgens 404 Media meldde een chatgroep van Telegram dat het de door AI gegenereerde Designer-tool van Microsoft had gebruikt om Taylors foto te vervalsen. Nadella gaf geen direct commentaar op de informatie van 404 Media, maar in een verklaring aan de nieuwssite meldde Microsoft dat het de melding onderzocht en passende maatregelen zou nemen.

De regering van de Amerikaanse president Joe Biden noemde de verspreiding van de pornografische deepfake van Taylor Swift "alarmerend" en riep socialemediabedrijven op om hun "vitale rol" bij het handhaven van regelgeving ter voorkoming van de verspreiding van valse informatie en gevoelige afbeeldingen zonder toestemming te onderzoeken.

In oktober 2023 ondertekende president Biden een uitvoerend bevel over AI, gericht op het reguleren van opkomende technologieën en de risico's daarvan.

(Volgens The Hill, WSJ)

Bron

![[Foto] Premier Pham Minh Chinh ontmoet voorzitter van de Hongaarse Nationale Vergadering Kover Laszlo](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/20/1760970413415_dsc-8111-jpg.webp)

![[Foto] Premier Pham Minh Chinh ontving de heer Yamamoto Ichita, gouverneur van de provincie Gunma (Japan)](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/21/1761032833411_dsc-8867-jpg.webp)

![[Foto] Inwoners van Da Nang "zoeken naar foto's" van grote golven bij de monding van de Han-rivier](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/21/1761043632309_ndo_br_11-jpg.webp)

Reactie (0)