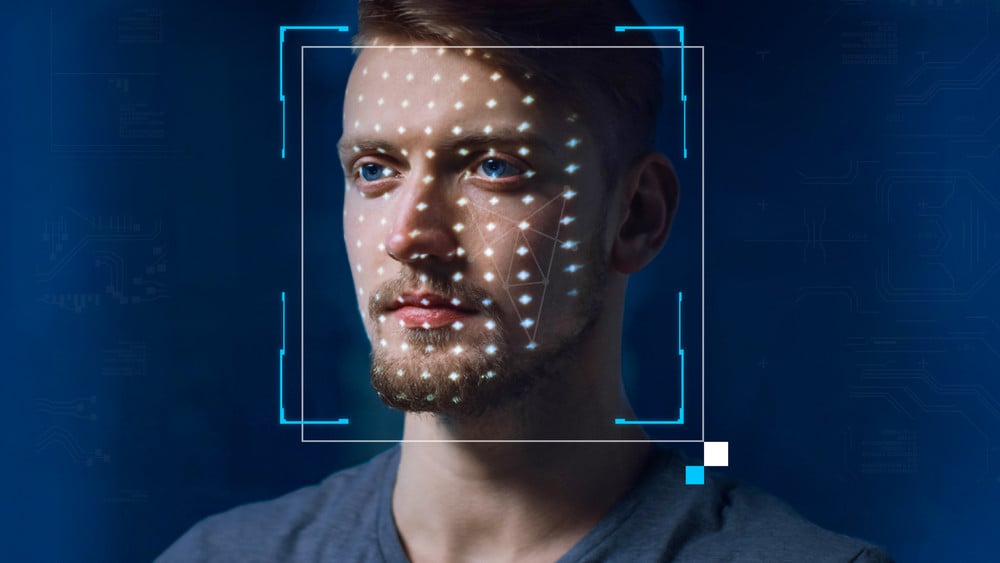

Przy początkowych kosztach wynoszących zaledwie ok. 1,3 mln VND, fałszywe narzędzia, takie jak przeszczepy twarzy i imitacje głosu, budzą ostrzeżenia o ryzyku oszustwa, fałszowaniu zdjęć osobistych i konsekwencjach dla cyberbezpieczeństwa.

(Ilustracja)

Niskie ceny w darknecie, ukryte wielkie niebezpieczeństwo

Globalny Zespół Badań i Analiz (GReAT) firmy Kaspersky opublikował właśnie wyniki badań, z których wynika, że na rynkach darknetu pojawiło się wiele reklam oferujących usługi tworzenia deepfake'ów w czasie rzeczywistym. Ceny wywoławcze fałszywych wiadomości głosowych wahają się od około 50 USD (około 1,3 miliona VND) do 30 USD (około 800 000 VND), w zależności od złożoności i długości treści.

Wcześniej „legalne” usługi deepfake kosztowały od 300 do 20 000 dolarów za minutę.

Gwałtowny spadek ceny – 400 razy niższej od poprzedniego popularnego poziomu – sprawia, że ryzyko stania się ofiarą nadużyć jest jeszcze wyższe.

Elementy reklamowe i „przynęta” dla złoczyńców

Reklamy wykraczają teraz poza proste, fałszywe filmy i obejmują zamianę twarzy w czasie rzeczywistym podczas rozmów wideo, podrabianie kamer urządzeń czy „podmienianie” twarzy w celu ominięcia uwierzytelniania. Reklamują również możliwość synchronizacji mimiki twarzy z narracją, a nawet obsługę wielu języków.

Ponadto sprzedawane są również usługi „klonowania głosu”, umożliwiające imitację głosu z możliwością dostosowania wysokości i tonu głosu w celu wyrażania różnych emocji. Wielu ekspertów podejrzewa jednak, że w rzeczywistości są to reklamy „wabiące klientów” – kupujący mogą zostać oszukani i wpłaceni z góry, ale nie otrzymają obiecanego produktu wysokiej jakości.

„Potrzeba korzystania z tego narzędzia również rośnie”

„Widzieliśmy nie tylko reklamy oferujące deepfake jako usługę, ale również zauważyliśmy wzrost popytu na te narzędzia” – powiedział Dmitrij Galow , szef zespołu GReAT w firmie Kaspersky (Rosja i WNP).

Cyberprzestępcy eksperymentują ze sztuczną inteligencją i włączają ją do swoich strategii ataków – dodał – a niektóre platformy opracowują nawet własne „złośliwe” modele LLM, niezależne od modeli publicznych i zdolne do uruchamiania bezpośrednio na urządzeniach cyberprzestępców.

Chociaż deepfake’ów nie można jeszcze uznać za zupełnie nowe zagrożenie cybernetyczne, technologia ta może sprawić, że ataki staną się bardziej wyrafinowane i trudniejsze do wykrycia.

Zalecenia i sposoby identyfikacji deepfake

Firma Kaspersky zaleca firmom i organizacjom wdrożenie kompleksowych środków cyberbezpieczeństwa, nie ograniczając się jedynie do instalacji oprogramowania zabezpieczającego, lecz również tworząc zespół ekspertów IT posiadających umiejętności wykrywania zagrożeń i reagowania na nie.

Ponadto pracownicy organizacji powinni zostać przeszkoleni w zakresie rozpoznawania nietypowych znaków w obrazie lub dźwięku, które mogą być efektem technologii deepfake. Takie filmy często charakteryzują się szarpanymi i nienaturalnymi ruchami, nierównomiernym oświetleniem lub odcieniami skóry między klatkami, postaciami pojawiającymi się z nietypową częstotliwością mrugania oczami lub prawie bez mrugania, a także twarzami, które mogą być zniekształcone lub lekko zdeformowane.

Dodatkowo, jakość obrazu jest często słaba, a klatki są niestabilne, zwłaszcza przy słabym oświetleniu, przez co cały film wygląda mniej realistycznie. Czujność wobec zagrożeń związanych z deepfake i podnoszenie świadomości na ten temat są postrzegane jako ważny pierwszy krok w kierunku minimalizacji szkód wyrządzanych przez wyrafinowane oszustwa w erze sztucznej inteligencji.

Source: https://doanhnghiepvn.vn/chuyen-doi-so/rui-ro-tu-deepfake-gia-re-tu-quang-cao-darknet-den-loi-keu-goi-canh-giac/20251016105304840

![[Zdjęcie] Parada z okazji 50. rocznicy Święta Narodowego Laosu](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764691918289_ndo_br_0-jpg.webp&w=3840&q=75)

![[Zdjęcie] Oddawanie czci posągowi Tuyet Son – prawie 400-letniemu skarbowi w pagodzie Keo](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764679323086_ndo_br_tempimageomw0hi-4884-jpg.webp&w=3840&q=75)

![[Wideo] Ochrona światowego dziedzictwa przed ekstremalnymi zmianami klimatycznymi](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/03/1764721929017_dung00-57-35-42982still012-jpg.webp)

Komentarz (0)