|

| Ilustração de um apelo para tratar a IA como uma arma biológica. (Fonte: gizmodo.com) |

No artigo " Trate a IA como uma arma biológica, não uma arma nuclear", de Emilia Javorsky, cientista , médica e diretora do Future of Life Institute (EUA), a autora argumenta que, apesar de o mundo ter comparado repetidamente a IA a bombas nucleares nos últimos tempos, existe uma abordagem mais adequada, que é regulamentar esse tipo de tecnologia como uma arma biológica ou biotecnologia.

Segundo o autor, a IA é talvez a tecnologia mais poderosa da história da humanidade que os humanos estão desenvolvendo atualmente. Os efeitos nocivos da IA, incluindo discriminação, ameaças à democracia e concentração de influência, já foram amplamente documentados.

No entanto, as principais empresas de IA estão numa corrida para construir sistemas de IA cada vez mais poderosos, aumentando os riscos a um ritmo sem precedentes na história da humanidade.

À medida que os líderes se esforçam para conter e controlar a ascensão da IA e seus riscos associados, precisam considerar as mesmas regras e padrões que a humanidade usou para criá-la no passado.

Adaptação e inovação podem coexistir, especialmente quando vidas humanas estão em risco.

Um alerta da tecnologia nuclear

Embora a energia nuclear seja mais de 600 vezes mais segura que o petróleo em termos de mortalidade e seja extremamente eficiente, poucos países a utilizam devido às consequências que testemunharam com a abordagem tradicional em relação à energia nuclear.

O mundo tomou conhecimento da tecnologia nuclear por meio da bomba atômica e da bomba de hidrogênio. Com essas armas, pela primeira vez na história, a humanidade desenvolveu uma tecnologia capaz de pôr fim à civilização humana, produto de uma corrida armamentista que priorizou a velocidade e a inovação em detrimento da segurança e do controle.

Falhas subsequentes na segurança técnica e na gestão de riscos, notoriamente responsáveis pelos desastres nucleares de Chernobyl e Fukushima, destruíram qualquer chance de as pessoas aceitarem os aspectos positivos da energia nuclear.

Apesar da avaliação geral favorável dos riscos da energia nuclear e de décadas de cientistas trabalhando para convencer o mundo de sua viabilidade, o próprio conceito de "nuclear" permanece... manchado.

Quando uma tecnologia causa danos em seus estágios iniciais, a conscientização social e a reação exagerada podem limitar permanentemente seus benefícios potenciais. Devido aos erros iniciais com a energia nuclear, a humanidade não conseguiu aproveitar sua fonte de energia limpa e segura, e a neutralidade de carbono e a estabilidade energética permanecem um sonho distante.

A abordagem correta para a biotecnologia

No entanto, em algumas áreas, as pessoas acertaram. A biotecnologia é um desses campos, incentivada a se desenvolver rapidamente em um contexto de muitos pacientes sofrendo e muitos morrendo todos os dias de doenças incuráveis.

O princípio desta pesquisa não é "agir rápido e quebrar coisas", mas sim inovar o mais rápido e seguro possível. Os seres humanos limitam o ritmo da inovação nesta área por meio de um sistema de regulamentações, ética e normas que protegem o bem-estar da sociedade e dos indivíduos, e impedem que a indústria seja paralisada por reações negativas que poderiam levar a um desastre.

Quando as armas biológicas foram proibidas na Convenção sobre Armas Biológicas durante a Guerra Fria, as superpotências rivais concordaram que a criação de tais armas não interessava a ninguém. Os líderes perceberam que essas tecnologias, difíceis de controlar, mas altamente acessíveis, não deveriam ser vistas como um mecanismo para vencer a corrida armamentista, mas sim como uma ameaça à própria humanidade.

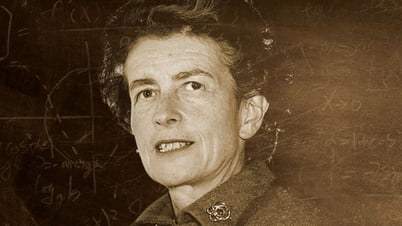

| Emilia Javorsky é uma das cientistas que recentemente assinaram uma carta aberta defendendo uma moratória de seis meses no desenvolvimento da IA. Ela também assinou uma declaração alertando que a IA representa um “risco de extinção” para a humanidade. |

A pausa na corrida armamentista permite que os humanos a desenvolvam em um ritmo responsável, com cientistas e órgãos reguladores aplicando padrões rigorosos a qualquer nova inovação que possa potencialmente prejudicar os seres humanos.

Essas adaptações não foram isentas de custos, mas também estabeleceram uma bioeconomia , com diversas aplicações em áreas que vão desde a energia limpa até a agricultura.

Durante a pandemia de Covid-19, biólogos aplicaram a tecnologia de mRNA para produzir vacinas eficazes a uma velocidade sem precedentes na história da humanidade.

Uma pesquisa recente com pesquisadores de IA revelou que 36% dos entrevistados acreditam que a IA pode causar um desastre de proporções nucleares. No entanto, as respostas e regulamentações governamentais têm sido lentas, o que não condiz com o ritmo de adoção da tecnologia, com o aplicativo ChatGPT já ultrapassando a marca de 100 milhões de usuários.

Os riscos crescentes da IA levaram 1.800 CEOs e 1.500 professores nos EUA a assinarem recentemente uma carta pedindo uma pausa de seis meses no desenvolvimento da IA e um processo urgente de regulamentação e mitigação de riscos. Essa pausa daria à comunidade global tempo para limitar os danos causados pela IA e evitar o risco de um desastre irreversível para a nossa sociedade.

Ao avaliarmos os riscos e os potenciais danos da IA, também devemos considerar como não perder de vista o potencial positivo dessa tecnologia. Se desenvolvermos a IA de forma responsável agora, poderemos colher benefícios incríveis dessa tecnologia. Por exemplo, os benefícios da aplicação da IA na descoberta e no desenvolvimento de medicamentos, na melhoria da qualidade e na redução do custo da assistência médica e no aumento do acesso a médicos e tratamentos.

A DeepMind do Google demonstrou que a IA tem o potencial de resolver problemas fundamentais da biologia que os humanos têm evitado por muito tempo. De acordo com o estudo, a IA poderia acelerar a conquista de todos os Objetivos de Desenvolvimento Sustentável das Nações Unidas, conduzindo a humanidade a um futuro com mais saúde, equidade, prosperidade e paz.

Chegou a hora de a comunidade global se unir, como fez há 50 anos na Convenção sobre Armas Biológicas, para garantir que o desenvolvimento da IA seja seguro e responsável. Se não agirmos logo, corremos o risco de destruir o futuro promissor da IA e a nossa própria sociedade atual.

Fonte

![[Foto] 60º aniversário da fundação da Associação Vietnamita de Artistas Fotográficos](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F05%2F1764935864512_a1-bnd-0841-9740-jpg.webp&w=3840&q=75)

![[Foto] O presidente da Assembleia Nacional, Tran Thanh Man, participa da cerimônia de premiação do VinFuture 2025.](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F05%2F1764951162416_2628509768338816493-6995-jpg.webp&w=3840&q=75)

Comentário (0)