Produkter av AI: Rasism och partiskhet

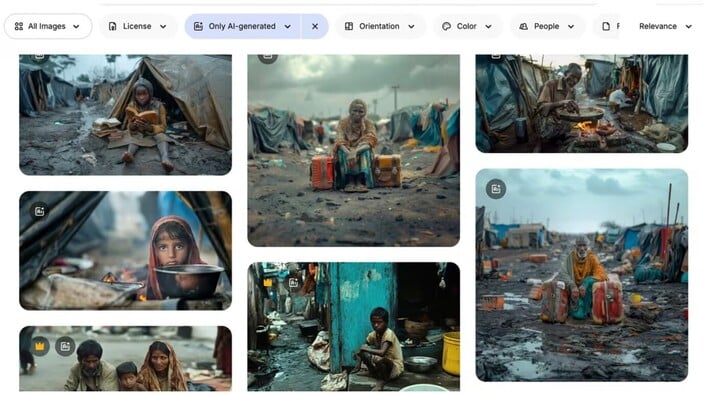

AI-genererade bilder av ämnen som fattigdom, barn och offer för sexuellt våld översvämmar online-fotoarkiv, och icke-statliga organisationer (NGO:er) använder dem i allt större utsträckning, enligt globala hälsoexperter . Experter varnar för att detta kan signalera en "ny era av fattigdomsutnyttjandekultur".

”Dessa bilder återspeglar den vanliga synen på fattigdom – barn som håller i tomma skålar, sprucken mark… väldigt stereotypa”, säger Arsenii Alenichev, forskare vid Institutet för tropisk medicin i Antwerpen som studerar produktionen av globala hälsobilder .

Herr Alenichev samlade in mer än 100 AI-genererade bilder av extrem fattigdom, vilka användes av individer eller icke-statliga organisationer i sociala mediekampanjer mot hunger och sexuellt våld.

Bilderna han delade med Guardian visar överdrivna, stereotypa scener: barn hopkurade i lerpölar; en afrikansk flicka i brudklänning med tårar som strömmar nerför kinderna. I en kommentar som nyligen publicerades i tidskriften Lancet Global Health menade han att bilderna var "fattigdomsporr version 2.0".

Skärmdump som visar en AI-genererad bild av "fattigdom" på en fotosajt. (Foto: Freepik)

Herr Alenichev och många andra experter säger att användningen av AI-bilder ökar på grund av oro kring upphovsrätt och kostnader. Den amerikanska regeringens budgetnedskärningar till icke-statliga organisationer har förvärrat problemet.

"Det är uppenbart att många organisationer börjar överväga att använda AI-bilder istället för riktiga foton eftersom det är billigt. Man behöver inte heller oroa sig för upphovsrätt och många andra saker", sa han.

Ligger ansvaret hos användaren eller plattformen?

AI-genererade bilder av fattigdom dyker upp på dussintals fotosajter, inklusive Adobe Stock Photos och Freepik. Många har bildtexter som: ”surrealistiskt barn i flyktingläger”; ”asiatiska barn som simmar i en flod fylld med skräp”; ”vit volontär som ger medicinska råd till svarta barn i en afrikansk by”; och mer. Adobe säljer rättigheterna till de två sista bilderna på den listan för cirka 60 pund.

"De här fotona är uppenbart rasistiska och borde inte tillåtas publiceras eftersom de är de värsta stereotyperna om Afrika, Indien eller vad som helst man kan tänka sig", sa Alenichev.

Joaquín Abela, VD för Freepik, sa att ansvaret för att använda sådana extrema bilder ligger hos användarna, inte hos plattformar som hans. Enligt hans uppfattning skapas AI-stockbilder av en global community av användare, som kan få royalties när Freepik-kunder väljer att köpa deras foton.

Freepik har försökt att begränsa de fördomar som finns i deras fotobibliotek genom att "injicera mångfald". Samtidigt försöker de också säkerställa könsbalans i foton av advokater och chefer.

Men, säger han, hans plattform kan bara göra så mycket. ”Det är som att försöka torka ut havet. Vi har försökt, men verkligheten är den att om kunder över hela världen vill att deras bilder ska se ut på ett visst sätt, finns det absolut ingenting någon kan göra åt det.”

AI-genererad bild från välgörenhetsorganisationen Plan Internationals kampanj mot barnäktenskap från 2023, som syftar till att skydda "flickors integritet och värdighet". (Foto: Plan International)

Många prestigefyllda organisationer har använt AI-genererade bilder, till och med FN.

Förra året publicerade FN en video på YouTube med "återuppföranden" av sexuellt våld, inklusive vittnesmålet från en burundisk kvinna som beskriver hur hon våldtogs och lämnades att dö av tre män 1993. Innehållet genererades helt av AI. Videon togs bort efter att Guardian kontaktat FN för en intervju.

En talesperson för FN förklarade senare varför videon togs bort. ”Vi tror att videon genererades felaktigt av AI och kan utgöra risker för informationsintegriteten, genom att blanda verkliga bilder med artificiellt innehåll som verkar vara verkligt.”

AI-genererade produkter har länge visat sig vara kopior och överdriver ibland sanningen. Alenichev sa att spridningen av dessa partiska bilder kan förvärra problemet, eftersom bilderna kan spridas över det stora internet och användas för att träna nästa generations AI.

En talesperson för Plan International sa att NGO:n för närvarande ”avråder från att använda AI för att avbilda barn”.

Minh Hoan

Källa: https://vtcnews.vn/chuyen-gia-bao-dong-tinh-trang-ai-tao-anh-rap-khuon-phong-dai-ar972160.html

![[Foto] Nationalförsamlingens ordförande Tran Thanh Man deltar i VinFuture 2025-prisutdelningen](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F05%2F1764951162416_2628509768338816493-6995-jpg.webp&w=3840&q=75)

Kommentar (0)