Нещодавні інциденти, пов'язані з упередженістю та фальсифікацією документів, змусили вчених переглянути питання про належний рівень участі штучного інтелекту в дослідженнях.

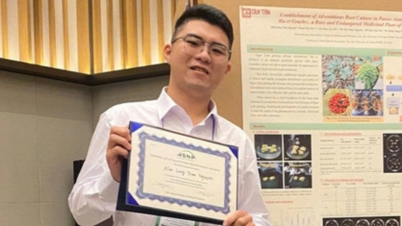

Нещодавно на своїй особистій сторінці професор, доктор лінгвістики Нгуєн Ван Хіеп поділився історією, яка шокувала читачів. Він виявив, що ШІ підробив його документи, використовуючи інформацію, надіслану другом. Він також випадково виявив, що статтю доцента, доктора наук Тран Ван Ко також підробив ШІ.

Штучний інтелект став невід'ємною частиною людського життя, проте експерти завжди наголошують, що ми повинні розглядати ШІ лише як допоміжний інструмент. Користувачі ШІ завжди повинні бути уважними та обізнаними, щоб обробляти дані та оцінювати результати, отримані після «співпраці» зі ШІ. Особливо в наукових дослідженнях багато досліджень показали, що найбільшою проблемою, на яку потрібно звернути увагу, є упередженість у даних і моделях. ШІ може бути упередженим, спотворювати результати аналізу, створювати упередження або дискримінацію та маніпулювати інформацією, якщо його належним чином не контролювати.

Зокрема, використання ШІ в дослідженнях у сфері соціальних наук вимагає набагато більшої обережності. Оскільки такі галузі соціальних наук, як філософія, лінгвістика, етнологія, історія тощо, розглядають людську поведінку, культуру та поведінку як об'єкти дослідження, дані часто тісно пов'язані з в'єтнамським соціально-культурним контекстом, з глибиною та специфічністю. Якщо дані навчання ШІ відображають історичні упередження, небезпека полягає в тому, що ШІ може робити висновки, які загострюють проблеми нерівності між статтю, класом, расою чи географічним регіоном. Ризик ще більший, коли ШІ використовується для аналізу людської поведінки, відповідей на відкриті опитування або участі в медіаконтенті.

За словами деяких експертів із соціальних наук, штучний інтелект наразі має труднощі з доступом до джерел даних, захищених авторським правом, або платних, що призводить до неповного оновлення інформації.

Явище фальсифікації документів для створення правдоподібних історій часто зустрічається в менш популярних темах, мовами з обмеженими джерелами даних, такими як в'єтнамська, і про це слід попереджати користувачів. Системи штучного інтелекту загалом наразі дуже обмежені в розумінні соціального та культурного контексту, тому їхня допомога в інтерпретації неоднозначних, насичених метафорами знань із соціальних наук не є насправді надійною.

Хоча ШІ має великий потенціал у наукових дослідженнях, його застосування має бути дуже обережним, воно має свої межі та завжди повинно йти пліч-о-пліч зі здатністю дослідника до критичного мислення.

Можна побачити, що, хоча ШІ має великий потенціал у наукових дослідженнях, його застосування має бути дуже обережним, обмеженим та завжди супроводжуватися критичним підходом дослідника. Суб'єкт, який використовує ШІ, повинен чітко визначити ці обмеження у використанні ШІ, гарантуючи, що ШІ не змінює основних цінностей науки. Для захисту цілісності наукових досліджень роль та відповідальність вчених мають бути підняті на новий рівень. Крім того, необхідно запропонувати юридично обов'язкові етичні рамки ШІ в контексті в'єтнамської культури, традицій та соціальних норм.

Міністерство науки і технологій запропонувало систему з дев'яти принципів для сприяння дослідженням та розробкам безпечних та відповідальних систем штучного інтелекту, обмеження негативного впливу та контролю ризиків, яка наголошує на безпеці даних, а також повазі до прав та гідності людини, а також на підзвітності користувачів ШІ. Зокрема, у сфері наукових досліджень Державна рада професорів також видала офіційне розпорядження № 25/HDGSNN у 2023 році, в якому вимагає від галузевих рад з питань звання професорів та установ з оцінки якості наукових робіт приділяти особливу увагу виявленню та оцінці робіт, які використовують або отримують за допомогою технології ШІ. Ці вимоги спрямовані на те, щоб результати досліджень з використанням ШІ все ще відповідали науковим стандартам, запобігаючи зловживанню ШІ в наукових дослідженнях та публікаціях.

Найближчим часом, коли буде видано Закон про штучний інтелект із суворими правилами, що стосуються етики та відповідальності використання ШІ, це сприятиме створенню здорового середовища для розвитку ШІ, забезпечуючи більш активну та відповідальну підтримку вчених у дослідницькій роботі.

Джерело: https://nhandan.vn/canh-giac-voi-mat-trai-cua-ai-post916545.html

![[Фото] Урочисте відкриття 10-ї сесії 15-ї Національної асамблеї](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/20/1760937111622_ndo_br_1-202-jpg.webp)

![[Фото] Керівний комітет Осіннього ярмарку 2025 року перевіряє хід організації](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/20/1760918203241_nam-5371-jpg.webp)

![[Відео] Квітковий та подарунковий ринок у Хошиміні вирує з нагоди 20 жовтня](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/10/20/1760931107653_720-jpg.webp)

![[Відео] Керівники партії та штату, а також депутати Національних зборів відвідали мавзолей президента Хо Ши Міна](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/10/20/1760929911350_img-1885-4872-png.webp)

Коментар (0)