|

DeepSeek a publié un nouveau modèle d'IA capable de traiter des documents avec 7 à 20 fois moins de jetons que les méthodes traditionnelles. Photo : The Verge . |

Selon le SCMP , DeepSeek a publié un nouveau modèle d'intelligence artificielle (IA) multimodal capable de traiter des documents volumineux et complexes avec un nombre de jetons considérablement réduit (7 à 20 fois moins) que les méthodes de traitement de texte traditionnelles.

Les tokens sont les plus petites unités de texte traitées par l'IA. Réduire leur nombre permet de diminuer les coûts de calcul et d'améliorer l'efficacité du modèle d'IA.

Pour ce faire, le modèle DeepSeek-OCR (reconnaissance optique de caractères) utilise la perception visuelle comme moyen de compression de l'information. Cette approche permet aux grands modèles de langage de traiter d'énormes volumes de texte sans augmentation proportionnelle des coûts de calcul.

« Grâce à DeepSeek-OCR, nous avons démontré que l'utilisation de la perception visuelle pour compresser les informations peut permettre des réductions significatives du nombre de jetons — de 7 à 20 fois pour différentes étapes contextuelles historiques — offrant ainsi une voie prometteuse », a déclaré DeepSeek.

Selon l'article de blog de l'entreprise, DeepSeek-OCR se compose de deux éléments principaux : DeepEncoder et DeepSeek3B-MoE-A570M, qui fait office de décodeur.

Dans ce modèle, DeepEncoder joue le rôle d'outil central, contribuant à maintenir de faibles niveaux d'activation sous une entrée haute résolution tout en atteignant des taux de compression élevés pour réduire le nombre de jetons.

Le décodeur est ensuite un modèle de type « mélange d'experts » (MoE) comportant 570 millions de paramètres, chargé de reconstruire le texte original. L'architecture MoE divise le modèle en sous-réseaux spécialisés dans le traitement d'une partie des données d'entrée, optimisant ainsi les performances sans activer l'intégralité du modèle.

Sur OmniDocBench, un banc d'essai pour la lisibilité des documents, DeepSeek-OCR surpasse les principaux modèles OCR comme GOT-OCR 2.0 et MinerU 2.0, tout en utilisant beaucoup moins de jetons.

Source : https://znews.vn/deepseek-lai-co-dot-pha-post1595902.html

![[Photo] Cérémonie de clôture de la 10e session de la 15e Assemblée nationale](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F11%2F1765448959967_image-1437-jpg.webp&w=3840&q=75)

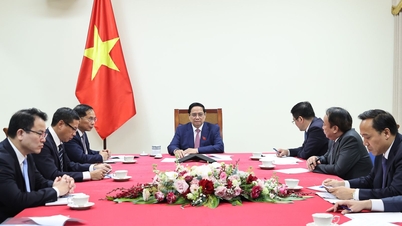

![[Photo] Le Premier ministre Pham Minh Chinh s'entretient par téléphone avec le PDG de la société russe Rosatom.](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F11%2F1765464552365_dsc-5295-jpg.webp&w=3840&q=75)

![[OFFICIEL] LE GROUPE MISA ANNONCE SON POSITIONNEMENT DE MARQUE PIONNIER DANS LA CONSTRUCTION D'IA AGENTE POUR LES ENTREPRISES, LES MÉNAGES ET LE GOUVERNEMENT](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/11/1765444754256_agentic-ai_postfb-scaled.png)

Comment (0)