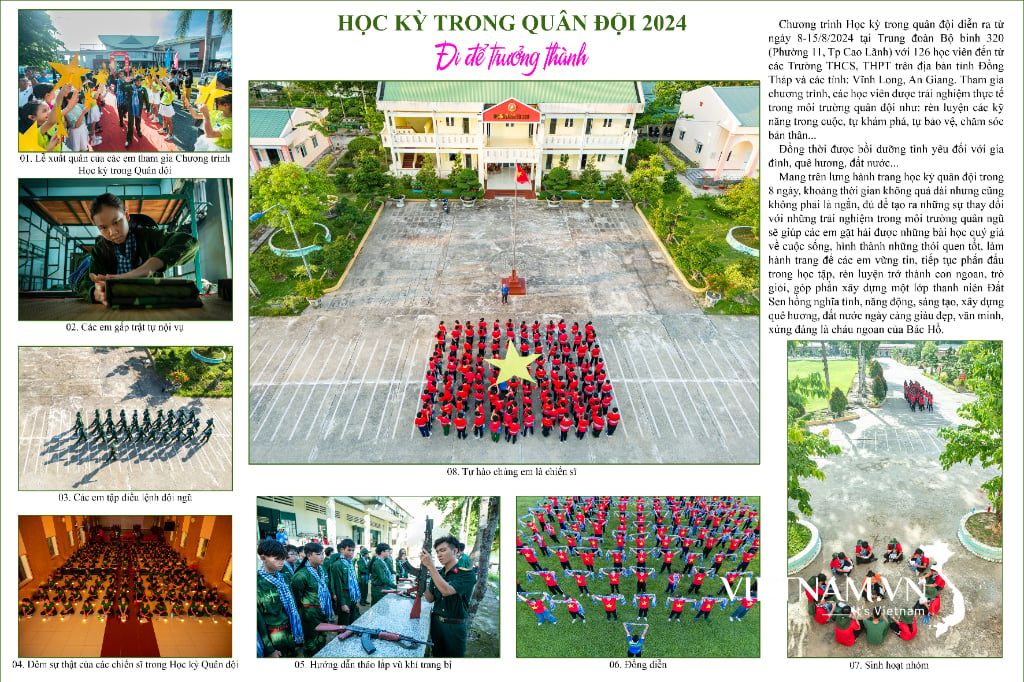

En mai, le PDG Altman a déposé une pétition auprès du Sénat américain à Washington, DC, avec un appel urgent aux législateurs : en plus de profiter de la supériorité de l'IA, nous devons également créer prochainement des réglementations strictes pour minimiser le risque qu'elle domine l'humanité.

Interface ChatGPT sur le site Web. Photo : Shutterstock

« Des risques profonds pour la société et l’humanité »

Avec le lancement de ChatGPT d'OpenAI à la fin de l'année dernière, Altman, 38 ans, est devenu du jour au lendemain le créateur d'une nouvelle génération d'outils d'IA capables de générer des images et du texte à la demande des utilisateurs, une technologie connue sous le nom d'IA générative.

Peu de temps après sa sortie, ChatGPT est devenu un nom familier. Des cadres l'ont utilisé pour rédiger des e-mails, des gens ont créé des sites Web sans aucune expérience préalable en codage et il a réussi des examens dans des écoles de droit et de commerce. Il a le potentiel de révolutionner presque tous les secteurs, y compris l’éducation, la finance, l’agriculture , les médias, le journalisme et la santé, de la chirurgie au développement de vaccins médicaux.

Mais ces mêmes outils ont suscité des inquiétudes sur tous les plans, de la tricherie à l’école aux pertes d’emplois, voire des menaces pour l’existence même de l’humanité.

L’essor de l’IA, par exemple, pousse les économistes à mettre en garde contre le marché du travail. Selon les estimations de Goldman Sachs, jusqu’à 300 millions d’emplois à temps plein dans le monde pourraient éventuellement être automatisés d’une manière ou d’une autre grâce à l’IA. Selon un rapport publié en avril par le Forum économique mondial, quelque 14 millions d’emplois pourraient disparaître au cours des cinq prochaines années.

De plus, lors d’un témoignage devant le Congrès américain, Altman a déclaré que le potentiel de l’IA à être utilisée pour manipuler les électeurs et cibler la désinformation est l’un des « domaines qui me préoccupent le plus ».

Deux semaines après l'audience, Altman s'est joint à des centaines de scientifiques, de chercheurs et de chefs d'entreprise de premier plan en matière d'IA pour signer une lettre déclarant : « Minimiser le risque d'extinction de l'IA doit être une priorité mondiale, aux côtés d'autres risques à l'échelle sociétale tels que les pandémies et la guerre nucléaire. »

L’avertissement a été largement relayé dans la presse et les médias. Et un nombre croissant de personnes affirment que de tels scénarios apocalyptiques doivent être pris plus au sérieux.

Mais il existe un grand paradoxe dans la Silicon Valley : les PDG de certaines des plus grandes entreprises technologiques disent au public que l’IA a le potentiel de provoquer l’extinction de l’humanité, et pourtant ils se précipitent pour investir dans cette technologie et la déployer auprès de milliards d’utilisateurs.

Altman s’est depuis longtemps montré préoccupé par les risques posés par l’IA et s’est engagé à avancer de manière responsable. Il fait partie d'un groupe de PDG du secteur technologique qui rencontrent les dirigeants de la Maison Blanche, dont le président Joe Biden et la vice-présidente Kamala Harris, pour souligner l'importance de développer une IA éthique et responsable.

Mais cela ne suffit pas. D’autres souhaitent qu’Altman et OpenAI agissent avec plus de prudence. Même Elon Musk, qui a contribué à fonder OpenAI avant de quitter le groupe, et des dizaines de dirigeants, professeurs et chercheurs du secteur technologique ont appelé les laboratoires d'intelligence artificielle comme OpenAI à cesser de former leurs systèmes d'IA les plus puissants pendant au moins six mois, invoquant des « risques profonds pour la société et l'humanité ».

Altman a déclaré qu'il était d'accord avec certaines parties de la lettre, notamment que « les niveaux de sécurité doivent être augmentés », mais a déclaré qu'une pause ne serait pas la « manière optimale » de relever les défis.

OpenAI a toujours le pied sur la pédale d’accélérateur. Plus récemment, OpenAI et le concepteur d'iPhone Jony Ive auraient été en pourparlers pour lever 1 milliard de dollars auprès du conglomérat japonais SoftBank pour un appareil d'IA destiné à remplacer les smartphones.

Peut-on faire confiance à Sam ?

Lorsqu'il a lancé OpenAI, Altman a déclaré à CNN en 2015 qu'il souhaitait façonner le chemin de l'IA, plutôt que de s'inquiéter des dommages potentiels et de ne rien faire. « Je dors mieux en sachant que je peux désormais avoir une certaine influence », a-t-il déclaré.

Altman a néanmoins déclaré qu’il avait des inquiétudes concernant cette technologie. « Je suis prêt à survivre », a-t-il déclaré dans un article du New Yorker de 2016, soulignant un certain nombre de scénarios catastrophiques possibles, notamment « une attaque de l’IA contre nous ».

Le PDG d'OpenAI, Sam Altman, s'exprime devant le Sénat américain le 16 mai à Washington, États-Unis. Photo : AP

« Mais j’ai des armes, de l’or, des antibiotiques, des piles, de l’eau, des masques à gaz… et un immense terrain à Big Sur où je peux voler », a-t-il déclaré, laissant entendre qu’il pourrait personnellement survivre si une catastrophe survenait. C’est clairement une déclaration égoïste.

Dans ce qui est peut-être l’effort le plus vaste à ce jour, le président Biden a annoncé plus tôt cette semaine un décret exigeant que les développeurs de puissants systèmes d’IA partagent les résultats de leurs tests de sécurité avec les autorités fédérales avant de les rendre publics, afin de déterminer s’ils présentent un risque pour la sécurité nationale, l’économie ou la santé.

À la suite de l'audition au Sénat américain, Emily Bender, professeure à l'Université de Washington et directrice du Laboratoire de linguistique computationnelle, a exprimé des inquiétudes quant à l'avenir de l'IA, même si elle est étroitement réglementée. « S’ils croient sincèrement que cela pourrait conduire à l’extinction de l’humanité, pourquoi ne pas arrêter ? » elle a déclaré.

Une bonne élaboration de politiques doit être éclairée par de nombreux points de vue et intérêts, et non pas seulement par un ou quelques-uns, et façonnée par l'intérêt public, a déclaré Margaret O'Mara, historienne des technologies et professeure à l'Université de Washington. « Le défi avec l’IA est que très peu de personnes et d’entreprises comprennent vraiment comment elle fonctionne et ce que cela signifie de l’utiliser, comme la bombe atomique », explique O’Mara.

Il serait donc risqué pour le monde de compter sur Altman pour agir dans le meilleur intérêt de l’humanité avec une technologie dont il admet lui-même qu’elle pourrait être une arme de destruction massive et qu’il a préparé un abri en cas de catastrophe. De plus, il n’est qu’un être humain après tout, pas un super-héros ou un sauveur !

Hoang Hai (selon CNN, FT, Reuters)

Source

![[Photo] Les journalistes émus aux larmes lors de la cérémonie commémorative pour les soldats morts à Gac Ma](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/30/9454613a55c54c16bf8c0efa51883456)

![[Photo] Conférence nationale « 100 ans de presse révolutionnaire vietnamienne accompagnant la cause glorieuse du Parti et de la nation »](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/30/1cf6cd5c8a934ebfa347028dcb08358c)

![[Photo] Le secrétaire général To Lam reçoit le chef du bureau central du Parti révolutionnaire populaire lao](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/30/140435f4b39d4599a3d17975dfb444c5)

![[Photo] Une délégation de 100 journalistes de l'Association des journalistes du Vietnam rend visite aux soldats et aux habitants du district de l'île de Truong Sa.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/30/0984a986227d4e988177f560d2e1563e)

Comment (0)