Selon une nouvelle étude publiée par l’Organisation des Nations Unies pour l’éducation , la science et la culture (UNESCO) le 7 mars, de nombreux outils d’intelligence artificielle (IA) parmi les plus populaires au monde sont alimentés par des programmes biaisés contre les femmes, développés par les sociétés OpenAI et Meta.

Les plus grandes entreprises de l'IA exploitent d'énormes quantités de données issues d'Internet pour alimenter leurs algorithmes, appelés grands modèles linguistiques (MLL). L'UNESCO a testé l'algorithme Llama 2 de Meta ainsi que les algorithmes GPT-2 et GPT-3.5 d'OpenAI, utilisés dans la célèbre application de chat ChatGPT. Les tests ont révélé que chacun d'eux présentait des signes évidents de discrimination à l'égard des femmes.

Les résultats ont montré que les textes liés aux noms féminins générés par ces outils contenaient souvent des mots tels que « maison », « famille » ou « enfants », tandis que les textes liés aux noms masculins contenaient souvent des mots tels que « entreprise », « salaire » ou « carrière » ; les hommes étaient souvent décrits avec des métiers tels qu’enseignants, avocats, médecins ; tandis que les femmes étaient souvent associées à des métiers tels que la cuisine, les tâches ménagères, etc.

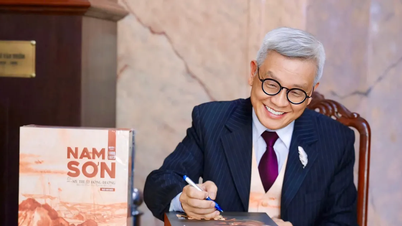

DO CAO

Source

![[Photo] Le journal Nhan Dan présente et sollicite des commentaires sur les projets de documents du 14e Congrès national du Parti](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/26/1761470328996_ndo_br_bao-long-171-8916-jpg.webp)

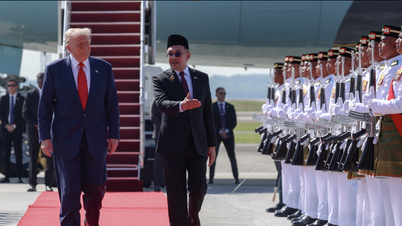

![[Photo] Le Premier ministre Pham Minh Chinh assiste à l'ouverture du 47e sommet de l'ASEAN](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/26/1761452925332_c2a-jpg.webp)

![[Photo] Profitez du festival des feux d'artifice de Liuyang dans le Hunan, en Chine](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/26/1761463428882_ndo_br_02-1-my-1-jpg.webp)

![[Photo] Le secrétaire général To Lam a reçu la délégation participant à la conférence internationale sur les études vietnamiennes](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/26/1761456527874_a1-bnd-5260-7947-jpg.webp)

Comment (0)