|

Az OpenAI chatbotja folyamatosan fejlődik az új technológiáknak köszönhetően. Fotó: New York Times . |

2024 szeptemberében az OpenAI elindította a ChatGPT-t, a mesterséges intelligencia egy olyan verzióját, amely integrálja az o1 modellt, és képes logikusan gondolkodni a matematikával, a természettudományokkal és a számítógépes programozással kapcsolatos feladatokban.

A ChatGPT korábbi verziójával ellentétben az új technológia időt vesz igénybe, hogy „átgondolja” a komplex problémák megoldásait, mielőtt választ adna.

Az OpenAI-t követően számos versenytárs, mint például a Google, az Anthropic és a DeepSeek is hasonló érvelési modelleket vezetett be. Bár nem tökéletes, ez még mindig egy chatbot-fejlesztési technológia, amelyben sok fejlesztő megbízik.

Hogyan érvel a mesterséges intelligencia?

Lényegében az érvelés azt jelenti, hogy a chatbotok több időt tölthetnek a felhasználók által felvetett problémák megoldásával.

„Az érvelés az, ahogyan a rendszer további munkát végez egy kérdés fogadása után” – mondta Dan Klein, a Kaliforniai Egyetem számítástechnikai professzora a New York Timesnak .

Egy logikus rendszer képes egy problémát kisebb, egyedi lépésekre bontani, vagy próbálgatással megoldani.

Indulásakor a ChatGPT azonnal tudott válaszolni a kérdésekre az információk kinyerésével és szintetizálásával. Ezzel szemben az érvelő rendszereknek néhány másodperccel (vagy akár percekkel) több időre volt szükségük a probléma megoldásához és a válaszadáshoz.

|

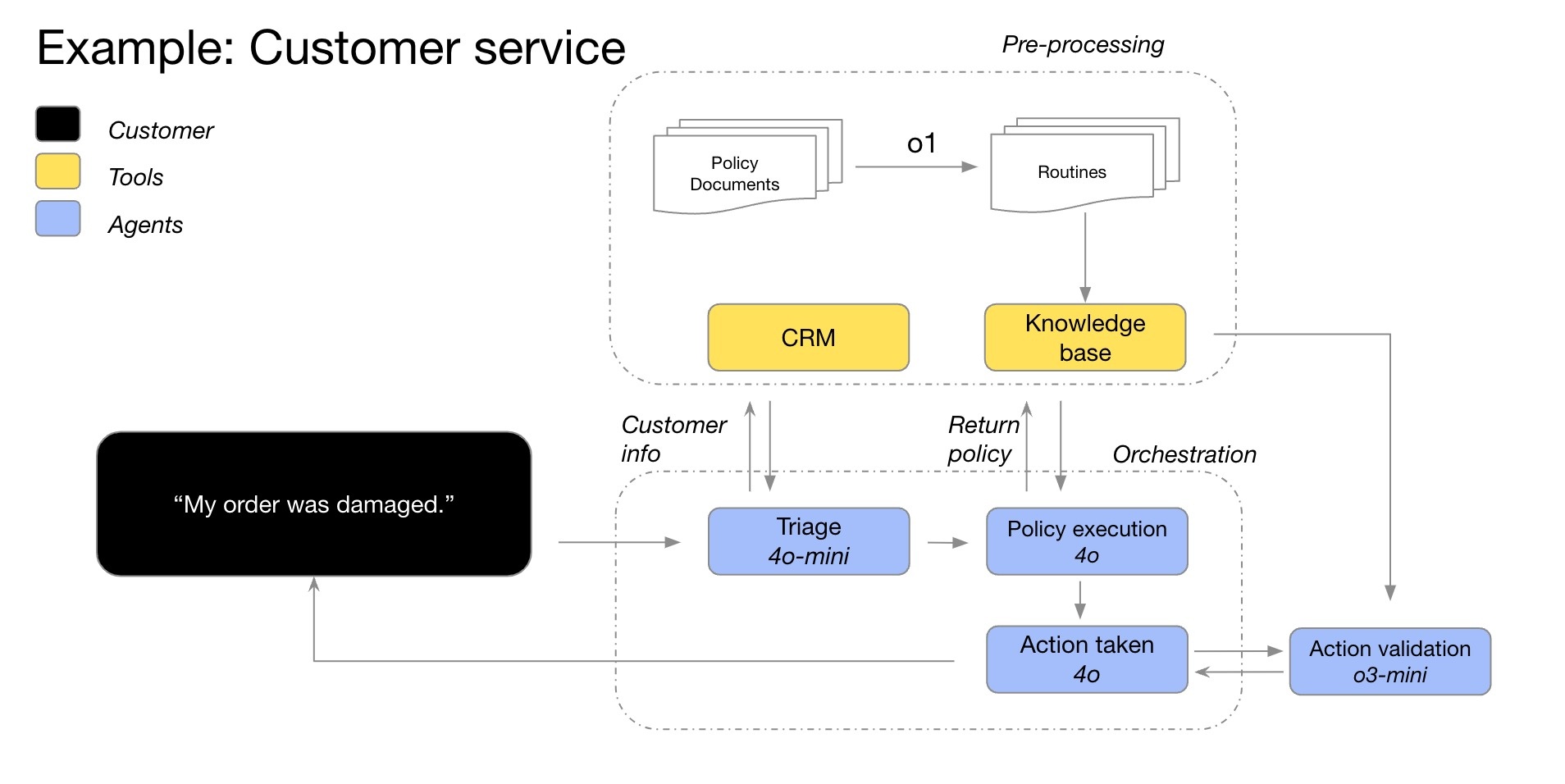

Példa az O1 modell érvelési folyamatára egy ügyfélszolgálati chatbotban. Kép: OpenAI . |

Bizonyos esetekben az érvelő rendszer megváltoztatja a probléma megközelítését, folyamatosan fejlesztve a megoldást. Ezenkívül a modell több megoldást is tesztelhet az optimális választás előtt, vagy ellenőrizheti a korábbi válaszok pontosságát.

Általánosságban elmondható, hogy az érvelőrendszer az összes lehetséges választ figyelembe veszi a kérdésre. Ez hasonló ahhoz, mint amikor az általános iskolás diákok sok lehetőséget írnak le papírra, mielőtt kiválasztják egy matematikai feladat legmegfelelőbb megoldását.

A New York Times szerint a mesterséges intelligencia ma már szinte bármilyen témában képes érvelni. Leghatékonyabb azonban a matematikával, a természettudományokkal és a számítógépes programozással kapcsolatos kérdésekben lesz.

Hogyan történik az elméleti rendszer betanítása?

Egy tipikus chatboton a felhasználók továbbra is kérhetnek magyarázatot a folyamattal kapcsolatban, vagy ellenőrizhetik a válasz pontosságát. Valójában sok ChatGPT betanítási adatkészlet már tartalmaz problémamegoldó eljárásokat.

Az érvelő rendszer még fejlettebbé válik, ha felhasználói beavatkozás nélkül is képes műveleteket végrehajtani. Ez a folyamat összetettebb és kiterjedtebb. A vállalatok azért használják az „érvelés” szót, mert a rendszer hasonlóan működik, mint az emberek.

Sok vállalat, mint például az OpenAI, arra számít, hogy az érvelő rendszerek jelentik a legjobb megoldást a jelenleg elérhető chatbotok fejlesztésére. Évekig úgy hitték, hogy a chatbotok annál jobban teljesítenek, minél több információhoz jutnak az interneten.

2024-re a mesterséges intelligencia rendszerei szinte az összes interneten elérhető szöveget felhasználják majd. Ez azt jelenti, hogy a vállalatoknak új megoldásokat kell találniuk a chatbotok, beleértve az érvelő rendszereket is, korszerűsítésére.

|

A DeepSeek startup egyszer szenzációt keltett az OpenAI-nál alacsonyabb költségekkel járó érvelési modelljével. Fotó: Bloomberg . |

Tavaly óta olyan cégek, mint az OpenAI, a megerősítéses tanulási technikákra összpontosítanak. Ez a folyamat jellemzően több hónapig tart, ezalatt a mesterséges intelligencia próbálgatással tanulja meg a viselkedést.

Például több ezer probléma megoldásával a rendszer képes azonosítani az optimális módszert a helyes válasz eléréséhez. Ebből kiindulva a kutatók kifinomult visszacsatolási mechanizmusokat építenek, amelyek segítenek a rendszernek megkülönböztetni a helyes és a helytelen megoldásokat.

„Hasonló ahhoz, mint ahogy egy kutyát idomítasz. Ha a rendszer jól működik, jutalomfalatot adsz neki. Különben azt mondod: »Ez a kutya rossz«” – osztotta meg Jerry Tworek, az OpenAI kutatója.

A mesterséges intelligencia a jövő?

A New York Times szerint a megerősítéses tanulási technikák hatékonyak a matematika, a természettudományok és a számítógépes programozás követelményeinek kezelésében. Ezek olyan területek, ahol a helyes vagy helytelen válaszok egyértelműen meghatározhatók.

Ezzel szemben a megerősítéses tanulás hatástalan az írásban, a filozófiában vagy az etikában – olyan területeken, ahol nehéz megkülönböztetni a jót és a rosszat. A kutatók mindazonáltal azt állítják, hogy ez a technika még nem matematikai kérdések esetén is javíthatja a mesterséges intelligencia teljesítményét.

„A rendszerek megtanulják a pozitív és negatív eredményekhez vezető utakat” – mondta Jared Kaplan, az Anthropic tudományos igazgatója.

|

Az Anthropic, a Claude AI modellt birtokló startup weboldala. Fotó: Bloomberg . |

Fontos megjegyezni, hogy a megerősítéses tanulás és az érvelő rendszerek két különböző fogalom. Pontosabban, a megerősítéses tanulás az érvelő rendszerek felépítésének egy módszere. Ez a chatbotok érvelésének utolsó betanítási szakasza.

Mivel még viszonylag új, a tudósok még nem lehetnek biztosak abban, hogy a chatbotok érvelése vagy a megerősítéses tanulás segíthet-e a mesterséges intelligenciának az emberekhez hasonlóan gondolkodni. Meg kell jegyezni, hogy sok jelenlegi MI-képzési trend kezdetben nagyon gyorsan fejlődik, majd fokozatosan lelassul.

Továbbá a chatbotok érvelése továbbra is hibázhat. A valószínűség alapján a rendszer azt a folyamatot választja, amely a legjobban hasonlít a tanult adatokhoz, akár az internetről, akár megerősítéses tanulással. Ezért a chatbotok továbbra is választhatnak helytelen vagy logikátlan megoldásokat.

Forrás: https://znews.vn/ai-ly-luan-nhu-the-nao-post1541477.html

![[Infografika] Vietnam gazdasági helyzetjelentése, 2026 első negyedéve: Erős növekedési lendület](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2026/04/04/1775298512042_tang-truong-kinh-te-viet-nam.jpeg)

![[Kép] Közeli kép a Long Thanh repülőtérhez vezető 10 sávos útról](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2026/04/04/1775291871988_ndo_br_1-resize-5690-jpg.webp)

Hozzászólás (0)