|

| AIを生物兵器として扱うよう求める呼びかけのイラスト。(出典: gizmodo.com) |

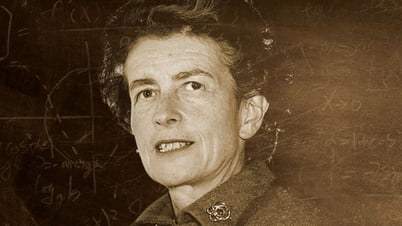

科学者であり医師で、米国のFuture of Life Instituteの所長でもあるエミリア・ジャヴォルスキー氏は、記事「AIを核兵器ではなく生物兵器として扱う」の中で、世界が最近繰り返しAIを核爆弾と比較しているにもかかわらず、この種の技術を生物兵器またはバイオテクノロジーとして規制するというより適切なアプローチがあると主張しています。

著者によると、AIは人類史上、おそらく人類が現在開発している技術の中で最も強力なものと言えるでしょう。差別、民主主義への脅威、影響力の集中など、AIの有害な影響は十分に文書化されています。

しかし、大手 AI 企業はますます強力な AI システムの構築に競い合っており、人類史上前例のない速度でリスクが高まっています。

リーダーたちは、AI の台頭とそれに伴うリスクをいかに抑制し、制御するかに取り組むにあたり、人類が過去に AI を生み出すために使用してきたのと同じルールと基準を考慮する必要があります。

特に人命が危険にさらされている場合には、調整と革新は共存できます。

核技術からの警告

原子力エネルギーは死亡率の点で石油より600倍以上安全で、非常に効率的であるにもかかわらず、長年にわたる原子力への取り組みから生じた結果のために、原子力エネルギーに取り組む国はほとんどない。

世界は原子爆弾と水素爆弾という形で核技術を知りました。これらの兵器によって、人類は歴史上初めて、人類文明を終焉させる技術を開発しました。それは、安全性と制御よりもスピードと革新を優先した軍拡競争の産物でした。

その後、チェルノブイリと福島の原子力災害の原因となった技術的な安全性とリスク管理の失敗により、人々が原子力エネルギーのプラス面を受け入れる可能性は完全に失われた。

原子力発電のリスク評価は全体的に良好であり、科学者らは原子力発電の実現可能性を世界に納得させようと何十年も努力してきたが、「原子力」という概念そのものは依然として…汚れた状態のままである。

技術が初期段階で害を及ぼすと、社会の認識や過剰反応によって、その潜在的な利益が永久に制限されてしまう可能性があります。原子力発電における初期の失敗により、人類はそのクリーンで安全なエネルギー源を活用できず、カーボンニュートラルとエネルギーの安定性は依然として夢物語のままです。

バイオテクノロジーへの正しいアプローチ

しかし、いくつかの分野では、人々は正しい方向に進んでいます。バイオテクノロジーはそうした分野の一つであり、治療法のない病気で毎日多くの患者が苦しみ、亡くなっている現状において、急速な発展が促されています。

この研究の精神は、「早く動いて物事を壊す」ことではなく、可能な限り迅速かつ安全に革新を起こすことです。人間は、社会と個人の福祉を守り、破滅につながる可能性のある反発によって業界が麻痺するのを防ぐための規制、倫理、規範のシステムによって、この分野における革新のペースを制限しています。

冷戦期、生物兵器禁止条約で生物兵器が禁止された際、対立する超大国は、そのような兵器の開発は誰の利益にもならないという点で合意しました。指導者たちは、制御が困難でありながら容易にアクセスできるこれらの技術は、軍拡競争に勝つための手段ではなく、人類そのものへの脅威として捉えるべきだと認識しました。

| エミリア・ジャヴォルスキー氏は、最近、AI開発の6ヶ月間のモラトリアムを提唱する公開書簡に署名した科学者の一人です。彼女はまた、AIが人類に「絶滅の危険」をもたらすと警告する声明にも署名しました。 |

生物兵器の開発競争が一時停止したことで、人類は責任あるペースで生物兵器を開発できるようになり、科学者や規制当局は、人間に危害を及ぼす可能性のあるあらゆる新たな技術革新に対して厳格な基準を適用するようになった。

こうした調整にはコストがかかったが、クリーンエネルギーから農業までさまざまな分野で応用されるバイオエコノミーも確立された。

新型コロナウイルス感染症のパンデミックの間、生物学者はmRNA技術を応用し、人類史上前例のないスピードで効果的なワクチンを生産した。

AI研究者を対象とした最近の調査では、回答者の36%がAIが核レベルの災害を引き起こす可能性があると考えていることが明らかになりました。しかし、政府の対応や規制は遅く、技術導入のペースとは一致していません。ChatGPTアプリのユーザー数は現在1億人を超えています。

AIのリスクが急速に高まっていることを受け、米国では1,800人のCEOと1,500人の教授が最近、AI開発の6ヶ月間の一時停止と、規制およびリスク軽減のための緊急プロセスを求める書簡に署名しました。この一時停止により、国際社会はAIがもたらす危害を抑制し、社会に取り返しのつかない災害をもたらすリスクを防ぐための時間を確保できるでしょう。

AIのリスクと潜在的な害を評価すると同時に、この技術のプラスの可能性を見失わないようにすることも検討しなければなりません。今、AIを責任を持って開発すれば、この技術から計り知れない恩恵を得ることができるでしょう。例えば、AIを創薬・開発に応用すること、医療の質とコストの改善、医師や医療へのアクセス向上などが挙げられます。

GoogleのDeepMindは、AIが人類が長らく避けてきた生物学における根本的な問題を解決する可能性を秘めていることを示しました。この研究によると、AIは国連の持続可能な開発目標(SDGs)の達成を加速させ、人類の健康、公平性、繁栄、そして平和の向上へと導く可能性があるとされています。

50年前の生物兵器禁止条約の時のように、国際社会が団結し、AI開発の安全と責任を確保する時が来ました。早急に行動を起こさなければ、AIの明るい未来と私たちの現在の社会を破壊する危険があります。

[広告2]

ソース

![[写真] カットバ島 - 緑の楽園の島](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F04%2F1764821844074_ndo_br_1-dcbthienduongxanh638-jpg.webp&w=3840&q=75)

コメント (0)