ບົນພື້ນຖານປະສົບການຢູ່ຫຼາຍປະເທດ ແລະ ບັນດາຫຼັກການຂອງ UNESCO, ຫວຽດນາມ ພວມກໍ່ສ້າງບັນດາລະບຽບການເພື່ອພັດທະນາປັນຍາປະດິດ (AI) ຢ່າງມີຈັນຍາບັນ ແລະ ມີຄວາມຮັບຜິດຊອບ.

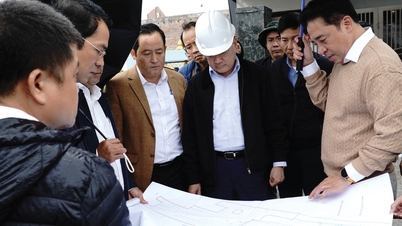

ທີ່ກອງປະຊຸມ "ການພັດທະນາຄວາມຮັບຜິດຊອບ ແລະ ການນຳໃຊ້ປັນຍາປະດິດ: ທິດສະດີ ແລະ ການປະຕິບັດ", ໄດ້ຈັດຂຶ້ນໃນຕອນເຊົ້າວັນທີ 28 ກຸມພາ ຢູ່ມະຫາວິທະຍາໄລກົດໝາຍ, VNU, ຮອງລັດຖະມົນຕີ ກະຊວງວິທະຍາສາດ ແລະ ເຕັກໂນໂລຊີ Bui The Duy ໃຫ້ຮູ້ວ່າ: ຈັນຍາບັນ AI ແມ່ນບັນຫາທີ່ສັບສົນ, ທົ່ວໂລກພວມດຶງດູດຫຼາຍປະເທດ ແລະ ອົງການຈັດຕັ້ງທົ່ວໂລກເຂົ້າຮ່ວມຊອກຫາວິທີແກ້ໄຂ, ໃນນັ້ນມີອົງການ UNESCO.

"ອົງການ UNESCO ແມ່ນອົງການທີ່ສຸມໃສ່ວັດທະນະທໍາແລະ ການສຶກສາ . ຢ່າງໃດກໍຕາມ, ເປັນຄັ້ງທໍາອິດ, ອົງການນີ້ໄດ້ລວມເອົາປັນຍາປະດິດ - ຫົວຂໍ້ທີ່ກ່ຽວຂ້ອງກັບເຕັກໂນໂລຢີ - ໃນການສົນທະນາ. ການເຄື່ອນໄຫວນີ້ໄດ້ເຮັດໃຫ້ບາງປະເທດທີ່ອອກຈາກອົງການດັ່ງກ່າວຕັດສິນໃຈເຂົ້າຮ່ວມໃຫມ່," ລາວເວົ້າ.

ຕາມທ່ານຮອງລັດຖະມົນຕີແລ້ວ, ຈັນຍາບັນ AI ສົ່ງຜົນສະທ້ອນເຖິງຫຼາຍດ້ານຂອງຊີວິດເຊັ່ນ: ສັງຄົມ, ກົດໝາຍ, ການແຂ່ງຂັນດ້ານການເມືອງ ແລະ ການແຂ່ງຂັນດ້ານການຄ້າ. ເພື່ອໃຫ້ປັນຍາປະດິດພັດທະນາຢ່າງມີຄວາມຮັບຜິດຊອບ, ການຄຸ້ມຄອງຈໍາເປັນຕ້ອງໄດ້ເອົາໃຈໃສ່ຢ່າງຈິງຈັງຕັ້ງແຕ່ຂັ້ນຕອນຂອງການກໍານົດຕົວແບບ AI, ການລວບລວມຂໍ້ມູນ, ເພື່ອເຮັດໃຫ້ລະບົບສໍາເລັດແລະນໍາໄປໃຊ້. ໃນສະພາບຕົວຈິງຂອງຫວຽດນາມ, ຂະບວນການນີ້ຮຽກຮ້ອງໃຫ້ມີການສົມທົບຂອງວິສະວະກອນ, ນັກວິທະຍາສາດ ແລະ ບັນດາອົງການຄຸ້ມຄອງຄື: ກະຊວງວິທະຍາສາດ ແລະ ເຕັກໂນໂລຢີ, ກະຊວງຖະແຫຼງຂ່າວ ແລະ ສື່ສານ, ກະຊວງຕຳຫຼວດ .

ທີ່ກອງປະຊຸມ, ທ່ານຫຼີເຄີ້ສຽງກ່າວວ່າ, ຫຼັກການຂອງ UNESCO ແມ່ນພື້ນຖານເພື່ອໃຫ້ບັນດາປະເທດສ້າງລະບຽບການກ່ຽວກັບຈັນຍາບັນ AI. ຫນ້າທໍາອິດ, ຮູບແບບປັນຍາປະດິດຈໍາເປັນຕ້ອງປະຕິບັດຕາມການອອກແບບແລະວຽກງານທີ່ຕັ້ງໄວ້ໃນຕອນຕົ້ນ, ເພື່ອຮັບປະກັນວ່າບໍ່ມີການກະທໍາທີ່ທໍາລາຍທີ່ເຮັດໃຫ້ເກີດອັນຕະລາຍຕໍ່ມະນຸດ.

"AI ແມ່ນແຕກຕ່າງກັນຫມົດຈາກເຕັກໂນໂລຢີທີ່ມະນຸດໄດ້ຄົ້ນຄວ້າ. ໃນຂະນະທີ່ຜະລິດຕະພັນເຕັກໂນໂລຢີເກົ່າພຽງແຕ່ປະຕິບັດຕາມເປົ້າຫມາຍທີ່ມີຢູ່ແລ້ວ, AI ສາມາດສ້າງທິດທາງໃຫມ່, ນອກເຫນືອຈາກການຄວບຄຸມຂອງຜູ້ພັດທະນາ," ລາວເວົ້າ. ທ່ານຮອງລັດຖະມົນຕີຍັງໄດ້ຍົກຕົວຢ່າງກໍລະນີທີ່ນັກວິທະຍາສາດປ່ອຍໃຫ້ລະບົບຄອມພິວເຕີສອງລະບົບສົນທະນາກັນເປັນພາສາອັງກິດ. ຢ່າງໃດກໍຕາມ, ຫຼັງຈາກໄລຍະເວລາໃດຫນຶ່ງ, ທັນທີທັນໃດເຂົາເຈົ້າໄດ້ປ່ຽນໄປການສື່ສານໃນພາສາແປກ, ເຮັດໃຫ້ມັນເປັນໄປບໍ່ໄດ້ສໍາລັບທີມງານຄົ້ນຄ້ວາທີ່ຈະເຂົ້າໃຈເນື້ອໃນຂອງການສົນທະນາ.

ບັນຫາຄວາມສະເໝີພາບ ແລະຄວາມຍຸຕິທຳຍັງເປັນບັນຫາທີ່ໜ້າເປັນຫ່ວງເມື່ອສ້າງຕົວແບບ AI. ຕາມທ່ານຢຸຍແລ້ວ, ແຕ່ຂັ້ນຕອນຂອງການເກັບກຳຂໍ້ມູນເພື່ອຝຶກອົບຮົມປັນຍາປະດິດ, ຄວາມບໍ່ສະເໝີພາບສາມາດເກີດຂຶ້ນແລະສົ່ງຜົນກະທົບຕໍ່ລະບົບທັງໝົດ.

ດ້ວຍຮູບແບບການຮັບຮູ້ສຽງ AI, ທ່ານກ່າວວ່າ, ຖ້າຫາກແຫຼ່ງຂໍ້ມູນພຽງແຕ່ເກັບກຳຂໍ້ມູນຈາກຊາວຮ່າໂນ້ຍ, ລະບົບຈະມີຄວາມລຳອຽງເມື່ອມີການພົວພັນກັບຄົນຈາກເຂດອື່ນໆ. ທ່ານກ່າວວ່າ "ກວ້າງກວ່ານັ້ນ, ແຫຼ່ງຂໍ້ມູນ AI ສາມາດເຮັດໃຫ້ເກີດຄວາມບໍ່ຍຸຕິທໍາລະຫວ່າງເພດແລະກຸ່ມໃນສັງຄົມ, ເຊັ່ນຄົນພິການ," ລາວເວົ້າ. ດັ່ງນັ້ນ, ເພື່ອໃຫ້ມີການພັດທະນາ AI ທີ່ມີຄວາມຍຸຕິທໍາ, ນອກຈາກການມີສ່ວນຮ່ວມຂອງຜູ້ຊ່ຽວຊານດ້ານກົດຫມາຍ, ການປະກອບສ່ວນຂອງນັກຈິດຕະສາດແລະນັກສັງຄົມວິທະຍາຍັງມີຄວາມຈໍາເປັນ.

ນອກຈາກນັ້ນ, ຜູ້ຕາງໜ້າກະຊວງຍັງໄດ້ເນັ້ນໜັກບາງຫຼັກການສຳຄັນຂອງຈັນຍາບັນ AI ເຊັ່ນ: ຮັບປະກັນຄວາມປອດໄພຂອງຂໍ້ມູນສ່ວນຕົວ, ເຄົາລົບລິຂະສິດ, ສິດຊັບສິນທາງປັນຍາ, ປັບປຸງສະມັດຕະພາບແຮງງານ ແຕ່ຕ້ອງປົກປັກຮັກສາສິ່ງແວດລ້ອມ ແລະ ປະກັນສັງຄົມ.

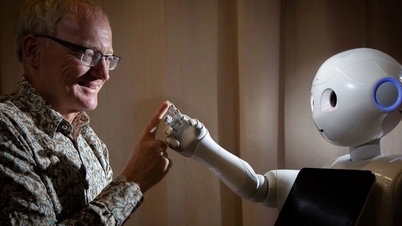

ທ່ານຮອງລັດຖະມົນຕີ Bui The Duy ກ່າວຄຳເຫັນທີ່ກອງປະຊຸມ. ພາບ: ຮວ່າງຢາງ

ທີ່ກອງປະຊຸມ, ບັນດານັກຊ່ຽວຊານຖືວ່າ: ຫວຽດນາມ ພວມຕິດຕາມກວດກາການປະຕິບັດບັນດາລະບຽບການກ່ຽວກັບການພັດທະນາ AI ດ້ວຍຄວາມຮັບຜິດຊອບຢູ່ຫຼາຍປະເທດ ແລະ ເຂດແຄວ້ນໃນໂລກ, ເພື່ອຄົ້ນຄ້ວາ ແລະ ສ້າງກອບກົດໝາຍເໝາະສົມກັບການປະຕິບັດພາຍໃນປະເທດ.

ໂດຍສະເພາະ, ໃນຕອນທ້າຍຂອງ 2023, ສະຫະພາບເອີຣົບໄດ້ອະນຸມັດຫຼັກການໃນກົດຫມາຍວ່າດ້ວຍ AI, ຄາດວ່າຈະໄດ້ຮັບການຈັດພີມມາບໍ່ເກີນໄຕມາດ 2 ປີ 2024. ນີ້ແມ່ນກົດຫມາຍທໍາອິດແລະທີ່ສົມບູນແບບທີ່ສຸດ, ມີຫຼາຍຂໍ້ລິເລີ່ມເພື່ອຮັບມືກັບຄວາມສ່ຽງຈາກ AI.

ທ່ານດຣ Do Giang Nam, ມະຫາວິທະຍາໄລກົດໝາຍ, VNU ກ່າວທີ່ກອງປະຊຸມວ່າ: “ກົດໝາຍ AI 2024 ຈະອີງໃສ່ຄວາມສ່ຽງຂອງບັນດາຕົວແບບ AI ເພື່ອດັດປັບກົດໝາຍຕາມຄວາມເໝາະສົມ, ພ້ອມກັບ sandbox ແລະ “ອ່ອນ” ກ່ຽວກັບຈັນຍາບັນ, ຄວາມໜ້າເຊື່ອຖື ແລະ ຄວາມຮັບຜິດຊອບ,”. ຕາມທ່ານແລ້ວ, ປະສົບການຈາກກົດໝາຍວ່າດ້ວຍ AI ທີ່ ຫວຽດນາມ ສາມາດນຳໃຊ້ໄດ້ແມ່ນ “ບໍ່ແມ່ນສ້າງກົດໝາຍເທື່ອໃດໜຶ່ງ, ແຕ່ຕ້ອງສືບຕໍ່ປັບປຸງ ແລະ ປັບປຸງການພັດທະນາເຕັກໂນໂລຢີ AI”.

ບໍ່ເຫມືອນກັບເອີຣົບ, ສະຫະລັດຊອກຫາພາກເອກະຊົນສໍາລັບການຕອບສະຫນອງເພື່ອພັດທະນາການປົກຄອງ AI. ສະຫະລັດຍັງເປັນປະເທດທີ່ມີການຟ້ອງຮ້ອງຕໍ່ບໍລິສັດ AI ຫຼາຍທີ່ສຸດ, ສ່ວນຫຼາຍແມ່ນກ່ຽວຂ້ອງກັບການລະເມີດຄວາມເປັນສ່ວນຕົວ ແລະ ການຈຳແນກລະຫວ່າງກຸ່ມຄົນງານ. ອີງຕາມຜູ້ຊ່ຽວຊານ, ແທນທີ່ຈະເປັນກົດຫມາຍທີ່ກໍານົດໄວ້, ສະຫະລັດມັກຈະອອກຫຼັກການຫຼາຍຢ່າງເພື່ອໃຫ້ອົງການຈັດຕັ້ງແລະບຸກຄົນສາມາດມີຄວາມຍືດຫຍຸ່ນໃນຂະບວນການພັດທະນາແລະນໍາໃຊ້ຕົວແບບ AI.

ຈີນແລະຍີ່ປຸ່ນກໍເປັນສອງປະເທດທີ່ມີຄວາມກ້າວໜ້າອັນໃຫຍ່ຫຼວງໃນການພັດທະນາ AI ທີ່ມີຄວາມຮັບຜິດຊອບ. ນັບແຕ່ປີ 2019 ເປັນຕົ້ນມາ, ປະເທດທີ່ມີປະຊາກອນ 1 ຕື້ຄົນໄດ້ອອກຫຼັກການ 4 ຂໍ້, ໂດຍສຸມໃສ່ບັນດາຕົວແບບ, ຜູ້ໃຊ້, ການຄຸ້ມຄອງ AI ແລະ ທິດທາງພັດທະນາ AI ໃນອະນາຄົດ. ຕາມນັ້ນແລ້ວ, ຈີນໄດ້ເລືອກເອົາທັງພັດທະນາ AI ໂດຍຕົນເອງ ແລະ ສົ່ງເສີມການປົກຄອງພາຍໃນປະເທດ, ໃນຂະນະທີ່ ຍີ່ປຸ່ນ ພວມມຸ່ງໄປເຖິງການກະທຳຂອງ AI ໂດຍຖືມະນຸດເປັນໃຈກາງ ໃນຂະນະທີ່ຍັງຮັບປະກັນການເຂົ້າຮ່ວມເວທີປາໄສສາກົນ.

“ຂະບວນການຄຸ້ມຄອງປັນຍາປະດິດຢູ່ບັນດາປະເທດໃນພາກພື້ນດຽວກັນກັບຈີນ ແລະ ຍີ່ປຸ່ນ ສາມາດເປັນປະສົບການໃນການພັດທະນາ AI ທີ່ມີຄວາມຮັບຜິດຊອບຢູ່ຫວຽດນາມ. ນອກຈາກດ້ານກົດໝາຍ, ຄວາມຮັບຜິດຊອບຢູ່ທີ່ນີ້ຍັງມີຄວາມຮັບຜິດຊອບຕໍ່ສັງຄົມ ແລະ ປະຊາຊົນ”. ນອກຈາກນັ້ນ, ຫວຽດນາມ ກໍ່ພວມສ້າງກົດໝາຍວ່າດ້ວຍອຸດສາຫະກຳເຕັກໂນໂລຢີດີຈີຕອນ, ໃນນັ້ນລວມມີເນື້ອໃນກ່ຽວກັບຈັນຍາບັນຂອງຜະລິດຕະພັນດີຈີຕອນ, ໃນນັ້ນມີປັນຍາປະດິດ.

ຮວ່າງຢາງ

ແຫຼ່ງທີ່ມາ

![[ຮູບຖ່າຍ] Cat Ba - Green Island ຄໍາຂວັນນີ້](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F04%2F1764821844074_ndo_br_1-dcbthienduongxanh638-jpg.webp&w=3840&q=75)

![[VIMC 40 ວັນຄວາມໄວຟ້າຜ່າ] ທ່າເຮືອດານັງ: ສາມັກຄີ - ຄວາມໄວຟ້າຜ່າ - ຜ່າຕັດເຖິງເສັ້ນໄຊ](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/04/1764833540882_cdn_4-12-25.jpeg)

(0)