Recente incidenten met vooringenomenheid en vervalsing van documenten hebben ertoe geleid dat wetenschappers opnieuw nadenken over de mate waarin AI bij onderzoek betrokken mag worden.

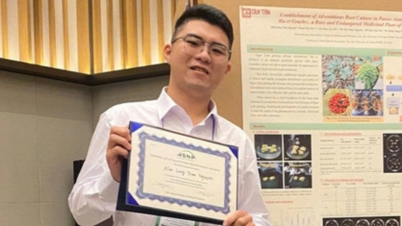

Onlangs deelde professor en doctor in de taalkunde Nguyen Van Hiep op zijn persoonlijke pagina een verhaal dat lezers choqueerde. Hij ontdekte dat AI zijn documenten had vervalst met informatie die een vriend hem had gestuurd. Hij ontdekte ook per ongeluk dat het artikel van universitair hoofddocent en doctor in de wetenschappen Tran Van Co eveneens door AI was vervalst.

AI is een onmisbaar onderdeel geworden van het menselijk leven, maar experts benadrukken altijd dat we AI slechts als een ondersteunend hulpmiddel moeten zien. AI-gebruikers moeten altijd alert en deskundig zijn om data te verwerken en de resultaten te evalueren die zijn verkregen na "samenwerking" met AI. Met name in wetenschappelijk onderzoek hebben veel studies aangetoond dat het grootste probleem waar waakzaamheid geboden is, de bias in data en modellen is. AI kan bevooroordeeld zijn, analyseresultaten verdraaien, vooroordelen of discriminatie creëren en informatie manipuleren als het niet goed wordt beheerd.

Met name het gebruik van AI in sociaalwetenschappelijk onderzoek vereist veel meer voorzichtigheid. Omdat vakgebieden binnen de sociale wetenschappen, zoals filosofie, taalkunde, etnologie, geschiedenis, enzovoort, allemaal menselijk gedrag, cultuur en gedrag als onderzoeksobjecten nemen, zijn de data vaak nauw verbonden met de Vietnamese sociaal-culturele context, met diepgang en specificiteit. Als AI-trainingsdata historische vooroordelen weerspiegelen, kan het gevaar bestaan dat AI conclusies trekt die de ongelijkheid tussen geslacht, klasse, ras of geografische regio verergeren. Het risico is nog groter wanneer AI wordt gebruikt om menselijk gedrag te analyseren, open enquêtes te beantwoorden of deel te nemen aan mediacontent.

Volgens sommige deskundigen op het gebied van de sociale wetenschappen heeft AI momenteel moeite met het verkrijgen van toegang tot auteursrechtelijk beschermde of betaalde gegevensbronnen, waardoor de informatie onvolledig en actueel is.

Het fenomeen van het verzinnen van documenten om plausibele verhalen te creëren komt vaak voor bij minder populaire onderwerpen, in talen met beperkte databronnen zoals het Vietnamees, en moet worden gewaarschuwd om gebruikers te waarschuwen. AI-systemen zijn over het algemeen momenteel zeer beperkt in het begrijpen van sociale en culturele context, waardoor hun hulp bij het interpreteren van ambigue, metafoorrijke kennis uit de sociale wetenschappen niet echt betrouwbaar is.

Hoewel AI veel potentieel biedt voor wetenschappelijk onderzoek, moet de toepassing ervan zeer zorgvuldig gebeuren. Het kent grenzen en moet altijd hand in hand gaan met het kritisch denkvermogen van de onderzoeker.

Het is duidelijk dat, hoewel AI veel potentieel biedt voor wetenschappelijk onderzoek, de toepassing ervan zeer voorzichtig en beperkt moet zijn en altijd gepaard moet gaan met het kritisch vermogen van de onderzoeker. Degene die AI gebruikt, moet deze beperkingen in het gebruik ervan duidelijk identificeren en ervoor zorgen dat AI de kernwaarden van de wetenschap niet verandert. Om de integriteit van wetenschappelijk onderzoek te beschermen, moeten de rol en verantwoordelijkheid van wetenschappers naar een hoger niveau worden getild. Daarnaast is het noodzakelijk om een juridisch bindend ethisch kader voor AI voor te stellen in de context van de Vietnamese cultuur, tradities en sociale normen.

We hanteren een systeem van negen principes om onderzoek en ontwikkeling van veilige en verantwoorde AI-systemen te bevorderen, negatieve effecten te beperken en risico's te beheersen, zoals voorgesteld door het Ministerie van Wetenschap en Technologie . Dit systeem benadrukt databeveiliging, respect voor mensenrechten en menselijke waardigheid, en de verantwoordingsplicht van AI-gebruikers. Met name op het gebied van wetenschappelijk onderzoek heeft de Staatsraad van Hoogleraren in 2023 ook officieel bericht nr. 25/HDGSNN uitgegeven, waarin de raden van hoogleraren in de industrie en de faciliteiten die de kwaliteit van wetenschappelijk werk beoordelen, worden verzocht speciale aandacht te besteden aan het detecteren en evalueren van werk dat gebruikmaakt van of wordt ondersteund door AI-technologie. Deze vereisten zijn bedoeld om ervoor te zorgen dat onderzoeksresultaten die gebruikmaken van AI nog steeds voldoen aan wetenschappelijke normen, en om misbruik van AI in wetenschappelijk onderzoek en publicaties te voorkomen.

In de komende tijd, wanneer de Wet op Kunstmatige Intelligentie wordt uitgevaardigd, met strenge regels met betrekking tot ethiek en verantwoordelijkheid bij het gebruik van AI, zal dit bijdragen aan het creëren van een gezonde omgeving voor AI-ontwikkeling en zal het zorgen voor actievere en verantwoordelijkere ondersteuning van wetenschappers bij onderzoekswerkzaamheden.

Bron: https://nhandan.vn/canh-giac-voi-mat-trai-cua-ai-post916545.html

![[Foto] Plechtige opening van de 10e zitting, 15e Nationale Vergadering](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/20/1760937111622_ndo_br_1-202-jpg.webp)

![[Foto] Het stuurcomité van de herfstbeurs van 2025 controleert de voortgang van de organisatie](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/20/1760918203241_nam-5371-jpg.webp)

![[Video] Bloemen- en cadeaumarkt in Ho Chi Minhstad bruist op 20 oktober](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/10/20/1760931107653_720-jpg.webp)

![[Video] Partij- en staatsleiders en afgevaardigden van de Nationale Vergadering bezoeken het mausoleum van president Ho Chi Minh](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/10/20/1760929911350_img-1885-4872-png.webp)

Reactie (0)