Producten van AI: racisme en vooroordelen

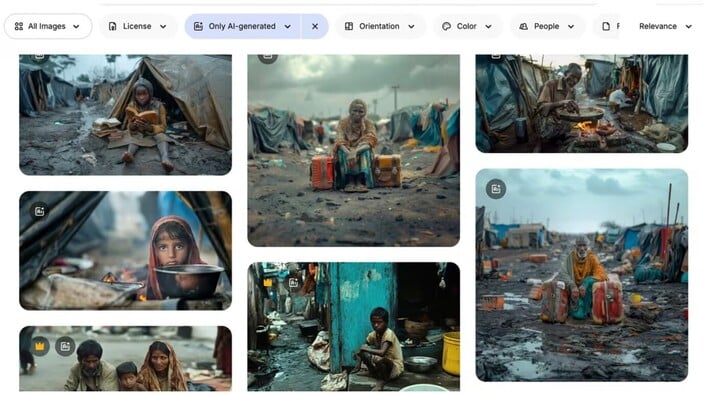

Volgens experts op het gebied van wereldwijde gezondheid overspoelen door AI gegenereerde beelden van onderwerpen zoals armoede, kinderen en slachtoffers van seksueel geweld online fotoarchieven, die steeds vaker worden gebruikt door niet-gouvernementele organisaties (ngo's). Deskundigen waarschuwen dat dit een "nieuw tijdperk van armoede-uitbuitingscultuur" zou kunnen inluiden.

"Deze beelden weerspiegelen het standaardbeeld van armoede: kinderen die lege kommen vasthouden, gebarsten grond... heel stereotiep", aldus Arsenii Alenichev, een onderzoeker aan het Instituut voor Tropische Geneeskunde in Antwerpen die de productie van beelden van wereldwijde gezondheid bestudeert .

De heer Alenichev verzamelde meer dan 100 door AI gegenereerde afbeeldingen van extreme armoede, die door individuen of NGO's werden gebruikt in socialemediacampagnes tegen honger en seksueel geweld.

De beelden die hij met The Guardian deelde, tonen overdreven, stereotiepe taferelen: kinderen ineengedoken in modderplassen; een Afrikaans meisje in een trouwjurk met tranen die over haar gezicht stromen. In een recent commentaar in het tijdschrift Lancet Global Health betoogde hij dat de beelden neerkwamen op "armoedeporno versie 2.0".

Screenshot van een door AI gegenereerde afbeelding van 'armoede' op een fotowebsite. (Foto: Freepik)

De heer Alenichev en vele andere experts zeggen dat het gebruik van AI-beelden toeneemt vanwege zorgen over auteursrechten en kosten. De bezuinigingen van de Amerikaanse overheid op ngo's hebben het probleem verergerd.

"Het is duidelijk dat veel organisaties AI-afbeeldingen gaan gebruiken in plaats van echte foto's, omdat het goedkoop is. Je hoeft je ook geen zorgen te maken over auteursrechten en allerlei andere zaken", zei hij.

Ligt de verantwoordelijkheid bij de gebruiker of bij het platform?

Door AI gegenereerde afbeeldingen van armoede verschijnen op tientallen fotosites, waaronder Adobe Stock Photos en Freepik. Veel ervan hebben de volgende bijschriften: "surrealistisch kind in vluchtelingenkamp"; "Aziatische kinderen zwemmen in een rivier vol afval"; "blanke vrijwilliger geeft medisch advies aan zwarte kinderen in een Afrikaans dorp"; en meer. Adobe verkoopt de rechten op de laatste twee afbeeldingen op die lijst voor ongeveer £60.

"Deze foto's zijn ronduit racistisch en zouden niet gepost mogen worden, omdat ze de ergste stereotypen over Afrika, India of wat dan ook weergeven die je maar kunt bedenken", aldus Alenichev.

Joaquín Abela, CEO van Freepik, zei dat de verantwoordelijkheid voor het gebruik van zulke extreme afbeeldingen bij de gebruikers ligt, niet bij platforms zoals die van hem. Volgens hem worden AI-stockfoto's gemaakt door een wereldwijde gebruikersgemeenschap, die royalty's kunnen ontvangen wanneer Freepik-klanten ervoor kiezen hun foto's te kopen.

Freepik heeft geprobeerd de vooroordelen in zijn fotobibliotheken te bestrijden door "diversiteit te creëren". Tegelijkertijd proberen ze ook gendergelijkheid te garanderen in foto's van advocaten en leidinggevenden.

Maar, zegt hij, zijn platform kan niet alles. "Het is alsof je de oceaan probeert op te drogen. We hebben het geprobeerd, maar de realiteit is dat als klanten over de hele wereld willen dat hun afbeeldingen er op een bepaalde manier uitzien, daar absoluut niets aan te doen is."

Door AI gegenereerde afbeelding van de campagne van liefdadigheidsinstelling Plan International tegen kindhuwelijken uit 2023, die gericht is op het beschermen van "de privacy en waardigheid van meisjes". (Foto: Plan International)

Veel prestigieuze organisaties maken gebruik van door AI gegenereerde afbeeldingen, zelfs de Verenigde Naties.

Vorig jaar plaatsten de Verenigde Naties een video op YouTube met 'naspelingen' van seksueel geweld, waaronder de getuigenis van een Burundese vrouw die beschrijft hoe ze in 1993 door drie mannen werd verkracht en voor dood werd achtergelaten. De content was volledig gegenereerd door kunstmatige intelligentie (AI). De video werd verwijderd nadat The Guardian contact opnam met de VN voor een interview.

Een woordvoerder van de VN legde later uit waarom de video was verwijderd. "Wij zijn van mening dat de video op onjuiste wijze door AI is gegenereerd en mogelijk een risico vormt voor de integriteit van de informatie, doordat echte beelden worden vermengd met kunstmatige content die echt lijkt."

Het is al lang bekend dat door AI gegenereerde producten namaak zijn en soms de waarheid overdrijven. De heer Alenichev zei dat de verspreiding van deze bevooroordeelde afbeeldingen het probleem zou kunnen verergeren, omdat de afbeeldingen over het enorme internet verspreid kunnen worden en gebruikt kunnen worden om de volgende generatie AI te trainen.

Een woordvoerder van Plan International zei dat de NGO momenteel “het gebruik van AI om kinderen af te beelden afraadt.”

Minh Hoan

Bron: https://vtcnews.vn/chuyen-gia-bao-dong-tinh-trang-ai-tao-anh-rap-khuon-phong-dai-ar972160.html

![[Foto] 60-jarig jubileum van de oprichting van de Vietnamese Vereniging van Fotografische Kunstenaars](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F05%2F1764935864512_a1-bnd-0841-9740-jpg.webp&w=3840&q=75)

![[Foto] Voorzitter van de Nationale Assemblee, Tran Thanh Man, woont de VinFuture 2025 Award Ceremony bij](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F05%2F1764951162416_2628509768338816493-6995-jpg.webp&w=3840&q=75)

Reactie (0)