Produkter av AI: Rasisme og skjevhet

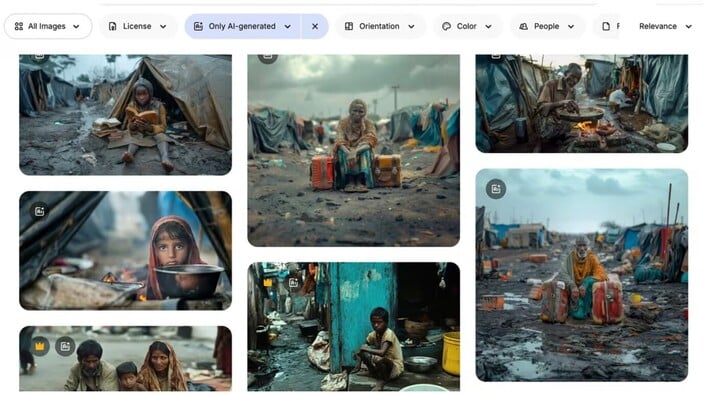

AI-genererte bilder av emner som fattigdom, barn og ofre for seksuell vold oversvømmer nettbaserte fotoarkiver, og ikke-statlige organisasjoner (NGO-er) bruker dem i økende grad, ifølge globale helseeksperter . Eksperter advarer om at dette kan signalisere en «ny æra med fattigdomsutnyttelseskultur».

«Disse bildene gjenspeiler standardsynet på fattigdom – barn som holder tomme boller, sprukken jord … veldig stereotype», sa Arsenii Alenichev, en forsker ved Instituttet for tropisk medisin i Antwerpen som studerer produksjonen av globale helsebilder .

Herr Alenichev samlet inn mer enn 100 AI-genererte bilder av ekstrem fattigdom, som ble brukt av enkeltpersoner eller frivillige organisasjoner i sosiale medier-kampanjer mot sult og seksuell vold.

Bildene han delte med Guardian viser overdrevne, stereotype scener: barn sammenkrøpet i gjørmepytter; en afrikansk jente i brudekjole med tårer som strømmer nedover ansiktet. I en nylig kommentar publisert i tidsskriftet Lancet Global Health argumenterte han for at bildene tilsvarte «fattigdomsporno versjon 2.0».

Skjermbilde som viser et AI-generert bilde av «fattigdom» på en fotonettside. (Foto: Freepik)

Alenichev og mange andre eksperter sier at bruken av AI-bilder øker på grunn av bekymringer om opphavsrett og kostnader. Den amerikanske regjeringens budsjettkutt til frivillige organisasjoner har forverret problemet.

«Det er tydelig at mange organisasjoner begynner å se på å bruke AI-bilder i stedet for ekte bilder fordi det er billig. Du trenger heller ikke å bekymre deg for opphavsrett og mye annet», sa han.

Ligger ansvaret hos brukeren eller plattformen?

AI-genererte bilder av fattigdom vises på dusinvis av fotosider, inkludert Adobe Stock Photos og Freepik. Mange har bildetekster som: «surrealistisk barn i flyktningleir»; «asiatiske barn som svømmer i en elv fylt med søppel»; «hvit frivillig som gir medisinske råd til svarte barn i en afrikansk landsby»; og mer. Adobe selger rettighetene til de to siste bildene på listen for rundt £60.

«Disse bildene er åpenbart rasistiske og burde ikke få lov til å bli publisert fordi de er de verste stereotypiene om Afrika, India eller hva som helst du kan tenke deg», sa Alenichev.

Joaquín Abela, administrerende direktør i Freepik, sa at ansvaret for å bruke slike ekstreme bilder ligger hos brukerne, ikke hos plattformer som hans. Etter hans syn lages AI-arkivbilder av et globalt fellesskap av brukere, som kan motta royalties når Freepik-kunder velger å kjøpe bildene deres.

Freepik har forsøkt å dempe skjevhetene som finnes i fotobibliotekene sine ved å «injisere mangfold». Samtidig prøver de også å sikre kjønnsbalanse i bilder av advokater og ledere.

Men, sier han, plattformen hans kan bare gjøre så mye. «Det er som å prøve å tørke ut havet. Vi har prøvd, men realiteten er at hvis kunder over hele verden vil at bildene deres skal se ut på en bestemt måte, er det absolutt ingenting noen kan gjøre med det.»

AI-generert bilde fra veldedighetsorganisasjonen Plan Internationals kampanje mot barneekteskap i 2023, som har som mål å beskytte «jenters privatliv og verdighet». (Foto: Plan International)

Mange prestisjefylte organisasjoner har brukt AI-genererte bilder, til og med FN.

I fjor la FN ut en video på YouTube med «gjenoppføringer» av seksuell vold, inkludert vitnesbyrdet til en burundisk kvinne som beskriver hvordan hun ble voldtatt og etterlatt for å dø av tre menn i 1993. Innholdet ble generert i sin helhet av kunstig intelligens. Videoen ble fjernet etter at Guardian kontaktet FN for et intervju.

En FN-talsperson forklarte senere hvorfor videoen ble fjernet. «Vi mener at videoen ble feilaktig generert av AI og kan utgjøre en risiko for informasjonsintegriteten, ved å blande ekte opptak med kunstig innhold som ser ut til å være ekte.»

AI-genererte produkter har lenge vist seg å være etterligninger, og noen ganger overdriver de sannheten. Alenichev sa at spredningen av disse partiske bildene kan gjøre problemet verre, fordi bildene kan spres over det enorme internett og brukes til å trene opp neste generasjon AI.

En talsperson for Plan International sa at NGO-en for tiden «fraråder å bruke kunstig intelligens til å avbilde barn».

Minh Hoan

Kilde: https://vtcnews.vn/chuyen-gia-bao-dong-tinh-trang-ai-tao-anh-rap-khuon-phong-dai-ar972160.html

![[Foto] Hjelp folk så raskt som mulig med å få et sted å bo og stabilisere livene sine.](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F09%2F1765248230297_c-jpg.webp&w=3840&q=75)

Kommentar (0)