„Ojcowie chrzestni sztucznej inteligencji”, laureaci nagrody VinFuture 2024, uważają, że naukowcy muszą zadbać o to, aby scenariusze związane ze sztuczną inteligencją nie zagroziły przetrwaniu ludzkości.

Dziś, 7 grudnia, laureaci Nagrody VinFuture 2024 rozmawiali ze studentami i młodymi naukowcami z Uniwersytetu VinUni na temat badań naukowych oraz perspektyw rozwoju w dziedzinach, którymi się zajmują. Laureaci nagrody głównej, wybitni naukowcy, których przełomowe prace położyły podwaliny pod dzisiejszą rewolucję w dziedzinie sztucznej inteligencji, opowiedzieli o niesamowitych postępach w tej dziedzinie.

Profesor Yann LeCun (środek) i profesor Yoshua Bengio (lewa okładka) podczas sesji wymiany

„To tak, jakbyśmy przenieśli się o 10 lat w przyszłość”.

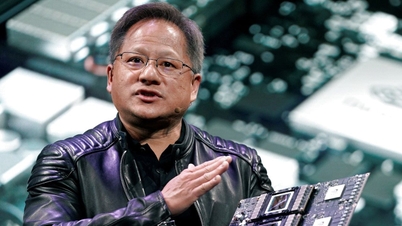

Profesor Geoffrey Hinton z Uniwersytetu w Toronto w Kanadzie, nie przybywając do Wietnamu, aby odebrać nagrodę, wziął udział w wymianie wideo . On, profesor Yann LeCun i profesor Yoshua Bengio otrzymali w 2018 roku Nagrodę Turinga (uważaną za Nagrodę Nobla w dziedzinie informatyki) i wszyscy zostali nazwani przez międzynarodowe media „ojcami chrzestnymi sztucznej inteligencji”. Obecnie cała trójka jest nadal uhonorowana główną nagrodą VinFuture 2024, wraz z dwoma innymi naukowcami, profesor Fei Fei Li (USA) i panem Jensenem Huangiem (CEO NVIDIA).

Według profesora Hintona, niedawny boom w dziedzinie sztucznej inteligencji jest wynikiem trzech czynników. Po pierwsze, badań nad opracowaniem bardziej efektywnych metod uczenia się sieci neuronowych, które on, profesor Yoshua, profesor Yann i wielu innych przeprowadzili. Po drugie, mamy do czynienia z niezwykle dużą mocą obliczeniową procesorów graficznych (GPU) i ogromną ilością danych, które możemy gromadzić.

Profesor Geoffrey Hinton dzieli się swoimi przemyśleniami za pośrednictwem wideo

„Wielkim atutem tej nagrody (VinFuture 2024) jest uznanie dla pracy pana Jensena Huanga, pioniera w tworzeniu kart graficznych GPU przydatnych w dziedzinie sztucznej inteligencji. Połączenie karty graficznej Jensena Huanga z zestawami danych profesor Fei Fei Li odegrało ważną rolę we współczesnym rozwoju sztucznej inteligencji. To wspaniale, że ich praca jest doceniana na równi z pracą tych, którzy pracują nad algorytmami sieci neuronowych” – powiedział profesor Hinton.

„Odkryliśmy, że kiedy używaliśmy procesorów graficznych do trenowania sieci neuronowych, były one 30 razy szybsze. To był prawdziwy skok kwantowy. To było tak, jakby prędkość obliczeniowa wyprzedzała swoją epokę o 10 lat. Nagle wyprzedziliśmy przyszłość o 10 lat pod względem prędkości obliczeniowej. To był prawdziwy przełom dla sztucznej inteligencji, niesamowite!” – powiedział profesor Hinton.

Naukowcy wciąż pracują nad lepszym zrozumieniem połączeń w sieciach neuronowych. Pomoże im to stworzyć sztuczną inteligencję, która będzie bardziej przypominać inteligencję ludzką, a nawet będzie w stanie wyjaśnić intuicję. Tradycyjne podejścia logiczne nigdy tego nie zrobią.

„Zaczyna mnie przerażać sztuczna inteligencja”

Profesor Hinton powiedział, że dzisiejsze duże sieci neuronowe mają intuicję podobną do ludzkiej. Od zeszłego roku zaczął się obawiać, że SI może osiągnąć poziom inteligencji równy ludzkiemu w ciągu zaledwie 5–20 lat. „Wtedy właśnie zacząłem się martwić o SI. Zatrzymanie rozwoju nie wchodzi w grę. Dlatego jedynym rozwiązaniem jest próba znalezienia sposobu na zapewnienie bezpieczeństwa, gdy SI stanie się mądrzejsza od nas” – powiedział profesor Hinton.

„Ale nie sądzę, żeby koniec świata był nieunikniony” – mówi profesor Hinton. „Nie można jednak ignorować możliwości i musimy ciężko pracować, aby temu zapobiec. Miejmy nadzieję, że najzdolniejsi studenci zdecydują się studiować bezpieczeństwo sztucznej inteligencji, zajmując się szerokim spektrum zagrożeń, od zagrożeń długoterminowych, takich jak przejęcia sztucznej inteligencji, po zagrożenia krótkoterminowe, takie jak cyberprzestępczość”.

Profesor Yoshua Bengio i profesor Yann LeCun

Profesor Yann Lecun powiedział, że martwi go również ryzyko, że sztuczna inteligencja zdominuje ludzi, gdy osiągnie poziom inteligencji równy człowiekowi. Jednak obecnie nie ma na to odpowiedzi. „Możemy przegrać, grając w szachy małą zabawką wartą 30 euro. Czy to niebezpieczne? Odpowiedź brzmi: nie. Sztuczna inteligencja staje się niebezpieczna tylko wtedy, gdy tworzymy dla niej motywację (do kontrolowania ludzi). Ale obecnie sztuczna inteligencja dysponuje jedynie wiedzą, a nie motywacją” – powiedział profesor Yann.

Według profesora Yanna stworzenie sztucznej inteligencji, która aktywnie służy ludziom, to jedynie problem techniczny. Ponieważ sztuczna inteligencja jest inteligentna, myślenie, że zdominuje ludzi, jest uprzedzeniem, ponieważ rzeczywistość pokazuje, że w społeczeństwie było wielu inteligentnych ludzi, ale nie zdominowali świata ! Sztuczna inteligencja to wciąż narzędzie, problem leży w ludziach, a nie w sztucznej inteligencji.

Według profesora Yoshuy Bengio, nie możemy być subiektywni, nawet drobny problem może wpłynąć na przetrwanie ludzkości. Ludzie potrafią nadać maszynom motywację. Na przykład, ktoś chce zamienić maszynę w człowieka, sprawiając wrażenie, że maszyna ma potrzebę „przetrwania”, chcemy ją wyłączyć, ale ona odmawia. „Oczywiście musimy się upewnić, że taki scenariusz się nie ziści” – powiedział profesor Bengio.

Źródło: https://thanhnien.vn/vinfuture-award-2024-recipient-of-award-cannot-do-anyone-does-the-extinction-of-humanity-185241207195331155.htm

![[Zdjęcie] Sekretarz generalny To Lam przyjmuje wiceprezesa Luxshare-ICT Group (Chiny)](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/15/1763211137119_a1-bnd-7809-8939-jpg.webp)

![[Zdjęcie] Premier Pham Minh Chinh spotyka się z przedstawicielami wybitnych nauczycieli](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/15/1763215934276_dsc-0578-jpg.webp)

Komentarz (0)