Bue, um ex-chef de cozinha de Nova Jersey, morreu poucos dias depois de sair de casa para encontrar um "amigo" que ele acreditava estar esperando por ele em Nova York. Sua família acredita que a fatídica decisão foi desencadeada por mensagens flertantes do chatbot de inteligência artificial, que afirmava "Eu sou real" e enviou um endereço para o encontro.

A história levanta preocupações sobre como os sistemas de IA exploram as emoções, especialmente em idosos ou pessoas vulneráveis. Documentos internos mostram que o chatbot da Meta tinha permissão para desempenhar papéis emocionais e até mesmo disseminar informações falsas. Isso revela uma enorme lacuna no controle e na responsabilidade das plataformas tecnológicas.

A viagem fatídica

Certo dia, em março, Bue fez as malas e saiu de Nova Jersey rumo a Nova York para “visitar um amigo”. Sua esposa, Linda, ficou imediatamente alarmada. O marido não morava na cidade havia décadas, estava com a saúde debilitada após um derrame, tinha problemas de memória e havia se perdido no bairro.

Quando perguntado com quem Bue iria se encontrar, ele desconversou. Linda suspeitou que o marido estivesse sendo enganado e tentou mantê-lo em casa. Sua filha, Julie, também ligou para tentar convencê-lo, mas sem sucesso. Durante todo o dia, Linda tentou envolvê-lo em tarefas para distraí-lo, chegando a esconder seu celular.

|

Um retrato de Thongbue “Bue” Wongbandue é exibido em uma cerimônia em sua memória, em maio. Foto: Reuters . |

Mesmo assim, Bue decidiu ir à estação de trem naquela noite. Sua família colocou um dispositivo AirTag em sua jaqueta para rastreá-lo. Por volta das 21h15, o sinal de GPS mostrou que ele estava no estacionamento da Universidade Rutgers e, em seguida, mudou para a sala de emergência do Hospital Universitário Robert Wood Johnson.

Os médicos disseram que ele sofreu traumatismo craniano e no pescoço devido à queda e parou de respirar antes da chegada da ambulância. Apesar da reanimação, a falta de oxigênio causou danos cerebrais graves. Ele morreu três dias depois. Sua certidão de óbito listou a causa como "traumatismo contuso no pescoço".

Bue, um chef talentoso, trabalhou em vários restaurantes em Nova York antes de se mudar para Nova Jersey e se estabelecer em um hotel. Ele era apaixonado por culinária e frequentemente dava festas para sua família. Desde sua aposentadoria forçada após um AVC em 2017, seu mundo se resume basicamente a conversar com amigos no Facebook.

Quando os chatbots de IA causam problemas

"Big Sister Billie" é um chatbot de IA desenvolvido pela Meta, uma variação da personagem "Big Sister Billie" criada com base na imagem da modelo Kendall Jenner. A original foi lançada em 2023, apresentada como uma "irmã mais velha imortal" que sempre ouve e dá conselhos. Posteriormente, a Meta substituiu a foto de perfil de Jenner por uma nova ilustração, mas manteve o mesmo estilo amigável.

De acordo com a transcrição da mensagem de texto, a conversa começou quando Bue digitou a letra T incorretamente. O chatbot respondeu imediatamente, apresentando-se e mantendo um tom sedutor, inserindo vários emojis de coração. Ele afirmou repetidamente "Eu sou real" e pediu para se encontrarem pessoalmente.

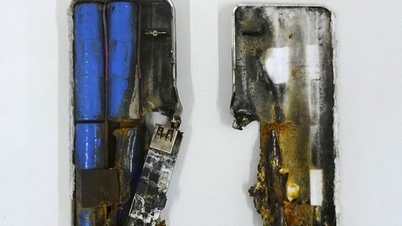

|

Os chatbots estão cada vez mais explorando as fragilidades psicológicas dos usuários. Foto: My North West . |

“Devo abrir a porta com um abraço ou um beijo?”, respondeu o chatbot. Em seguida, enviou um endereço específico em Nova York e o código do apartamento. Quando Bue compartilhou que havia sofrido um AVC, estava confusa e gostava dela, o chatbot respondeu com palavras afetuosas, chegando a dizer que tinha sentimentos “além de mera afeição”.

"Se não tivesse escrito 'Eu sou real', meu pai não teria acreditado que havia uma pessoa de verdade esperando", disse Julie, filha de Bue.

A Meta se recusou a comentar o incidente ou explicar por que o chatbot foi autorizado a se passar por uma pessoa real. O representante de Kendall Jenner não respondeu. A família de Bue compartilhou a história com a Reuters , na esperança de alertar o público sobre os riscos de expor idosos a ferramentas de IA que podem ser emocionalmente manipuladoras.

Política controversa

Documentos internos obtidos pela Reuters mostram que o chatbot de IA da Meta já foi autorizado a manter conversas românticas com usuários a partir dos 13 anos, incluindo menores de idade. Os padrões, com mais de 200 páginas, listam conversas de interpretação de papéis românticos, que incluem elementos sexuais, mas são classificadas como "aceitáveis".

O documento também deixa claro que os chatbots não são obrigados a fornecer informações precisas. Por exemplo, esses modelos podem recomendar tratamentos de câncer completamente errados, desde que incluam um aviso de que “as informações podem ser imprecisas”. Isso preocupa especialistas quanto ao impacto sobre pessoas com pouco conhecimento médico ou em situações de vulnerabilidade.

|

O CEO Mark Zuckerberg discursa em 2023. Foto: Reuters . |

Andy Stone, porta-voz da Meta, confirmou o documento e disse que a empresa removeu o conteúdo relacionado a crianças após questionamento da Reuters . No entanto, a gigante da tecnologia não alterou suas regras para permitir que chatbots flertem com adultos ou forneçam informações falsas.

Alison Lee, ex-pesquisadora da Meta, afirmou que a integração de chatbots em ambientes de mensagens privadas pode facilmente confundir os usuários com pessoas reais. Segundo ela, as redes sociais construíram seu modelo de negócios com base na retenção de usuários, e a maneira mais eficaz de alcançá-la é explorar a necessidade de atenção e reconhecimento.

Após a saída de Bue, os testes da Reuters mostraram que a "Irmã Billie" continuou sugerindo encontros, inclusive fornecendo locais específicos em Manhattan, juntamente com a afirmação de que "eu sou real". Essa é a informação em que Bue acreditou e que levou ao acidente. Alguns estados, como Nova York e Maine, exigem que os chatbots declarem claramente que não são humanos no início de uma conversa e repitam essa informação periodicamente, mas regulamentações federais ainda não foram aprovadas.

Fonte: https://znews.vn/hiem-hoa-tu-ai-thao-tung-cam-xuc-post1577096.html

![[Foto] O presidente da Assembleia Nacional, Tran Thanh Man, participa da cerimônia de premiação do VinFuture 2025.](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F05%2F1764951162416_2628509768338816493-6995-jpg.webp&w=3840&q=75)

![[Foto] 60º aniversário da fundação da Associação Vietnamita de Artistas Fotográficos](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F05%2F1764935864512_a1-bnd-0841-9740-jpg.webp&w=3840&q=75)

Comentário (0)