Продукти штучного інтелекту: расизм та упередження

Зображення, створені штучним інтелектом, на такі теми, як бідність, діти та жертви сексуального насильства, заполонили онлайн-фотоархіви, і неурядові організації (НУО) все частіше використовують їх, стверджують світові експерти у сфері охорони здоров'я . Експерти попереджають, що це може сигналізувати про «нову еру культури експлуатації бідності».

«Ці зображення відображають типове уявлення про бідність – діти тримають порожні миски, потріскана земля… дуже стереотипно», – сказав Арсеній Аленічев, дослідник Інституту тропічної медицини в Антверпені, який вивчає створення зображень глобального здоров’я .

Пан Аленічев зібрав понад 100 зображень крайньої бідності, створених за допомогою штучного інтелекту, які були використані окремими особами або неурядовими організаціями в кампаніях у соціальних мережах проти голоду та сексуального насильства.

Зображення, якими він поділився з Guardian, демонструють перебільшені, стереотипні сцени: діти, що туляться в калюжах бруду; африканська дівчина у весільній сукні, по обличчю якої течуть сльози. У нещодавньому коментарі, опублікованому в журналі Lancet Global Health, він стверджував, що ці зображення є «порнографією бідності версії 2.0».

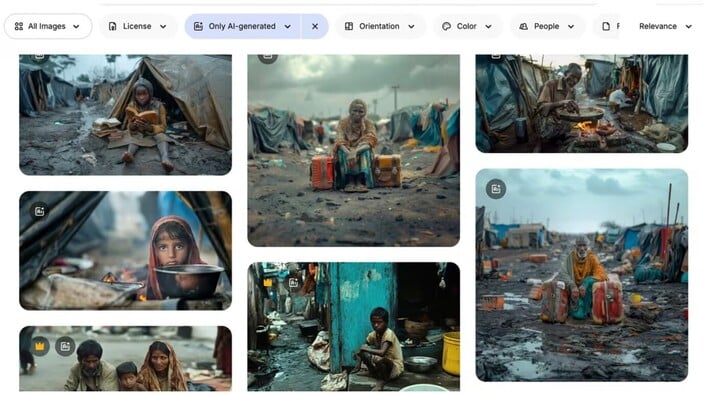

Знімок екрана, що показує зображення «бідності», згенероване штучним інтелектом, на фотосайті. (Фото: Freepik)

Пан Аленічев та багато інших експертів стверджують, що використання зображень зі штучним інтелектом зростає через побоювання щодо авторських прав та витрат. Скорочення бюджету уряду США для неурядових організацій погіршило проблему.

«Очевидно, що багато організацій починають розглядати можливість використання зображень зі штучним інтелектом замість реальних фотографій, оскільки це дешево. Також не потрібно турбуватися про авторські права та багато іншого», – сказав він.

Відповідальність лежить на користувачеві чи на платформі?

Зображення бідності, створені штучним інтелектом, з’являються на десятках фотосайтів, включаючи Adobe Stock Photos та Freepik. Багато з них мають підписи: «сюрреалістична дитина в таборі біженців»; «азійські діти купаються в річці, заповненій сміттям»; «білий волонтер надає медичні консультації темношкірим дітям в африканському селі»; тощо. Adobe продає права на два останні зображення у цьому списку приблизно за 60 фунтів стерлінгів.

«Ці фотографії є відверто расистськими і не повинні бути дозволені до публікації, тому що вони є найгіршими стереотипами про Африку, Індію чи будь-що, що ви тільки можете собі уявити», – сказав Аленічев.

Хоакін Абела, генеральний директор Freepik, заявив, що відповідальність за використання таких екстремальних зображень несуть користувачі, а не платформи, подібні до його. На його думку, фотографії зі штучним інтелектом створюються глобальною спільнотою користувачів, які можуть отримувати роялті, коли клієнти Freepik вирішують купити їхні фотографії.

Freepik спробував приборкати упередження, виявлені у його фотобібліотеках, шляхом «впровадження різноманітності». Водночас вони також намагаються забезпечити гендерний баланс на фотографіях юристів та керівників.

Але, за його словами, його платформа може лише певний обсяг. «Це як намагатися висушити океан. Ми пробували, але реальність така, що якщо клієнти з усього світу хочуть, щоб їхні зображення виглядали певним чином, ніхто абсолютно нічого не може з цим вдіяти».

Зображення, створене штучним інтелектом, з кампанії благодійної організації Plan International 2023 року проти дитячих шлюбів, яка має на меті захистити «приватність та гідність дівчат». (Фото: Plan International)

Багато престижних організацій, навіть Організація Об'єднаних Націй, використовували зображення, створені за допомогою штучного інтелекту.

Минулого року Організація Об'єднаних Націй опублікувала на YouTube відео з «реконструкціями» сексуального насильства, зокрема зі свідченнями бурундійської жінки, яка описує, як її зґвалтували та залишили помирати троє чоловіків у 1993 році. Контент був повністю створений штучним інтелектом. Відео було видалено після того, як газета Guardian звернулася до ООН за інтерв'ю.

Пізніше речник ООН пояснив, чому відео було видалено. «Ми вважаємо, що відео було неправильно згенеровано штучним інтелектом і може становити ризики для цілісності інформації, змішуючи реальні кадри зі штучним контентом, який виглядає як реальний».

Продукти, створені штучним інтелектом, давно визнані копіями, які іноді перебільшують правду. Пан Аленічев сказав, що поширення цих упереджених зображень може погіршити проблему, оскільки зображення можуть поширюватися по величезному інтернету та використовуватися для навчання наступного покоління штучного інтелекту.

Речник Plan International заявив, що неурядова організація наразі «рекомендує не використовувати штучний інтелект для зображення дітей».

Мінх Хоан

Джерело: https://vtcnews.vn/chuyen-gia-bao-dong-tinh-trang-ai-tao-anh-rap-khuon-phong-dai-ar972160.html

![[Фото] Голова Національних зборів Тран Тхань Ман відвідав церемонію нагородження VinFuture 2025](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F05%2F1764951162416_2628509768338816493-6995-jpg.webp&w=3840&q=75)

Коментар (0)