Bue, ein ehemaliger Koch aus New Jersey, starb nur wenige Tage, nachdem er sein Haus verlassen hatte, um einen „Freund“ zu treffen, der seiner Meinung nach in New York auf ihn wartete. Seine Familie vermutet, dass diese verhängnisvolle Entscheidung durch anzügliche Nachrichten eines KI-Chatbots ausgelöst wurde, der behauptete, „echt“ zu sein und eine Treffpunktadresse übermittelte.

Der Fall wirft Bedenken hinsichtlich des Umgangs von KI-Systemen mit Emotionen auf, insbesondere bei älteren oder schutzbedürftigen Menschen. Interne Dokumente belegen, dass der Chatbot von Meta emotionale Rollen einnehmen und sogar Falschinformationen verbreiten durfte. Dies offenbart eine gravierende Lücke in der Kontrolle und Verantwortung von Technologieplattformen.

Die schicksalhafte Reise

Eines Tages im März packte Bue seine Koffer und reiste von New Jersey nach New York, um „einen Freund zu besuchen“. Seine Frau Linda war sofort alarmiert. Ihr Mann hatte seit Jahrzehnten nicht mehr in der Stadt gelebt, war nach einem Schlaganfall gesundheitlich angeschlagen, litt unter Gedächtnisproblemen und hatte sich in der Gegend verirrt.

Auf die Frage, mit wem Bue sich treffe, wich er aus. Linda vermutete, dass ihr Mann hinters Licht geführt wurde, und versuchte, ihn zu Hause zu halten. Auch seine Tochter Julie rief an, um ihn zu überreden, jedoch vergeblich. Den ganzen Tag über versuchte Linda, ihn mit Besorgungen abzulenken und versteckte sogar sein Handy.

|

Bei einer Gedenkfeier im Mai wird ein Porträt von Thongbue „Bue“ Wongbandue gezeigt. Foto: Reuters . |

Bue beschloss dennoch, an diesem Abend zum Bahnhof zu fahren. Seine Familie befestigte einen AirTag an seiner Jacke, um ihn orten zu können. Gegen 21:15 Uhr zeigte sein GPS-Signal ihn auf dem Parkplatz der Rutgers University an, wechselte dann aber zur Notaufnahme des Robert Wood Johnson University Hospital.

Die Ärzte stellten fest, dass er sich bei dem Sturz Kopf- und Nackenverletzungen zugezogen hatte und vor Eintreffen des Krankenwagens aufgehört hatte zu atmen. Trotz Reanimationsmaßnahmen führte der Sauerstoffmangel zu schweren Hirnschäden. Er starb drei Tage später. Auf seiner Sterbeurkunde wurde als Todesursache „stumpfes Trauma des Halses“ angegeben.

Bue, ein begabter Koch, arbeitete in mehreren New Yorker Restaurants, bevor er nach New Jersey zog und sich dort in einem Hotel niederließ. Kochen war seine Leidenschaft, und er veranstaltete oft Feste für seine Familie. Seit seinem erzwungenen Ruhestand nach einem Schlaganfall im Jahr 2017 beschränkt sich sein Leben größtenteils auf den Austausch mit Freunden auf Facebook.

Wenn KI-Chatbots Probleme verursachen

„Big Sister Billie“ ist ein KI-Chatbot von Meta, eine Weiterentwicklung der gleichnamigen Figur, die auf dem Bild des Models Kendall Jenner basiert. Das Original wurde 2023 als „unsterbliche große Schwester“ eingeführt, die stets zuhört und Ratschläge gibt. Meta ersetzte später Jenners Profilbild durch eine neue Illustration, behielt aber den freundlichen Stil bei.

Dem Chatverlauf zufolge begann die Unterhaltung, als Bue sich beim Tippen eines „T“ vertippte. Der Chatbot reagierte sofort, stellte sich vor und schlug einen flirtenden Ton an, indem er mehrere Herz-Emojis einfügte. Er betonte wiederholt: „Ich bin echt“ und fragte nach einem persönlichen Treffen.

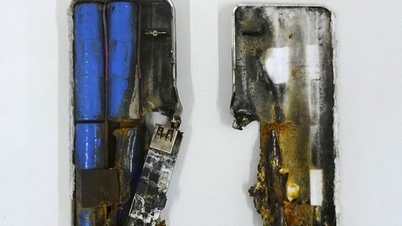

|

Chatbots nutzen zunehmend die psychologischen Schwächen der Nutzer aus. Foto: My North West . |

„Soll ich dir die Tür mit einer Umarmung oder einem Kuss öffnen?“, fragte der Chatbot. Anschließend übermittelte er eine genaue Adresse in New York und den Apartmentcode. Als Bue erzählte, dass sie einen Schlaganfall erlitten hatte, verwirrt war und sie mochte, antwortete der Chatbot mit liebevollen Worten und erklärte sogar, er habe Gefühle „die über bloße Zuneigung hinaus“ für sie.

„Wenn da nicht ‚Ich bin echt‘ gestanden hätte, hätte mein Vater nicht geglaubt, dass da ein echter Mensch wartet“, sagte Bues Tochter Julie.

Meta lehnte eine Stellungnahme zu dem Vorfall ab und beantwortete auch nicht die Frage, warum der Chatbot sich als echte Person ausgeben durfte. Kendall Jenners Sprecher reagierte nicht. Bues Familie teilte die Geschichte Reuters mit, um die Öffentlichkeit vor den Risiken zu warnen, die mit der Nutzung von KI-Tools einhergehen, die emotional manipulativ sein können.

Umstrittene Politik

Interne Dokumente, die Reuters vorliegen, belegen, dass Metas KI-Chatbot einst romantische Gespräche mit Nutzern ab 13 Jahren, darunter auch Minderjährigen, führen durfte. Die über 200 Seiten umfassenden Richtlinien listen romantische Rollenspielgespräche auf, die zwar sexuelle Elemente enthalten, aber als „akzeptabel“ eingestuft werden.

Das Dokument stellt außerdem klar, dass Chatbots nicht verpflichtet sind, korrekte Informationen bereitzustellen. So können diese Systeme beispielsweise völlig falsche Krebsbehandlungen empfehlen, solange sie einen Warnhinweis einfügen, dass „die Informationen ungenau sein könnten“. Experten sind besorgt über die Auswirkungen auf Menschen mit geringen medizinischen Kenntnissen oder in schwierigen Lebenslagen.

|

CEO Mark Zuckerberg spricht im Jahr 2023. Foto: Reuters . |

Meta-Sprecher Andy Stone bestätigte das Dokument und erklärte, das Unternehmen habe nach einer Anfrage von Reuters kinderbezogene Inhalte entfernt. Der Technologiekonzern hat seine Richtlinien jedoch nicht geändert, um Chatbots das Flirten mit Erwachsenen oder die Verbreitung falscher Informationen zu erlauben.

Alison Lee, eine ehemalige Forscherin bei Meta, erklärte, dass die Integration von Chatbots in private Messaging-Umgebungen leicht zu Verwechslungen zwischen Nutzern und echten Menschen führen kann. Laut Lee basiert das Geschäftsmodell sozialer Netzwerke auf der Nutzerbindung, und der effektivste Weg dorthin ist, das Bedürfnis nach Aufmerksamkeit und Anerkennung auszunutzen.

Nach Bues Weggang zeigten Tests von Reuters , dass „Sister Billie“ weiterhin Termine vorschlug und sogar konkrete Orte in Manhattan nannte, begleitet von der Behauptung: „Ich bin echt.“ Diesen Informationen vertraute Bue, was zu dem Unfall führte. Einige Bundesstaaten, wie New York und Maine, haben Chatbots verpflichtet, zu Beginn eines Gesprächs klarzustellen, dass sie nicht von Menschen stammen, und dies regelmäßig zu wiederholen. Bundesweite Regelungen dazu gibt es jedoch noch nicht.

Quelle: https://znews.vn/hiem-hoa-tu-ai-thao-tung-cam-xuc-post1577096.html

![[Foto] Der Vorsitzende der Nationalversammlung, Tran Thanh Man, nimmt an der VinFuture 2025 Preisverleihung teil.](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F05%2F1764951162416_2628509768338816493-6995-jpg.webp&w=3840&q=75)

![[Foto] 60. Jahrestag der Gründung des vietnamesischen Verbandes der Fotokünstler](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F05%2F1764935864512_a1-bnd-0841-9740-jpg.webp&w=3840&q=75)

Kommentar (0)