Es ist an der Zeit, dass jeder Nutzer zu einem "digitalen Schutzschild" wird und bei jedem Klick und jeder Weiterleitung wachsam, aufmerksam und verantwortungsbewusst handelt.

Die Vorteile und die Gratwanderung der KI

Nie zuvor war künstliche Intelligenz so nah am Alltag. Mit wenigen Klicks und kurzen Befehlen lassen sich Stimmen, Bilder und sogar Videos von verblüffendem Realismus erzeugen. KI spart Zeit, senkt die Produktionskosten und läutet eine Ära flexibler digitaler Medien ein.

Doch genau diese Fähigkeit, die Realität realistisch zu simulieren, hat sich als zweischneidiges Schwert erwiesen. In letzter Zeit kursieren in den sozialen Medien unzählige Videos, die mithilfe von Deepfake-Technologie erstellt wurden. Darin werden die Gesichter von Polizeiführern und Bilder von Polizeibeamten in heiklen Fällen manipuliert und verzerrt, untermalt mit Voiceovers, um die Öffentlichkeit irrezuführen und zu spalten.

Inszenierte Bilder wie diese werden in den sozialen Medien immer häufiger.

In einem viralen TikTok-Clip wurden Bilder eines Verkehrspolizisten im Dienst mit beleidigenden Dialogen kombiniert und mit dem Hashtag „Bußgelder nur zum Schein“ versehen. Dies implizierte, dass der Polizist seine Macht für persönliche Vorteile missbraucht habe. Viele Nutzer, insbesondere junge Menschen, glaubten diesen Inhalten sofort, da die Bilder so realistisch wirkten und die Stimme den Lippenbewegungen sehr ähnlich sah. Dadurch war es extrem schwierig, zwischen Realität und Fälschung zu unterscheiden.

Ein junger YouTuber aus Dien Bien musste nun eine Geldstrafe zahlen und sich öffentlich entschuldigen, nur weil er seine KI-Kenntnisse zur Schau stellen wollte. Am Nachmittag des 24. Januar gab die Provinzpolizei von Dien Bien bekannt, dass die Abteilung für Cybersicherheit und Bekämpfung von Hightech-Kriminalität gegen Tong Van T. (geb. 2001, wohnhaft im Bezirk Muong Ang) eine Geldstrafe in Höhe von 7,5 Millionen VND verhängt hat. Ihm war vorgeworfen worden, mithilfe von KI ein gefälschtes Video erstellt zu haben, das Verkehrspolizisten verunglimpfte und beleidigte.

Konkret lud T. am 7. Januar ein über dreiminütiges Video mit dem schockierenden Titel „Ich wurde unterwegs von der Verkehrspolizei verfolgt“ auf ihren YouTube-Kanal „Tuyen Vlog“ hoch. Die Bilder und Situationen in dem Clip wurden mithilfe von KI-Technologie inszeniert, um die Verfolgung von Bürgern durch die Verkehrspolizei zu simulieren. Sie wurden mit Effekten und Kommentaren kombiniert, die beleidigend und verleumderisch gegenüber den Strafverfolgungsbehörden waren.

In Zusammenarbeit mit der Polizei gab T. zu, dass der gesamte Inhalt des Videos eine Fälschung war, die zu Unterhaltungszwecken und zur Demonstration seiner KI-Kenntnisse erstellt worden war. Zusätzlich zur Geldstrafe ordneten die Behörden an, dass T. das gefälschte Video entfernen und sich auf seinem persönlichen YouTube-Kanal öffentlich bei der Verkehrspolizei entschuldigen muss.

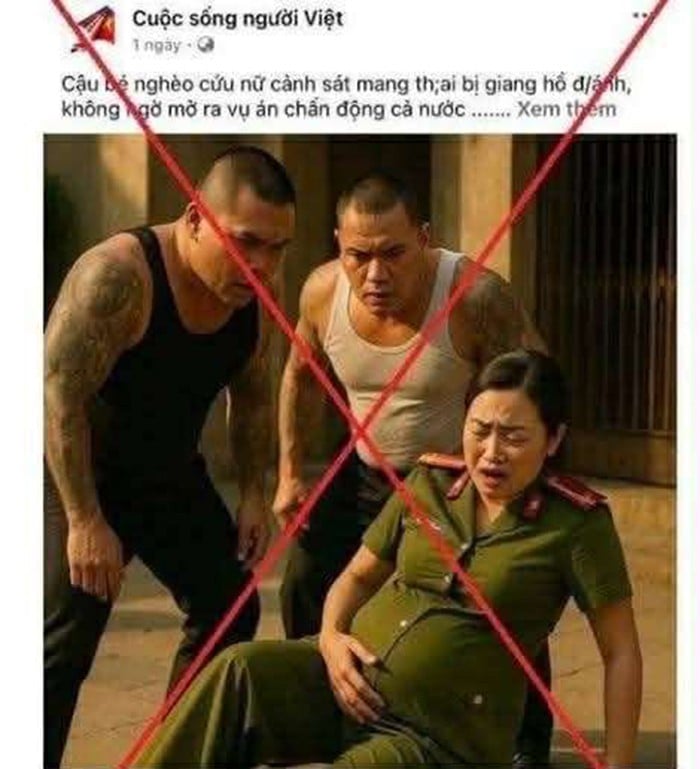

Im Zeitalter der digitalen Revolution , insbesondere der rasanten Entwicklung künstlicher Intelligenz, haben feindselige und reaktionäre Kräfte nicht gezögert, dieses Werkzeug zu nutzen, um gefälschte Bilder und Geschichten zu verbreiten, die darauf abzielen, das Ansehen der vietnamesischen Volkspolizei zu verzerren und zu schädigen. Ein kürzlich in den sozialen Medien kursierendes Foto, das eine schwangere Frau in Polizeiuniform zeigt, die von zwei Männern mit „Gangster“-Aussehen bedroht wird, ist ein deutlicher Beweis für diese Taktik.

Das mithilfe von KI erstellte Bild ging kürzlich in den sozialen Medien viral.

Auf den ersten Blick könnte man dies leicht für eine reale Szene halten, begleitet von reißerischen Schlagzeilen wie: „Armer Junge rettet schwangere Polizistin vor Gangstern und deckt dabei unwissentlich einen Fall auf, der die ganze Nation schockiert …“. Tatsächlich handelt es sich jedoch nur um eine gestellte Szene, möglicherweise aus einem Film oder einer Unterhaltungsproduktion, oder schlimmer noch, um ein KI-generiertes Bild, das die Gefühle des Betrachters manipulieren und Mitleid erwecken sowie Zweifel an der Glaubwürdigkeit der Polizei säen soll.

Noch besorgniserregender ist, dass die Verbreitung solcher Inhalte nicht nur dem Ansehen der Volkspolizei schadet, die Tag und Nacht für die Sicherheit und Ordnung der Gesellschaft sorgt, sondern auch eine raffinierte Form der psychologischen Kriegsführung darstellt. Wenn das Vertrauen der Bevölkerung in die Behörden durch irreführende Bilder untergraben wird, können die eigennützigen Ziele feindlicher Kräfte, die nationale Einheit zu spalten, allmählich verwirklicht werden.

Deshalb muss jeder Bürger seine Wachsamkeit erhöhen, kritisches Denkvermögen entwickeln und die Fähigkeit erwerben, Falschinformationen zu erkennen, um falsche Inhalte entschieden anzuprangern und zu widerlegen. Dies trägt dazu bei, die ideologischen Grundlagen zu schützen und die soziale Stabilität angesichts der aktuellen Welle schädlicher Informationen im Internet aufrechtzuerhalten.

In Ho-Chi-Minh-Stadt ging ein knapp einminütiges Video in den sozialen Medien viral, das zeigt, wie eine Person in Polizeiuniform einen Verdächtigen in einem Büro zu einem Geständnis wegen eines Verkehrsverstoßes nötigt. In dem Video zeigt die Person, bei der es sich mutmaßlich um einen Polizisten handelt, ein aggressives Verhalten, schreit ständig und verwendet sogar beleidigende Ausdrücke, was in der Öffentlichkeit Empörung auslöste.

Kurz nachdem der Clip viral ging, leitete die Polizei von Ho-Chi-Minh-Stadt umgehend Ermittlungen ein und bestätigte, dass es sich um einen raffinierten Deepfake handelte. Laut ihren Erkenntnissen stammten die Gesichter im Video aus der Aufzeichnung einer internen Polizeikonferenz und wurden anschließend von Unbekannten mithilfe von KI-Technologie manipuliert, um sie in eine inszenierte Szene einzufügen. Dadurch wurde den Zuschauern der Eindruck vermittelt, es handele sich um ein reales Ereignis.

Insbesondere enthält der dazugehörige Ton bedrohliche und beleidigende Stimmen, die nicht die tatsächlichen Worte von Beamten sind, sondern synthetische KI-Stimmen, die so programmiert und bearbeitet wurden, dass sie die Gefühle des Zuschauers täuschen.

Dieser Vorfall ist ein Paradebeispiel für den Einsatz von Deepfake-Technologie zur Verunglimpfung und Diffamierung der Volkspolizei – eine Taktik, die von reaktionären und subversiven Kräften im Internet zunehmend angewendet wird. Werden solche Fälschungen nicht umgehend aufgedeckt, können sie schwerwiegende Folgen haben: Sie untergraben das Vertrauen der Öffentlichkeit in die Strafverfolgungsbehörden, schüren Widerstand in der Bevölkerung und begünstigen die Verbreitung falscher Narrative. Dies verdeutlicht die dringende Notwendigkeit, die Kommunikationsfähigkeit zu verbessern, um Falschnachrichten zu widerlegen, aufzudecken und zu bekämpfen. Jeder Bürger ist aufgerufen, wachsam zu sein und unbestätigte Inhalte offizieller Quellen nicht vorschnell zu teilen oder zu kommentieren.

In einem weiteren aktuellen Fall, der die Aufdeckung von Unregelmäßigkeiten in einem Fahrzeugprüfzentrum im Süden betraf, verbreiteten feindselige Kreise ein gefälschtes Video, in dem ein Provinzpolizeichef die korrupten Beamten verteidigte. Dieser Clip, der unter dem Titel „Unterstützt von mächtigen Kräften“ auf Telegram und in sozialen Medien kursierte, war tatsächlich ein Produkt von KI und tauchte weder in Pressekonferenzen noch in offiziellen Dokumenten auf.

Ein gefährlicher Trend breitet sich unbemerkt im Internet aus: Betrüger nutzen KI-Technologie, um gefälschte Videos zu erstellen und damit Betrug und Erpressung zu begehen. In letzter Zeit sind viele Menschen Opfer geworden, als ihre Bilder, insbesondere die von angesehenen Persönlichkeiten wie Anwälten, Ärzten und Geschäftsleuten, in Videos eingefügt wurden, die mit der „Rückgewinnung von Geldern aus Online-Betrugsfällen“ warben.

In diesen Videos wird KI eingesetzt, um Stimme und Gesicht von Anwälten zu imitieren. So werden Zuschauer getäuscht und geben bereitwillig persönliche Daten preis oder überweisen Geld. Noch gefährlicher ist, dass manche Täter Deepfake-Technologie nutzen, um die Gesichter ihrer Opfer in Sexvideos einzufügen und diese dann an Ehepartner oder Kollegen zu senden. Ziel ist es, diese zu bedrohen oder zu nötigen, Geld zu überweisen, damit sie schweigen.

Im März 2025 ereignete sich ein schockierender Vorfall in Hanoi: Eine Frau wurde aufgefordert, mehrere zehn Millionen Dong zu überweisen, nachdem ihr ein gefälschtes Sexvideo zugespielt worden war. In Ho-Chi-Minh-Stadt wurde eine andere Person erpresst und um zwei Milliarden Dong erpresst, falls sie die Verbreitung des brisanten Videos verhindern wollte. Das Ministerium für Öffentliche Sicherheit leitete Ermittlungen ein und identifizierte mehrere transnationale kriminelle Gruppen, hauptsächlich aus China und Südostasien, die hinter diesen Netzwerken stehen und Einweg-SIM-Karten, E-Wallets und soziale Medien nutzen, um ihre Identität zu verschleiern.

Dies ist längst kein einfacher Betrug mehr, sondern eine Form der „psychologischen Kriegsführung mit modernster Technologie“, die die Angst vor Ehrverlust und sozialen Problemen gezielt ausnutzt, um Opfer unter Druck zu setzen. Ohne erhöhte Wachsamkeit und die Fähigkeit, ungewöhnliche Informationen und Verhaltensweisen zu erkennen, kann jeder diesen technisch hochentwickelten Kriminellen zum Opfer fallen. Angesichts dieser raffinierten Welle von Identitätsdiebstählen muss jeder Bürger wachsam sein, persönliche Informationen keinesfalls leichtfertig weitergeben und bereit sein, gegen illegale Aktivitäten vorzugehen, um so zum Schutz der eigenen Sicherheit und der Sicherheit der Gemeinschaft beizutragen.

Um der Bedrohung durch Deepfakes entgegenzuwirken, ist ein „digitaler Schutzschild“ der Gemeinschaft erforderlich.

Laut dem Ministerium für Kultur, Sport und Tourismus (Abteilung für Rundfunk, Fernsehen und elektronische Information) mussten digitale Plattformen in Vietnam im Jahr 2024 über 4.000 Videos mit falschen und verzerrten Informationen entfernen. Die meisten dieser Videos waren mithilfe von KI-Technologien wie Deepfakes und Stimmklonen erstellt worden. Allein TikTok – eine bei jungen Menschen beliebte Plattform – wurde aufgefordert, über 1.300 Deepfake-Clips zu löschen, die sich hauptsächlich auf Polizei, Regierung und Sozialpolitik bezogen.

Im Zeitalter des Technologiebooms birgt künstliche Intelligenz bahnbrechendes Potenzial, aber auch beispiellose Gefahren. Besonders Deepfake-Produkte mit verzerrten Inhalten greifen den Ruf von Regierungsbehörden an. Eine Studie des MICRI Media Research Institute zeigt, dass 62 % der Social-Media-Nutzer in Vietnam ohne Warnungen von etablierten Medien oder Behörden nicht zwischen echten und gefälschten Informationen unterscheiden können. Diese „kognitive Lücke“ wird von kriminellen Kräften gezielt ausgenutzt, um Desinformation zu verbreiten und die soziale Psychologie zu manipulieren.

Tong Van T. auf der Polizeiwache.

Laut Generalmajor, außerordentlicher Professor und Doktor Do Canh Thin, einem Kriminologen, ist der Einsatz von KI zur Erstellung gefälschter Videos, die Führungskräfte imitieren, falsche Aussagen verbreiten oder das professionelle Handeln der Polizei verzerren, eine neue, aber besonders gefährliche Taktik. „Deepfake ist nicht einfach nur ein Unterhaltungsprodukt, sondern eine Form moderner Informationskriegsführung, die Vertrauen untergraben, soziale Instabilität verursachen und sehr schwer zu kontrollieren ist“, erklärte Generalmajor Do Canh Thin.

Tatsächlich sind KI-manipulierte Videos alles andere als harmlos; sie thematisieren häufig sensible Themen wie den Umgang mit Verstößen, die Aufklärung von Straftaten und die Bekämpfung von Korruption und führen so zu Verwirrung und Misstrauen in der Öffentlichkeit gegenüber den Strafverfolgungsbehörden. Noch besorgniserregender ist, dass viele dieser Videos auf großen Plattformen wie YouTube und TikTok geteilt werden und Hunderttausende von Aufrufen erzielen, bevor sie gelöscht werden, was einen negativen Dominoeffekt auslöst.

Der Digitalmedienexperte Hoang Minh warnt: „Ein einziges unbedachtes Teilen oder Liken kann einen zum Komplizen von Fake News machen. Jeder Internetnutzer muss verstehen, dass Handlungen im digitalen Raum auch reale Konsequenzen haben.“

In diesem Kontext ist es wichtiger denn je, einen „digitalen Schutzschild“ aus der Gemeinschaft selbst heraus zu errichten: Wachsamkeit, Informationsunempfindlichkeit und ein Verantwortungsbewusstsein gegenüber der Online-Umgebung. Technologie mag neutral sein, doch die Art und Weise ihrer Nutzung entscheidet darüber, ob KI zu einer treibenden Kraft für Entwicklung oder zu einer zerstörerischen Kraft für das gesellschaftliche Vertrauen wird. Die Wahrung ideologischer Standhaftigkeit und das Ansehen der Polizei schützen die Grundlage der nationalen Sicherheit – eine Aufgabe nicht nur für die zuständigen Behörden, sondern für jeden Bürger im digitalen Zeitalter.

Quelle: https://baolangson.vn/tinh-hai-mat-cua-ai-5050403.html

![[Foto] Premierminister Pham Minh Chinh reist zu einem offiziellen Besuch in die Russische Föderation.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/03/22/1774160262864_vna-potal-thu-tuong-pham-minh-chinh-len-duong-tham-chinh-thuc-lien-bang-nga-8656056-6903-jpg.webp)

![[Bild] 126 Gemeinden und Stadtteile von Hanoi nehmen am Olympischen Lauftag 2026 teil.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/03/22/1774155767210_ndo_br_4013885316804510786-copy-jpg.webp)

![[Foto] Generalsekretär To Lam nimmt an der Zeremonie zum 80. Jahrestag der Gründung des Ingenieurkorps teil.](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2026/03/22/1774154480574_anh-man-hinh-2026-03-22-luc-11-41-07.png)

Kommentar (0)