محققان DeepSeek از یک مدل آزمایشی جدید به نام V3.2-exp رونمایی کردهاند که برای کاهش قابل توجه هزینه استنتاج در عملیاتهای طولانی مدت طراحی شده است.

دیپسیک این مدل را در پستی در Hugging Face معرفی کرد و همچنین یک مقاله دانشگاهی مرتبط را در گیتهاب منتشر کرد.

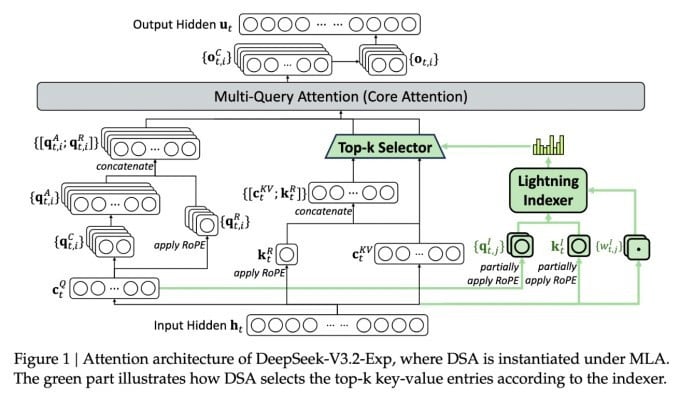

مهمترین ویژگی این مدل جدید و پیچیده، DeepSeek Sparse Attention نام دارد. اساساً، این سیستم از ماژولی به نام «شاخصساز رعد و برق» برای اولویتبندی گزیدههای خاص از پنجره متن استفاده میکند.

DeepSeek مدل استنتاج مقرون به صرفهای را معرفی میکند.

سپس یک سیستم جداگانه به نام «سیستم انتخاب توکن ریزدانه» توکنهای خاصی را از آن قطعه کدها انتخاب میکند تا در پنجره توجه محدود ماژول بارگذاری شود. ترکیب این دو، به مدلهای توجه پراکنده اجازه میدهد تا روی بخشهای طولانی از متن با بار سرور نسبتاً کم عمل کنند.

برای عملیاتهای با زمینه طولانی، مزایای سیستم قابل توجه است. آزمایشهای اولیه DeepSeek نشان میدهد که هزینه یک فراخوانی تابع استنتاج ساده (API) در سناریوهای با زمینه طولانی میتواند تا نصف کاهش یابد.

برای ایجاد یک ارزیابی قویتر، آزمایشهای بیشتری لازم است، اما از آنجایی که این مدل متنباز است و به صورت رایگان در Hugging Face در دسترس است، نباید مدت زیادی طول بکشد تا آزمایشهای شخص ثالث بتوانند ادعاهای موجود در مقاله را ارزیابی کنند.

برخلاف سایر مدلهای چتبات هوش مصنوعی که انرژی زیادی مصرف میکنند، DeepSeek در جهت صرفهجویی در هزینهها از آموزش تا بهرهبرداری گام برمیدارد.

مدل جدید DeepSeek یکی از مجموعهای از پیشرفتهای اخیر است که مشکل هزینه استنتاج - اساساً هزینه سرور برای اجرای یک مدل هوش مصنوعی از پیش آموزش دیده، در مقایسه با هزینه آموزش آن - را برطرف میکند.

در مورد DeepSeek، محققان به دنبال راههایی برای افزایش کارایی معماری ترانسفورماتور پایه بودند و دریافتند که باید پیشرفتهای قابل توجهی در آن ایجاد شود.

شرکت DeepSeek که در چین مستقر است، چهرهای غیرمعمول در دنیای هوش مصنوعی است، به خصوص برای کسانی که تحقیقات هوش مصنوعی را رقابتی بین ایالات متحده و چین میدانند. این شرکت اوایل امسال با مدل R1 خود که عمدتاً با استفاده از یادگیری تقویتی و با هزینهای بسیار کمتر از رقبای آمریکایی خود آموزش دیده بود، سر و صدای زیادی به پا کرد.

با این حال، این مدل نتوانست آن انقلاب تمامعیاری را که برخی پیشبینی میکردند در آموزش هوش مصنوعی ایجاد کند و این شرکت در ماههای بعد به آرامی از کانون توجهات عقبنشینی کرد.

بعید است که رویکرد جدید «توجه پراکنده» به اندازه R1 خشم عمومی را برانگیزد - اما همچنان میتواند به ارائهدهندگان خدمات آمریکایی ترفندهای بسیار ضروری را برای کمک به پایین نگه داشتن هزینههای استنتاج بیاموزد.

https://techcrunch.com/2025/09/29/deepseek-releases-sparse-attention-model-that-cuts-api-costs-in-half/

منبع: https://khoahocdoisong.vn/deepseek-dao-tao-da-re-nay-con-co-ban-suy-luan-re-hon-post2149057353.html

![[عکس] دبیرکل تو لام و رئیس مجلس ملی تران تان من در هشتادمین سالگرد روز سنتی بخش بازرسی ویتنام شرکت کردند](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/17/1763356362984_a2-bnd-7940-3561-jpg.webp)

نظر (0)