Dziadek Synowska pobożność Zgadzam się z podejściem rządu do tworzenia tej ustawy. Projekt ustawy jasno definiuje również podejście Wietnamu do sztucznej inteligencji. Jest on zarówno przyjazny dla rozwoju sztucznej inteligencji, jak i zawiera regulacje mające na celu minimalizację ryzyka, jakie może ona ze sobą nieść.

W swoim przemówieniu pan Hieu skupił się na dalszej analizie zapisów artykułu 20 projektu ustawy o mechanizmie kontrolowanych testów, aby zapewnić wykonalność i stworzyć najkorzystniejsze warunki do rozwoju systemów sztucznej inteligencji, zwłaszcza krajowych systemów sztucznej inteligencji.

Według pana Hieu, mechanizm kontrolowanego testowania rozwoju sztucznej inteligencji jest niezwykle ważny. Ponieważ sztuczna inteligencja jest zagadnieniem bardzo nowym, związanym z wieloma różnymi dziedzinami, nawet jeśli opiera się jedynie na obecnych ramach prawnych, nie może stworzyć warunków dla rozwoju AI. Głównym celem mechanizmu kontrolowanego testowania AI jest usunięcie barier prawnych, które utrudniają rozwój modeli AI, umożliwiając testowanie w ograniczonym zakresie w celu uzyskania danych potwierdzających skuteczność, a tym samym promując długoterminową reformę regulacyjną. Ta metoda jest również bardzo zgodna z naszym obecnym tokiem myślenia legislacyjnego, zgodnie z którym instytucja musi najpierw utorować drogę rozwojowi; to, co znane, jest zarządzane, to, co nieznane i niejasne, nie jest zarządzane. Dlatego przepisy dotyczące mechanizmu kontrolowanego testowania muszą stanowić główny punkt ram prawnych dotyczących sztucznej inteligencji. W związku z tym agencja projektująca musi zbadać i uregulować tę kwestię bardziej szczegółowo w projekcie.

Odnosząc się do konkretnych uwag, pan Hieu zasugerował przegląd przepisów dotyczących organizacji i osób uczestniczących w kontrolowanych badaniach klinicznych, które są zwolnione z obowiązku przestrzegania przepisów lub których obowiązki w zakresie zgodności są ograniczone, zgodnie z zapisami niniejszej ustawy w klauzuli 2 artykułu 20. Takie przepisy prowadzą do ograniczenia zakresu zwolnienia do przepisów niniejszej ustawy, podczas gdy systemy sztucznej inteligencji są często ściśle powiązane z innymi stosownymi przepisami prawnymi.

„Testowanie sztucznej inteligencji w pojazdach autonomicznych będzie ściśle powiązane z zakazami zawartymi w ustawie o bezpieczeństwie ruchu drogowego i ustawie o ochronie danych osobowych. Na przykład mechanizm testowania sztucznej inteligencji w autonomicznych samolotach pasażerskich w Japonii jest zwolniony z niektórych przepisów lotniczych. Podobnie testowanie samochodów autonomicznych w Chinach i Japonii jest zwolnione z przepisów ustawy o ochronie danych osobowych, która nakazuje wykorzystywanie danych obrazowych, które nie zamazują twarzy uczestników ruchu, do szkolenia i doskonalenia widzenia sztucznej inteligencji” – pan Hieu podał przykład i zasugerował, aby agencja projektowa zbadała i zrewidowała przepisy zawarte w artykule 20, klauzuli 2, w celu jasnego zdefiniowania organizacji i osób uczestniczących w kontrolowanych testach, które są zwolnione z obowiązku ich stosowania . lub złagodzić niektóre obowiązki wynikające z niniejszej Ustawy i innych stosownych przepisów.

W sprawie rozporządzenia o powierzeniu państwowej agencji zarządzania sztuczną inteligencją organizacji przyjmowania, oceny i przetwarzania akt w celu uczestnictwa w kontrolowanych działaniach testowych zgodnie z procesem oceny i szybkiej reakcji , Pan Hieu Zgadzam się z tym rozporządzeniem, zwłaszcza z przepisem dotyczącym szybkiej oceny i reakcji. Jednakże Systemy AI to nie tylko kwestia technologii i algorytmów, ale także kwestia multidyscyplinarna i interdyscyplinarna. Dlatego też postanowienia zawarte w punkcie 5 prawdopodobnie dotyczą jedynie systemów AI ogólnego przeznaczenia, takich jak AI generatywne, takie jak ChatGPT i Gemini. W przypadku wyspecjalizowanych systemów AI, interdyscyplinarność jest bardzo wysoka.

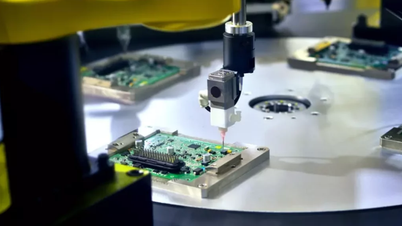

Dziadek Synowska pobożność Przykładowo system DrAid to produkt oparty na sztucznej inteligencji (AI) wspomagający diagnostykę obrazową w medycynie , opracowany przez firmę VinBrain . W przypadku rejestracji do testów, Ministerstwo Zdrowia nie może uchylić się od roli nadzoru i zarządzania. Dlatego w niektórych krajach ocena i licencjonowanie kontrolowanych testów systemów AI jest powierzone radzie interdyscyplinarnej. W związku z tym zaleca się zmianę przepisów w punkcie 5, zgodnie z którym „Państwowa agencja zarządzania sztuczną inteligencją przewodniczy i koordynuje działania z właściwymi państwowymi agencjami zarządzania w celu organizacji przyjmowania, oceny i przetwarzania dokumentacji dotyczącej udziału w kontrolowanych testach”.

Dziadek Hieu skomentował również: W przepisach art. 20 nadal brakuje przepisów dotyczących odszkodowań i odpowiedzialności ubezpieczeniowej. W związku z tym obecne przepisy projektu ustawy Nie wspomina się, kto ponosi odpowiedzialność, jeśli test spowoduje szkodę osobie trzeciej. Co do zasady, organizacja lub osoba przeprowadzająca test będzie zobowiązana do zapłaty odszkodowania cywilnego w przypadku wyrządzenia szkody. Dlatego zaleca się rozważenie dodania tego zapisu do projektu.

„ Ponadto, aby ułatwić i pobudzić ducha innowacyjności, uważamy, że konieczne jest również zbadanie i uzupełnienie mechanizmów wsparcia dla organizacji i osób biorących udział w testach, aby zapobiegać ryzyku . Na przykład mechanizm wsparcia ubezpieczenia od odpowiedzialności cywilnej przed przeprowadzeniem testów lub państwo może wesprzeć część budżetu (za pośrednictwem różnych funduszy) w celu zachęcenia do udziału w testach. Bez tego mechanizmu politycznego firmy opracowujące ryzykowne systemy sztucznej inteligencji (takie jak samochody autonomiczne) i będące w fazie rozruchu będą niechętne do testowania, ponieważ jeden wypadek wystarczy, aby doprowadzić do bankructwa ” – powiedział pan Hieu.

Source: https://daidoanket.vn/de-xuat-bo-sung-co-che-ho-tro-cho-cac-to-chuc-ca-nhan-tham-gia-thu-nghiem-ai.html

![[Zdjęcie] Prezydent Luong Cuong bierze udział w obchodach 50. rocznicy Święta Narodowego Laosu](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F11%2F27%2F1764225638930_ndo_br_1-jpg.webp&w=3840&q=75)

![[Zdjęcie] Premier Pham Minh Chinh przewodniczy 15. spotkaniu Centralnej Rady ds. Emulacji i Nagród](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F11%2F27%2F1764245150205_dsc-1922-jpg.webp&w=3840&q=75)

Komentarz (0)