Zbuduj dedykowaną infrastrukturę AI bezpośrednio w centrum danych.

W miarę jak rządy i duże organizacje dążą do rozbudowy projektów związanych ze sztuczną inteligencją (AI), wiele z nich zaczęło przechodzić na koncepcję „fabryk AI”, aby sprostać konkretnym potrzebom dotyczącym suwerenności danych i zgodności z przepisami.

Jednak stworzenie wydajnej fabryki AI wymaga kompleksowego systemu obejmującego procesy zarządzania, bazy danych, przechowywanie danych i bezpieczeństwo, o złożoności, której niewielu klientów jest gotowych się podjąć.

Organizacje z sektorów silnie regulowanych oraz sektora publicznego stoją przed poważnymi wyzwaniami związanymi z infrastrukturą AI podczas wdrażania projektów na dużą skalę. Budowanie własnych możliwości w zakresie AI wymaga ogromnych inwestycji w procesory graficzne (GPU), centra danych i energię, a także poruszania się po złożonych procesach zakupowych, doboru odpowiedniego modelu do każdego przypadku użycia oraz licencjonowania wielu dostawców AI.

Wszystkie te czynniki sprawiają, że proces wdrażania ciągnie się latami, zwiększa złożoność operacyjną i odciąga organizacje od ich podstawowych celów biznesowych.

Aby sprostać temu wyzwaniu, 11 grudnia AWS uruchomiło AWS AI Factories, nową usługę zapewniającą firmom i instytucjom rządowym dedykowaną infrastrukturę AI, zlokalizowaną bezpośrednio w centrum danych klienta i obsługiwaną wyłącznie na jego potrzeby.

Rozwiązanie AWS AI Factories integruje zaawansowane narzędzia przyspieszające sztuczną inteligencję (AI), od najnowocześniejszej technologii obliczeniowej NVIDIA AI po układy Trainium, w połączeniu z możliwościami pracy w sieci o dużej prędkości i niskich opóźnieniach, wydajnymi systemami pamięci masowej i bazami danych, kompleksowym systemem bezpieczeństwa, energooszczędną infrastrukturą i wydajnymi usługami AWS AI, takimi jak Amazon Bedrock i SageMaker AI.

Dzięki temu klienci mogą szybko opracowywać i wdrażać aplikacje AI na dużą skalę, optymalizując wydajność i spełniając konkretne potrzeby biznesowe.

Fabryki AWS AI działają jako oddzielne regiony AWS, zapewniając bezpieczny i bezzwłoczny dostęp do zasobów obliczeniowych, pamięci masowej, baz danych i usług AI. Takie podejście wykorzystuje dostępną przestrzeń i moc centrów danych, jednocześnie otwierając dostęp do pełnej infrastruktury i usług AI AWS, od najnowocześniejszych układów AI do szkolenia i wnioskowania, po narzędzia do tworzenia, szkolenia i wdrażania modeli AI.

Ponadto usługi zarządzane zapewniają dostęp do wiodących modeli bazowych bez konieczności zawierania osobnych umów z poszczególnymi dostawcami, pomagając jednocześnie klientom w pełni spełnić wymagania dotyczące bezpieczeństwa, suwerenności danych i zgodności z przepisami dotyczącymi miejsca przetwarzania i przechowywania danych.

Mając prawie dwie dekady doświadczenia w dziedzinie przetwarzania w chmurze i bogate doświadczenie w projektowaniu rozbudowanych systemów AI, AWS może wdrażać bezpieczną i niezawodną infrastrukturę AI znacznie szybciej, niż większość organizacji byłaby w stanie zbudować ją samodzielnie, oszczędzając lata pracy i znacząco redukując złożoność operacyjną.

15-letnie partnerstwo między AWS i NVIDIA

Relacja między AWS a NVIDIA rozpoczęła się 15 lat temu, kiedy AWS uruchomił pierwszą na świecie chmurę GPU. Od tego czasu AWS oferuje klientom najszersze portfolio rozwiązań GPU.

Bazując na długoletniej współpracy w zakresie dostarczania zaawansowanej infrastruktury AI, AWS i NVIDIA pomagają klientom tworzyć i uruchamiać modele językowe na dużą skalę szybciej, wydajniej i bezpieczniej niż gdziekolwiek indziej, bezpośrednio w ich własnych centrach danych.

Dzięki integracji NVIDIA-AWS AI Factories klienci AWS zyskują bezproblemowy dostęp do przyspieszonej platformy obliczeniowej firmy NVIDIA, wszechstronnego pakietu oprogramowania AI i tysięcy aplikacji przyspieszanych przez GPU, co zapewnia doskonałą wydajność, wysoką efektywność i elastyczną skalowalność w celu opracowywania rozwiązań AI nowej generacji.

Obie strony nadal łączą najnowocześniejsze technologie: AWS Nitro System, sieć Elastic Fabric Adapter (EFA) o przepustowości petabitowej oraz klastry Amazon EC2 UltraClusters obsługujące najnowsze platformy NVIDIA Grace Blackwell i NVIDIA Vera Rubin nowej generacji.

W przyszłości AWS doda obsługę technologii szybkiej łączności NVIDIA NVLink Fusion do układów Trainium4 i Graviton nowej generacji, a także do systemów Nitro. Ta integracja pomoże klientom skrócić czas wprowadzania produktów na rynek, jednocześnie osiągając wyższą wydajność.

Ian Buck, wiceprezes i dyrektor generalny ds. obliczeń hiperskalowych i HPC w firmie NVIDIA, dodał: „Sztuczna inteligencja na dużą skalę wymaga holistycznego podejścia, od zaawansowanych procesorów graficznych i infrastruktury sieciowej po oprogramowanie i usługi optymalizujące każdą warstwę centrum danych. Współpracując z AWS, wprowadzamy wszystkie te elementy bezpośrednio do środowisk naszych klientów”.

„Łącząc najnowsze architektury Grace Blackwell i Vera Rubin firmy NVIDIA z bezpieczną, wydajną infrastrukturą AWS i kompleksowym pakietem oprogramowania AI, AWS AI Factories pomaga organizacjom wdrażać zaawansowane możliwości AI w ułamku czasu, jednocześnie skupiając się całkowicie na innowacjach, zamiast martwić się o integrację” — powiedział Ian Buck.

Wspieranie sektora publicznego w celu przyspieszenia wdrażania sztucznej inteligencji.

Rozwiązania AWS AI Factories zostały zaprojektowane tak, aby spełniać najsurowsze standardy bezpieczeństwa AWS, zapewniając klientom z sektora rządowego pełną pewność podczas uruchamiania poufnych obciążeń na wszystkich poziomach klasyfikacji: niesklasyfikowane, poufne, tajne i ściśle tajne.

Jednocześnie AWS AI Factories zapewnia rządom na całym świecie gotowość, niezawodność, bezpieczeństwo i kontrolę niezbędne do napędzania wzrostu gospodarczego i maksymalizacji korzyści płynących z technologii AI.

AWS i NVIDIA nawiązują strategiczne partnerstwo z HUMAIN, globalną firmą z siedzibą w Arabii Saudyjskiej, specjalizującą się w rozwijaniu kompleksowych możliwości w zakresie sztucznej inteligencji.

W ramach tej współpracy AWS zbuduje w Arabii Saudyjskiej pierwszą pionierską „Strefę AI”, w której znajdzie się nawet 150 000 układów AI, w tym procesory graficzne GB300, dedykowana infrastruktura AI AWS i usługi AI AWS, wdrożone w specjalnie zaprojektowanym centrum danych przez HUMAIN.

Tareq Amin, dyrektor generalny HUMAIN, dodał: „Fabryka sztucznej inteligencji, którą AWS buduje w naszej nowej Strefie AI, oznacza początek wielogigawatowej podróży dla HUMAIN i AWS. Od samego początku ta infrastruktura została zaprojektowana z myślą o zaspokajaniu rosnących potrzeb obliczeniowych AI zarówno lokalnie, jak i globalnie”.

„Dzięki naszemu wspólnemu zaangażowaniu w ekspansję na rynki globalne tworzymy ekosystem, który ukształtuje przyszłość tego, w jaki sposób pomysły związane ze sztuczną inteligencją będą tworzone, wdrażane i skalowane na całym świecie” – dodał Tareq Amin.

Source: https://nhandan.vn/nha-may-tri-tue-nhan-tao-aws-nang-cao-hieu-nang-ha-tang-ai-trong-trung-tam-du-lieu-post929637.html

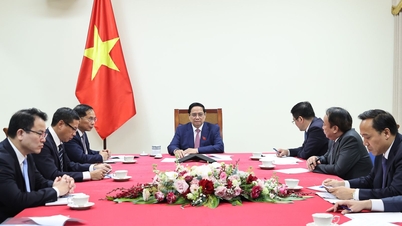

![[Zdjęcie] Premier Pham Minh Chinh rozmawia telefonicznie z dyrektorem generalnym rosyjskiej korporacji Rosatom.](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F11%2F1765464552365_dsc-5295-jpg.webp&w=3840&q=75)

![[Zdjęcie] Uroczystość zamknięcia X sesji XV Zgromadzenia Narodowego](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F11%2F1765448959967_image-1437-jpg.webp&w=3840&q=75)

![[OFICJALNIE] MISA GROUP OGŁASZA SWOJE PIONIERSKIE POZYCJONOWANIE MARKI W BUDOWANIU AGENTIC AI DLA FIRM, GOSPODARSTW DOMOWYCH I RZĄDU](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/11/1765444754256_agentic-ai_postfb-scaled.png)

![[Galeria zdjęć] Lotnisko Long Thanh „rozświetla się” na powitanie pierwszego lotu](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/11/1765467251707_bia_20251211222704.jpeg)

Komentarz (0)