Assim, a empresa proprietária do ChatGPT e do Dall-E assumiu diversos compromissos em relação às políticas de IA. "A empresa está comprometida em trabalhar com o governo dos EUA e com legisladores de todo o mundo para apoiar o desenvolvimento de requisitos de licenciamento para todos os modelos de IA de alto desempenho no futuro."

A ideia de um processo de licenciamento para o desenvolvimento de IA, copromovida por líderes do setor como a OpenAI e o governo, está criando as condições para um potencial conflito entre startups e desenvolvedores de código aberto, que a veem como uma tentativa de dificultar a entrada no espaço da IA.

Em uma audiência perante o Congresso dos EUA, o CEO da OpenAI, Sam Altman, chegou a levantar a ideia de criar uma agência responsável por licenciar ou revogar o registro de produtos de IA caso violem as normas estabelecidas.

O anúncio da OpenAI surge num momento em que outras grandes empresas de IA, como a Microsoft e o Google, também estão a considerar medidas semelhantes.

No entanto, a vice-presidente de assuntos globais da empresa, Anna Makanju, afirmou que o documento de política interna seria diferente da política que a Casa Branca deverá divulgar. A OpenAI declarou que não "impõe" o licenciamento, mas acredita que este é um método "prático" para os governos regulamentarem sistemas emergentes.

“É importante que os governos saibam se esses sistemas superpoderosos podem potencialmente causar danos” e “existem pouquíssimas maneiras de as autoridades tomarem conhecimento desses sistemas sem que elas façam uma autodenúncia”.

Makanju afirmou que a OpenAI só apoia o licenciamento de modelos de IA mais poderosos que o GPT-4 e quer garantir que as startups menores não tenham que arcar com o ônus regulatório.

Responsabilidade e transparência

A OpenAI também sinalizou em documentação interna que está disposta a ser mais transparente sobre os dados que utiliza para treinar geradores de imagens como o Dall-E. A empresa afirma estar comprometida com uma abordagem transparente e responsável em relação aos dados de desenvolvimento de IA.

Analistas observaram que os compromissos descritos no memorando da OpenAI são altamente consistentes com algumas das propostas políticas feitas pela Microsoft em maio. A OpenAI ressaltou que, apesar de ter recebido um investimento de US$ 10 bilhões da Microsoft, permanece uma empresa independente.

Além disso, a empresa proprietária do ChatGPT também realizou uma pesquisa de marcas d'água para verificar a autenticidade e os direitos autorais das imagens geradas por IA.

No memorando, a OpenAI parece reconhecer os riscos potenciais que os sistemas de IA representam para o mercado de trabalho e para a desigualdade. A empresa afirmou na versão preliminar que realizará pesquisas e fará recomendações aos formuladores de políticas para proteger a economia de uma possível "disrupção".

A empresa também afirmou estar aberta a permitir que as pessoas acessem e testem seus sistemas em busca de vulnerabilidades em diversas áreas, incluindo conteúdo ofensivo, riscos de manipulação e desinformação, e apoia a criação de um centro colaborativo de compartilhamento de informações sobre segurança cibernética.

(Segundo a Bloomberg)

Fonte

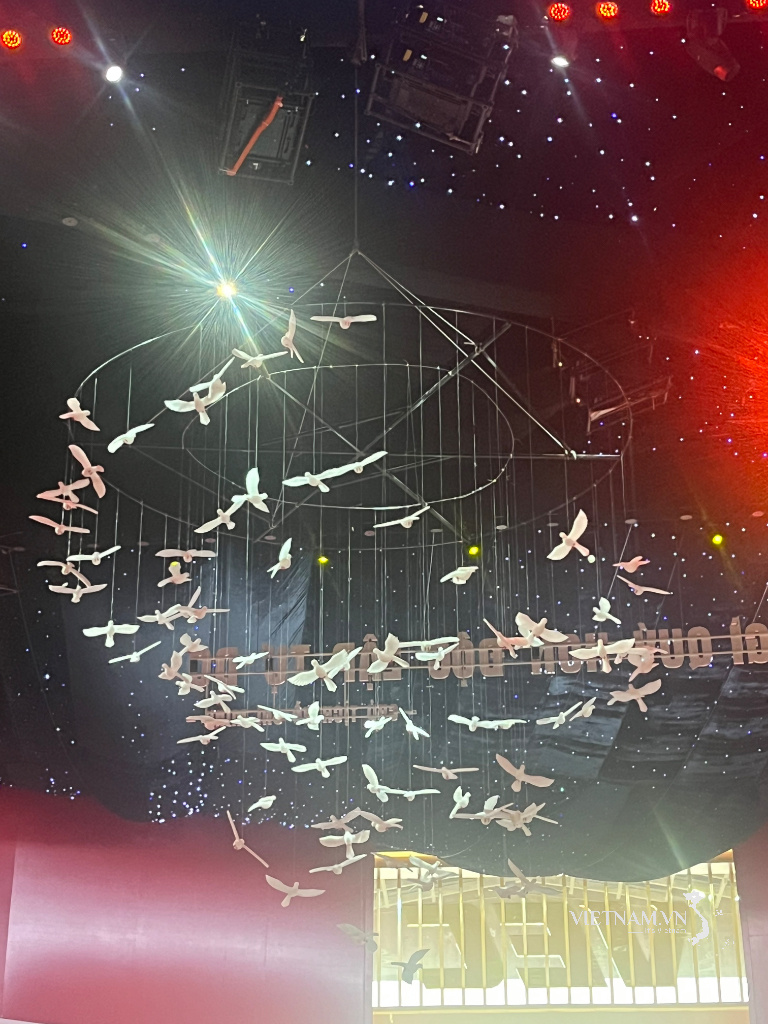

![[Foto] 60º aniversário da fundação da Associação Vietnamita de Artistas Fotográficos](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F05%2F1764935864512_a1-bnd-0841-9740-jpg.webp&w=3840&q=75)

![[Foto] O presidente da Assembleia Nacional, Tran Thanh Man, participa da cerimônia de premiação do VinFuture 2025.](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F05%2F1764951162416_2628509768338816493-6995-jpg.webp&w=3840&q=75)

Comentário (0)